Los modelos de aprendizaje profundo como las redes neuronales convolucionales (CNN) y los transformadores de visión lograron un gran éxito en muchas tareas visuales, como la clasificación de imágenes, la detección de objetos y la segmentación semántica. Sin embargo, su capacidad para manejar diferentes cambios en los datos sigue siendo una gran preocupación, especialmente para su uso en aplicaciones críticas para la seguridad. Muchos trabajos evaluaron la solidez de las CNN y los transformadores frente a corrupciones comunes, cambios de dominio, pérdidas de información y ataques adversarios. Esto demuestra que el diseño de un modelo afecta su capacidad para gestionar estos problemas, y la solidez varía según las diferentes arquitecturas. Una desventaja importante de los transformadores es su escala computacional cuadrática con el tamaño de entrada, lo que los hace costosos para tareas complejas.

Este artículo analizó dos temas relacionados: la robustez de los modelos de aprendizaje profundo (RDLM) y los modelos de espacio de estados (SSM). RDLM se centra en qué tan bien un modelo entrenado tradicionalmente puede mantener un buen rendimiento si se enfrenta a cambios naturales y adversos en la distribución de datos. Los modelos de aprendizaje profundo a menudo enfrentan corrupción de datos, como ruido, desenfoque, artefactos de compresión e interrupciones intencionales diseñadas para engañar al modelo en situaciones del mundo real. Estos problemas pueden perjudicar significativamente su rendimiento, por lo que, para garantizar que estos modelos sean confiables y robustos, es importante evaluar su rendimiento en estas duras condiciones. Por otro lado, los SSM son un enfoque prometedor para modelar datos secuenciales en aprendizaje profundo. Estos modelos transforman una secuencia unidimensional utilizando un estado latente implícito.

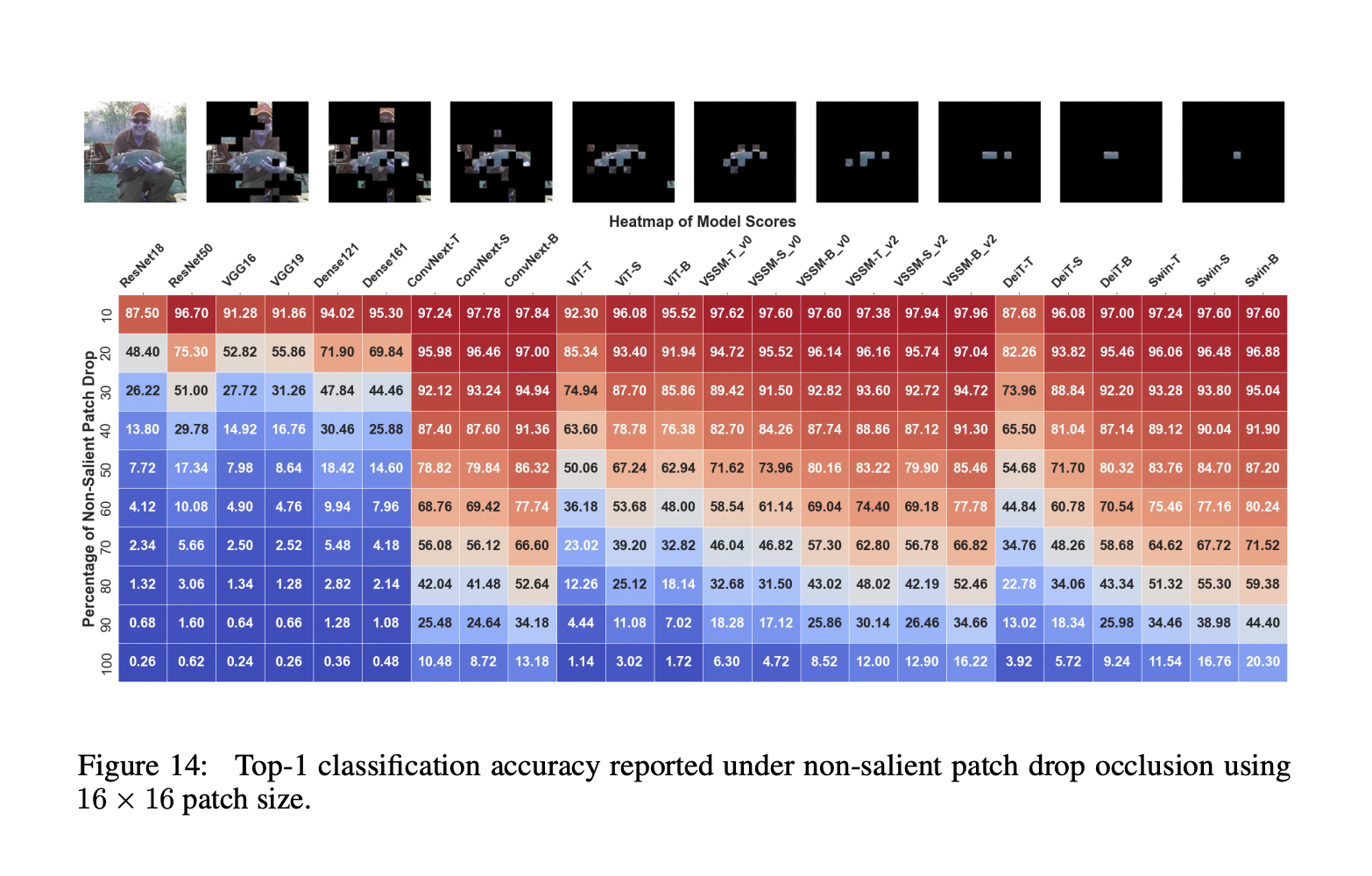

Investigadores de MBZUAI EAU, la Universidad de Linkoping y ANU Australia han presentado un análisis exhaustivo del rendimiento de VSSM, Vision Transformers y CNN. Este análisis puede gestionar diversos desafíos para las tareas de clasificación, detección y segmentación, y proporciona información valiosa sobre su solidez e idoneidad para aplicaciones del mundo real. Las evaluaciones realizadas por los investigadores se dividen en tres partes, cada una de las cuales se centra en un área importante de la solidez del modelo. La primera parte es Oclusiones y pérdida de información, donde se evalúa la solidez de los VSSM frente a la pérdida de información a lo largo de las direcciones de escaneo y las oclusiones. Las otras dos partes son Corrupciones comunes y Ataques adversarios.

La solidez de los modelos de clasificación basados en VSSM se prueba frente a corrupciones comunes que reflejan situaciones del mundo real. Estas incluyen corrupciones globales como ruido, desenfoque, clima y distorsiones digitales en diferentes niveles de intensidad, y corrupciones detalladas como edición de atributos de objetos y cambios de fondo. Luego, la evaluación se extiende a modelos de detección y segmentación basados en VSSM para mostrar su fortaleza en tareas de predicción densas. Además, la solidez de los VSSM se analiza en comparación con la tercera y última sección, Ataques adversarios tanto en entornos de caja blanca como de caja negra. Este análisis brinda información sobre la capacidad de los VSSM para resistir cambios adversos en varios niveles de frecuencia.

Con base en la evaluación de las tres secciones, aquí están las conclusiones clave:

- En la primera parte, se encuentra que los modelos ConvNext y VSSM manejan la pérdida de información secuencial a lo largo de la dirección de escaneo, mejor que los modelos ViT y Swin. En situaciones que involucran caídas de parches, los VSSM muestran la mayor robustez, aunque los modelos Swin funcionan mejor bajo pérdida extrema de información.

- Los modelos VSSM experimentan la menor caída de rendimiento promedio en comparación con los modelos Swin y ConvNext en corrupción global. Para las corrupciones detalladas, los modelos VSSM superan a todas las variantes basadas en transformadores y coinciden.

- En el caso de ataques adversarios, los modelos VSSM más pequeños muestran una gran robustez frente a ataques de caja blanca en comparación con sus contrapartes de Swin Transformer. Los modelos VSSM mantienen una robustez superior al 90 % frente a fuertes perturbaciones de baja frecuencia, pero su rendimiento disminuye rápidamente frente a ataques de alta frecuencia.

En conclusión, los investigadores evaluaron exhaustivamente la solidez de los modelos de espacio de estados de visión (VSSM) en diversas perturbaciones naturales y adversas, mostrando sus fortalezas y debilidades en comparación con los transformadores y las CNN. Los experimentos revelaron las capacidades y limitaciones de los VSSM para manejar oclusiones, corrupciones comunes y ataques adversarios, así como su capacidad para adaptarse a los cambios en la composición del fondo del objeto en escenas visuales complejas. Este estudio guiará las investigaciones futuras para mejorar la confiabilidad y la eficacia de los sistemas de percepción visual en situaciones del mundo real.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo.

Únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de más de 45.000 ml

Sajjad Ansari es un estudiante de último año de IIT Kharagpur. Como entusiasta de la tecnología, profundiza en las aplicaciones prácticas de la IA centrándose en comprender el impacto de las tecnologías de IA y sus implicaciones en el mundo real. Su objetivo es articular conceptos complejos de IA de una manera clara y accesible.