Las organizaciones se esfuerzan por implementar soluciones de atención al cliente eficientes, escalables, rentables y automatizadas sin comprometer la experiencia del cliente. Los chatbots basados en inteligencia artificial (IA) generativa desempeñan un papel crucial en la prestación de interacciones similares a las humanas al brindar respuestas desde una base de conocimiento sin la participación de agentes en vivo. Estos chatbots se pueden utilizar de manera eficiente para gestionar consultas genéricas, lo que libera a los agentes en vivo para que se concentren en tareas más complejas.

Amazonas Lex Proporciona interfaces conversacionales avanzadas que utilizan canales de voz y texto. Cuenta con capacidades de comprensión del lenguaje natural para reconocer con mayor precisión la intención del usuario y cumplirla más rápido.

La roca madre del Amazonas Simplifica el proceso de desarrollo y escalado de aplicaciones de IA generativa impulsadas por grandes modelos de lenguaje (LLM) y otros modelos de base (FM). Ofrece acceso a una amplia gama de FM de proveedores líderes como Claude antrópico, Laboratorios AI21, Adherirsey Estabilidad IAasí como la propiedad de Amazon Titán de Amazon modelos. Además, Bases de conocimiento para Amazon Bedrock le permite desarrollar aplicaciones que aprovechan el poder de la recuperación de generación aumentada (RAG), un enfoque en el que la recuperación de información relevante de las fuentes de datos mejora la capacidad del modelo para generar respuestas contextualmente apropiadas e informadas.

La capacidad generativa de la IA QnAIntent en Amazon Lex QnAIntent le permite conectar de forma segura los FM a los datos de la empresa para RAG. QnAIntent proporciona una interfaz para usar los datos empresariales y los FM en Amazon Bedrock para generar respuestas relevantes, precisas y contextuales. Puede usar QnAIntent con bots de Amazon Lex nuevos o existentes para automatizar las preguntas frecuentes a través de canales de texto y voz, como Conexión de Amazon.

Con esta capacidad, ya no es necesario crear variaciones de intenciones, expresiones de muestra, espacios y mensajes para predecir y gestionar una amplia gama de preguntas frecuentes. Simplemente puede conectar QnAIntent a las fuentes de conocimiento de la empresa y el bot puede gestionar de inmediato las preguntas utilizando el contenido permitido.

En esta publicación, demostramos cómo puedes crear chatbots con QnAIntent que se conectan a una base de conocimiento en Amazon Bedrock (desarrollada por Amazon OpenSearch sin servidor como un base de datos de vectores) y crear experiencias conversacionales enriquecidas y de autoservicio para sus clientes.

Descripción general de la solución

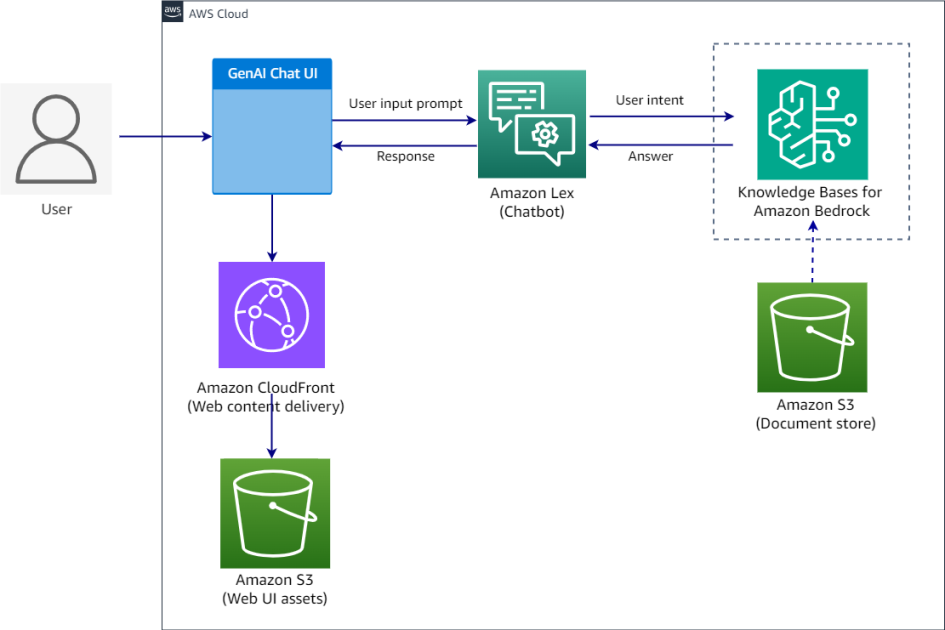

La solución utiliza Amazon Lex, Servicio de almacenamiento simple de Amazon (Amazon S3) y Amazon Bedrock en los siguientes pasos:

- Los usuarios interactúan con el chatbot a través de una interfaz de usuario web de Amazon Lex prediseñada.

- Amazon Lex procesa cada solicitud de usuario para determinar la intención del usuario a través de un proceso llamado reconocimiento de intención.

- Amazon Lex proporciona la función de inteligencia artificial generativa incorporada QnAIntent, que se puede conectar directamente a una base de conocimiento para satisfacer las solicitudes de los usuarios.

- Las bases de conocimiento para Amazon Bedrock utilizan el modelo de incrustaciones de Amazon Titan para convertir la consulta del usuario en un vector y consultan la base de conocimiento para encontrar fragmentos que sean semánticamente similares a la consulta del usuario. La solicitud del usuario se amplía junto con los resultados devueltos desde la base de conocimiento como un contexto adicional y se envía al LLM para generar una respuesta.

- La respuesta generada se devuelve a través de QnAIntent y se envía al usuario en la aplicación de chat a través de Amazon Lex.

El siguiente diagrama ilustra la arquitectura de la solución y el flujo de trabajo.

En las siguientes secciones, analizamos con más detalle los componentes clave de la solución y los pasos de alto nivel para implementar la solución:

- Cree una base de conocimientos en Amazon Bedrock para OpenSearch Serverless.

- Crea un bot de Amazon Lex.

- Cree una nueva intención generativa impulsada por IA en Amazon Lex utilizando QnAIntent integrado y apunte a la base de conocimiento.

- Implemente la interfaz de usuario web de Amazon Lex de muestra disponible en Repositorio de GitHubUtilice el proporcionado Formación en la nube de AWS plantilla en su región de AWS preferida y configure el bot.

Prerrequisitos

Para implementar esta solución, necesita lo siguiente:

- Un Cuenta de AWS con privilegios para crear Gestión de identidad y acceso de AWS (IAM) Roles y políticas. Para obtener más información, consulte Descripción general de la gestión de acceso: permisos y políticas.

- Familiaridad con los servicios de AWS como Amazon S3, Amazon Lex, Servicio OpenSearch de Amazony Amazon Bedrock.

- Acceso habilitado para el modelo de texto G1 de Amazon Titan Embeddings y el haiku antrópico de Claude 3 en Amazon Bedrock. Para obtener instrucciones, consulte Acceso al modelo.

- Una fuente de datos en Amazon S3. Para esta publicación, usamos Documentos para accionistas de Amazon (Cartas a accionistas de Amazon – 2023 y 2022) como fuente de datos para hidratar la base de conocimientos.

Crear una base de conocimientos

Para crear una nueva base de conocimientos en Amazon Bedrock, siga estos pasos. Para obtener más información, consulte Crear una base de conocimientos.

- En la consola de Amazon Bedrock, seleccione Bases de conocimiento en el panel de navegación.

- Elegir Crear una base de conocimientos.

- Sobre el Proporcionar detalles de la base de conocimientos página, ingrese un nombre de base de conocimiento, permisos de IAM y etiquetas.

- Elegir Próximo.

- Para Nombre de fuente de datosAmazon Bedrock rellena automáticamente el nombre de la fuente de datos generada automáticamente; sin embargo, puede cambiarlo según sus requisitos.

- Mantenga la ubicación de la fuente de datos como la misma cuenta de AWS y elija Explorar S3.

- Seleccione el depósito S3 donde cargó los documentos de accionistas de Amazon y elija Elegir.

Esto completará la URI S3, como se muestra en la siguiente captura de pantalla.

- Elegir Próximo.

- Seleccione el modelo de incrustación para vectorizar los documentos. Para esta publicación, seleccionamos Incorporación de Titan G1 – Texto v1.2.

- Seleccionar Cree rápidamente una nueva tienda de vectores para crear un almacén de vectores predeterminado con OpenSearch Serverless.

- Elegir Próximo.

- Revise las configuraciones y cree su base de conocimientos.

Una vez creada correctamente la base de conocimiento, debería ver un ID de base de conocimiento, que necesita al crear el bot de Amazon Lex. - Elegir Sincronizar para indexar los documentos.

Crear un bot de Amazon Lex

Complete los siguientes pasos para crear su bot:

- En la consola de Amazon Lex, seleccione Bots en el panel de navegación.

- Elegir Crear bot.

- Para Método de creación, seleccionar Crea un bot en blanco.

- Para Nombre del botingrese un nombre (por ejemplo,

FAQBot). - Para Rol de tiempo de ejecuciónseleccionar Crear un nuevo rol de IAM con permisos básicos de Amazon Lex para acceder a otros servicios en su nombre.

- Configure los ajustes restantes según sus requisitos y elija Próximo.

- Sobre el Añadir idioma al bot página, puedes elegir entre Se admiten diferentes idiomas.

Para este post elegimos Inglés (EE.UU.). - Elegir Hecho.

Una vez creado correctamente el bot, se le redirigirá para crear una nueva intención. - Agregue enunciados para la nueva intención y elija Guardar intención.

Añade QnAIntent a tu intención

Complete los siguientes pasos para agregar QnAIntent:

- En la consola de Amazon Lex, navegue hasta la intención que creó.

- Sobre el Agregar intención Menú desplegable, seleccione Utilice la intención incorporada.

- Para Intención incorporada, elegir AMAZON.QnAIntent – Función GenAI.

- Para Nombre de la intencióningrese un nombre (por ejemplo,

QnABotIntent). - Elegir Agregar.

Después de agregar QnAIntent, se le redirigirá para configurar la base de conocimiento. - Para Seleccionar modeloelegir Antrópico y Haiku de Claude3.

- Para Elige una tienda de conocimientosseleccionar Base de conocimientos de Amazon Bedrock e ingrese su ID de base de conocimientos.

- Elegir Guardar intención.

- Después de guardar la intención, seleccione Construir para construir el bot.

Deberías ver un Construido con éxito Mensaje cuando se completa la compilación.

Ahora puedes probar el bot en la consola de Amazon Lex. - Elegir Prueba para lanzar una versión borrador de su bot en una ventana de chat dentro de la consola.

- Ingrese preguntas para obtener respuestas.

Implementar la interfaz de usuario web de Amazon Lex

La interfaz de usuario web de Amazon Lex es un cliente web prediseñado y con todas las funciones para los chatbots de Amazon Lex. Elimina el trabajo pesado de recrear una interfaz de usuario de chat desde cero. Puede implementar rápidamente sus funciones y minimizar el tiempo de generación de valor para sus aplicaciones impulsadas por chatbots. Complete los siguientes pasos para implementar la interfaz de usuario:

- Siga las instrucciones en el Repositorio de GitHub.

- Antes de implementar la plantilla de CloudFormation, actualice la

LexV2BotIdyLexV2BotAliasIdValores en la plantilla basados en el chatbot que creaste en tu cuenta. - Una vez que la pila CloudFormation se haya implementado correctamente, copie el

WebAppUrlvalor de la pila Salidas pestaña. - Navegue a la interfaz de usuario web para probar la solución en su navegador.

Limpiar

Para evitar incurrir en cargos innecesarios en el futuro, limpie los recursos que creó como parte de esta solución:

- Elimine la base de conocimiento de Amazon Bedrock y los datos en el depósito S3 si creó uno específicamente para esta solución.

- Elimina el bot de Amazon Lex que creaste.

- Eliminar la pila CloudFormation.

Conclusión

En esta publicación, analizamos la importancia de los chatbots con tecnología de inteligencia artificial generativa en los sistemas de atención al cliente. Luego, brindamos una descripción general de la nueva función de Amazon Lex, QnAIntent, diseñada para conectar a los gerentes de cuentas con los datos de su empresa. Por último, demostramos un caso práctico de uso de la configuración de un chatbot de preguntas y respuestas para analizar los documentos de los accionistas de Amazon. Esta implementación no solo brinda un servicio al cliente rápido y consistente, sino que también permite que los agentes en vivo dediquen su experiencia a resolver problemas más complejos.

Manténgase actualizado con los últimos avances en IA generativa y comience a desarrollar en AWS. Si busca ayuda sobre cómo comenzar, consulte la Centro de innovación en inteligencia artificial generativa.

Sobre los autores

Supriya Puragundla es arquitecta de soluciones sénior en AWS. Tiene más de 15 años de experiencia en TI en desarrollo, diseño y arquitectura de software. Ayuda a cuentas de clientes clave en sus recorridos de datos, IA generativa e IA/ML. Le apasiona la IA basada en datos y el área de profundidad en ML e IA generativa.

Manjula Nagineni es arquitecta de soluciones sénior en AWS y reside en Nueva York. Trabaja con importantes instituciones de servicios financieros, diseñando y modernizando sus aplicaciones a gran escala mientras adoptan los servicios de AWS Cloud. Le apasiona diseñar cargas de trabajo de big data centradas en la nube. Tiene más de 20 años de experiencia en TI en desarrollo de software, análisis y arquitectura en múltiples dominios, como finanzas, comercio minorista y telecomunicaciones.

Mani Khanuja es líder tecnológica y especialista en inteligencia artificial generativa, autora del libro Applied Machine Learning and High Performance Computing on AWS y miembro de la junta directiva de Women in Manufacturing Education Foundation. Lidera proyectos de aprendizaje automático en diversos dominios, como visión artificial, procesamiento del lenguaje natural e inteligencia artificial generativa. Da charlas en conferencias internas y externas, como AWS re:Invent, Women in Manufacturing West, seminarios web de YouTube y GHC 23. En su tiempo libre, le gusta salir a correr largas distancias por la playa.