Los avances en el procesamiento del lenguaje natural han llevado al desarrollo de grandes modelos lingüísticos (LLM, por sus siglas en inglés) capaces de realizar tareas complejas relacionadas con el lenguaje con gran precisión. Estos avances han abierto nuevas posibilidades en la tecnología y la comunicación, permitiendo interacciones entre humanos y computadoras más naturales y efectivas.

Un problema importante en el procesamiento del lenguaje natural es la dependencia de las anotaciones humanas para la evaluación de los modelos. Los datos generados por humanos son esenciales para el entrenamiento y la validación de los modelos, pero la recopilación de estos datos es costosa y lleva mucho tiempo. Además, a medida que los modelos mejoran, es posible que sea necesario actualizar las anotaciones recopiladas previamente, lo que reduce su utilidad para evaluar modelos más nuevos. Esto crea una necesidad continua de datos nuevos, lo que plantea desafíos para escalar y mantener evaluaciones de modelos efectivas. Abordar este problema es crucial para avanzar en las tecnologías de procesamiento del lenguaje natural y sus aplicaciones.

Los métodos actuales para la evaluación de modelos suelen implicar la recopilación de grandes cantidades de juicios de preferencia humanos sobre las respuestas de los modelos. Estos métodos incluyen el uso de métricas automatizadas para tareas con respuestas de referencia o el empleo de clasificadores que generan puntuaciones directamente. Sin embargo, estos métodos enfrentan limitaciones, especialmente para tareas complejas en las que son posibles múltiples respuestas válidas, como la escritura creativa o la codificación. La alta varianza en los juicios humanos y los costos asociados resaltan la necesidad de técnicas de evaluación más eficientes y escalables.

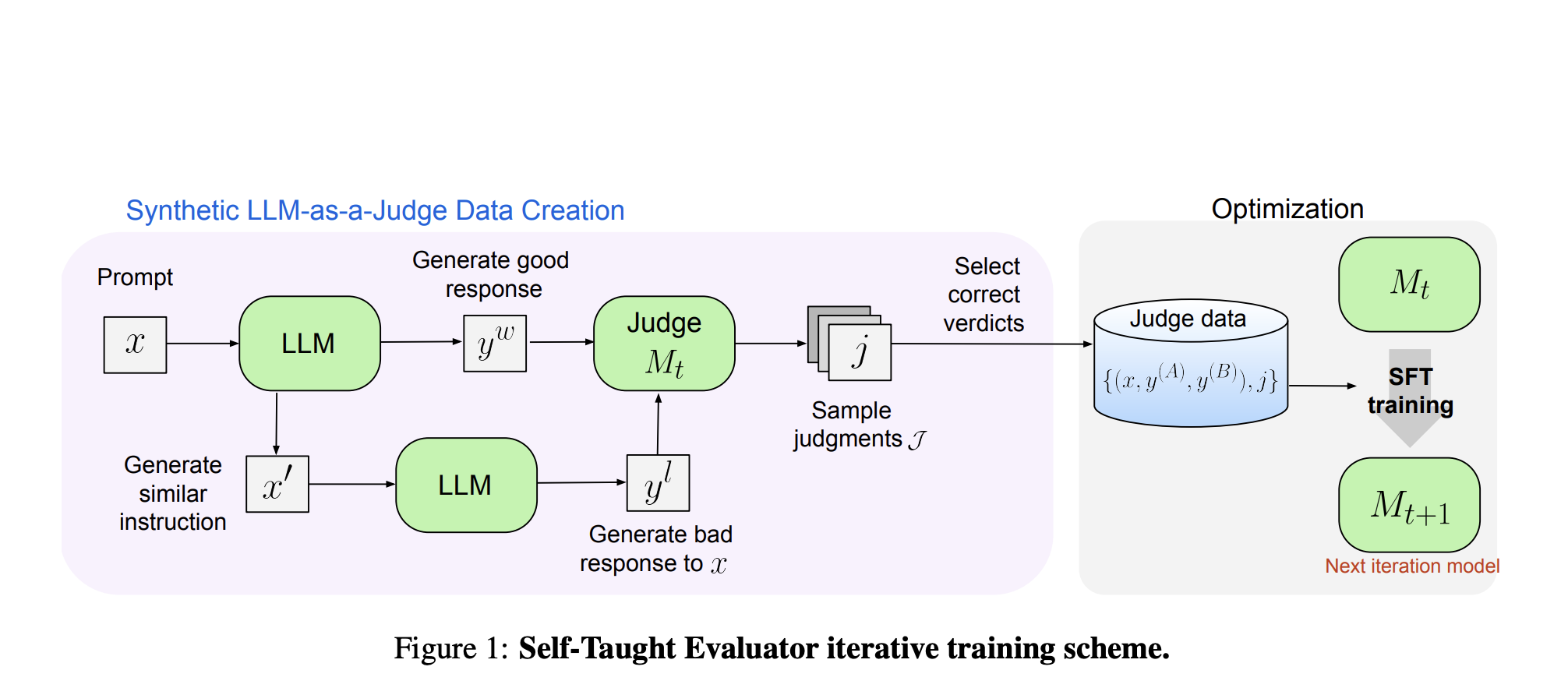

Los investigadores de Meta FAIR han introducido un nuevo enfoque denominado “Evaluador autodidacta”. Este método elimina la necesidad de anotaciones humanas al utilizar datos generados sintéticamente para el entrenamiento. El proceso comienza con un modelo de semilla, que produce pares de preferencias sintéticas contrastantes. Luego, el modelo evalúa estos pares y los mejora iterativamente, utilizando sus juicios para mejorar su rendimiento en iteraciones posteriores. Este enfoque aprovecha la capacidad del modelo para generar y evaluar datos, lo que reduce significativamente la dependencia de las anotaciones generadas por humanos.

El método propuesto implica varios pasos clave. Inicialmente, se genera una respuesta de referencia para una instrucción dada utilizando un LLM semilla. Luego se crea una versión modificada de la instrucción, lo que hace que el LLM genere una nueva respuesta diseñada para ser de menor calidad que la original. Estas respuestas pareadas forman la base de los datos de entrenamiento. El modelo, que actúa como un LLM como juez, genera rastros de razonamiento y juicios para estos pares. Este proceso se repite de forma iterativa y el modelo mejora continuamente la precisión de sus juicios a través de datos autogenerados y autoevaluados, lo que crea de manera efectiva un ciclo de automejora.

El rendimiento del evaluador autodidacta se probó utilizando el modelo Llama-3-70B-Instruct. El método mejoró la precisión del modelo en el punto de referencia RewardBench de 75,4 a 88,7, igualando o superando el rendimiento de los modelos entrenados con anotaciones humanas. Esta mejora significativa demuestra la eficacia de los datos sintéticos para mejorar la evaluación del modelo. Además, los investigadores realizaron múltiples iteraciones, refinando aún más las capacidades del modelo. El modelo final alcanzó una precisión de 88,3 con una sola inferencia y 88,7 con votación por mayoría, lo que demuestra su solidez y fiabilidad.

En conclusión, el Evaluador autodidacta ofrece una solución escalable y eficiente para la evaluación de modelos de PNL. Al aprovechar los datos sintéticos y la automejora iterativa, aborda los desafíos de depender de anotaciones humanas y se mantiene al día con los rápidos avances en el desarrollo de modelos de lenguaje. Este enfoque mejora el rendimiento del modelo y reduce la dependencia de los datos generados por humanos, allanando el camino para sistemas de PNL más autónomos y eficientes. El trabajo del equipo de investigación en Meta FAIR marca un avance significativo en la búsqueda de métodos de evaluación más avanzados y autónomos en el campo del PNL.

Revisar la PapelTodo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Más de 47 000 suscriptores de ML en Reddit

Encuentra lo próximo Seminarios web sobre IA aquí

Nikhil es consultor en prácticas en Marktechpost. Está cursando una doble titulación integrada en Materiales en el Instituto Indio de Tecnología de Kharagpur. Nikhil es un entusiasta de la IA y el aprendizaje automático que siempre está investigando aplicaciones en campos como los biomateriales y la ciencia biomédica. Con una sólida formación en ciencia de los materiales, está explorando nuevos avances y creando oportunidades para contribuir.