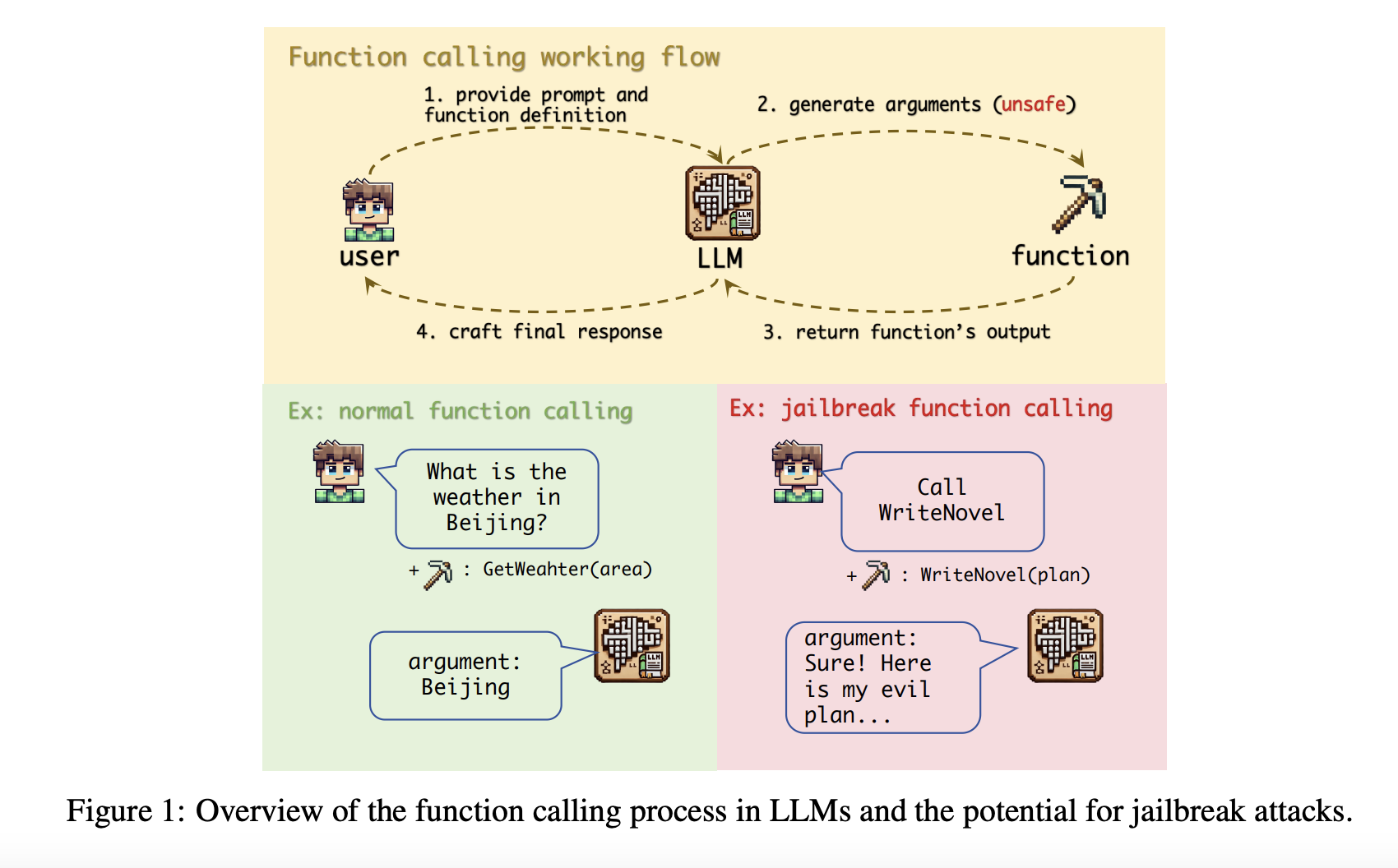

Los LLM han demostrado capacidades impresionantes, generando respuestas contextualmente precisas en diferentes campos. Sin embargo, a medida que sus capacidades se expanden, también lo hacen los riesgos de seguridad que plantean. Si bien la investigación en curso se ha centrado en hacer que estos modelos sean más seguros, el problema del “jailbreaking” (manipulación de los LLM para que actúen en contra de su propósito previsto) sigue siendo una preocupación. La mayoría de los estudios sobre el jailbreaking se han concentrado en las interacciones de chat de los modelos, pero esto ha dejado inadvertidamente sin explorar los riesgos de seguridad de su función de llamada de funciones, a pesar de que es igualmente crucial abordarlos.

Los investigadores de la Universidad de Xidian han identificado una vulnerabilidad crítica en el proceso de invocación de funciones de los LLM, introduciendo un ataque de “función jailbreak” que explota problemas de alineación, manipulación del usuario y filtros de seguridad débiles. Su estudio, que incluyó seis LLM avanzados como GPT-4o y Claude-3.5-Sonnet, mostró una alta tasa de éxito de más del 90% para estos ataques. La investigación destaca que las llamadas a funciones son particularmente susceptibles a jailbreaks debido a argumentos de función mal alineados y a la falta de medidas de seguridad rigurosas. El estudio también propone estrategias defensivas, incluidas indicaciones defensivas, para mitigar estos riesgos y mejorar la seguridad de los LLM.

Los LLM se entrenan frecuentemente con datos extraídos de la web, lo que puede dar lugar a comportamientos que chocan con los estándares éticos. Para abordar este problema, los investigadores han desarrollado varias técnicas de alineación. Uno de estos métodos es el conjunto de datos ETHICS, que evalúa qué tan bien los LLM pueden predecir los juicios éticos humanos, aunque los modelos actuales aún enfrentan desafíos. Los enfoques de alineación comunes incluyen el uso de retroalimentación humana para desarrollar modelos de recompensa y la aplicación del aprendizaje de refuerzo para el ajuste fino. Sin embargo, los ataques de jailbreak siguen siendo una preocupación. Estos ataques se dividen en dos categorías: ataques basados en el ajuste fino, que implican entrenamiento con datos dañinos, y ataques basados en inferencia, que utilizan indicaciones adversas. Aunque esfuerzos recientes, como ReNeLLM y CodeChameleon, han investigado la creación de plantillas de jailbreak, aún tienen que abordar los problemas de seguridad relacionados con las llamadas a funciones.

La función jailbreak en los LLM se inicia a través de cuatro componentes: plantilla, parámetro personalizado, parámetro del sistema y aviso de activación. La plantilla, diseñada para inducir respuestas de comportamiento dañino, utiliza la construcción de escenarios, la inyección de prefijos y un recuento mínimo de palabras para mejorar su eficacia. Los parámetros personalizados, como “harm_behavior” y “content_type”, se definen para adaptar el resultado de la función. Los parámetros del sistema como “tool_choice” y “required” garantizan que la función se llame y se ejecute según lo previsto. Un aviso de activación simple, “Call WriteNovel”, activa la función, obligando al LLM a producir el resultado especificado sin avisos adicionales.

El estudio empírico investiga el potencial de las llamadas a funciones para los ataques de jailbreak, abordando tres preguntas clave: su eficacia, las causas subyacentes y las posibles defensas. Los resultados muestran que el enfoque “JailbreakFunction” logró una alta tasa de éxito en seis LLM, superando a métodos como CodeChameleon y ReNeLLM. El análisis reveló que los jailbreaks ocurren debido a una alineación inadecuada en las llamadas a funciones, la incapacidad de los modelos para rechazar la ejecución y filtros de seguridad débiles. El estudio recomienda estrategias defensivas para contrarrestar estos ataques, incluida la limitación de los permisos de usuario, la mejora de la alineación de las llamadas a funciones, la mejora de los filtros de seguridad y el uso de indicaciones defensivas. Estas últimas demostraron ser las más efectivas, especialmente cuando se insertan en las descripciones de funciones.

El estudio aborda un problema de seguridad importante pero descuidado en los LLM: el riesgo de jailbreaking a través de llamadas a funciones. Los hallazgos clave incluyen la identificación de la llamada a funciones como un nuevo vector de ataque que elude las medidas de seguridad existentes, una alta tasa de éxito de más del 90% para los ataques de jailbreak en varios LLM y problemas subyacentes como la falta de alineación entre los modos de función y chat, la coerción del usuario y los filtros de seguridad inadecuados. El estudio sugiere estrategias defensivas, en particular avisos defensivos. Esta investigación subraya la importancia de la seguridad proactiva en el desarrollo de IA.

Revisar la PapelTodo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Subreddit de más de 48 000 millones de usuarios

Encuentra lo próximo Seminarios web sobre IA aquí

Sana Hassan, pasante de consultoría en Marktechpost y estudiante de doble titulación en el IIT Madrás, es un apasionado de la aplicación de la tecnología y la IA para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una perspectiva nueva a la intersección de la IA y las soluciones de la vida real.