Microsoft ha ampliado recientemente sus capacidades de inteligencia artificial con la introducción de tres modelos sofisticados: Phi 3.5 Mini Instruct, Phi 3.5 MoE (Mixture of Experts) y Phi 3.5 Vision Instruct. Estos modelos representan avances significativos en el procesamiento del lenguaje natural, la IA multimodal y la computación de alto rendimiento, cada uno diseñado para abordar desafíos específicos y optimizar diversas tareas impulsadas por la IA. Examinemos estos modelos en profundidad, destacando su arquitectura, metodologías de entrenamiento y posibles aplicaciones.

Phi 3.5 Mini Instruct: Equilibrio entre potencia y eficiencia

Descripción general y arquitectura del modelo

Phi 3.5 Mini Instruct es un modelo de Transformer denso que solo utiliza un decodificador y que cuenta con 3.8 mil millones de parámetros, lo que lo convierte en uno de los modelos más compactos de la serie Phi 3.5 de Microsoft. A pesar de su cantidad relativamente pequeña de parámetros, este modelo admite una impresionante longitud de contexto de 128 K, lo que le permite manejar tareas que involucran documentos largos, conversaciones extensas y escenarios de razonamiento complejos. El modelo se basa en los avances realizados en la serie Phi 3, que incorpora técnicas de vanguardia en el entrenamiento y la optimización de modelos.

Datos y proceso de entrenamiento

Phi 3.5 Mini Instruct se entrenó en un conjunto de datos diverso que totaliza 3,4 billones de tokens. El conjunto de datos incluye documentos disponibles públicamente filtrados rigurosamente para garantizar la calidad, datos sintéticos similares a los de un libro de texto diseñados para mejorar las capacidades de razonamiento y resolución de problemas, y datos supervisados en formato de chat de alta calidad. El modelo se sometió a una serie de optimizaciones, incluido el ajuste fino supervisado y la optimización de preferencias directas, para garantizar un alto cumplimiento de las instrucciones y un rendimiento sólido en varias tareas.

Características técnicas y capacidades

La arquitectura del modelo le permite sobresalir en entornos con recursos computacionales limitados y, al mismo tiempo, ofrecer niveles de alto rendimiento. Su longitud de contexto de 128K es particularmente notable, ya que supera las longitudes de contexto típicas admitidas por la mayoría de los demás modelos. Esto permite que Phi 3.5 Mini Instruct administre y procese secuencias extensas de tokens sin perder coherencia ni precisión.

En las pruebas comparativas, Phi 3.5 Mini Instruct demostró un sólido desempeño en tareas de razonamiento, en particular aquellas que involucran generación de código, resolución de problemas matemáticos e inferencia lógica. La capacidad del modelo para manejar conversaciones complejas de múltiples turnos en varios idiomas lo convierte en una herramienta invaluable para aplicaciones que abarcan desde soporte automatizado al cliente hasta investigación avanzada en procesamiento de lenguaje natural.

Phi 3.5 MoE: Cómo liberar el potencial de la combinación de expertos

Descripción general y arquitectura del modelo

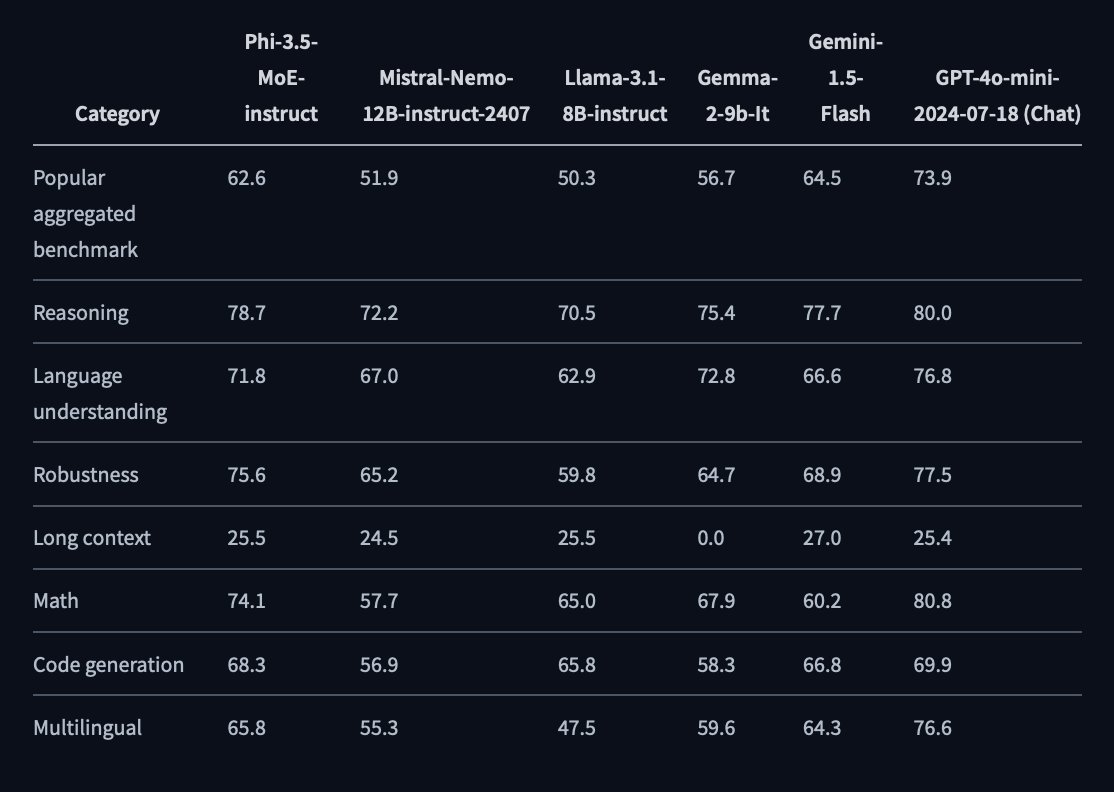

El modelo Phi 3.5 MoE representa un salto significativo en la arquitectura de IA con su diseño Mixture of Expert. El modelo está construido con 42 mil millones de parámetros, divididos en 16 expertos, y tiene 6.6 mil millones de parámetros activos durante la inferencia. Esta arquitectura permite que el modelo seleccione y active dinámicamente diferentes subconjuntos de expertos según los datos de entrada, optimizando la eficiencia computacional y el rendimiento.

Metodología de formación

El entrenamiento de Phi 3.5 MoE implicó 4,9 billones de tokens, y el modelo se afinó para optimizar sus capacidades de razonamiento, en particular en tareas que requieren inferencia lógica, cálculos matemáticos y generación de código. El enfoque de combinación de expertos reduce significativamente la carga computacional durante la inferencia al involucrar selectivamente solo a los expertos necesarios, lo que hace posible escalar las capacidades del modelo sin un aumento proporcional en el consumo de recursos.

Características técnicas clave

Uno de los aspectos más importantes de Phi 3.5 MoE es su capacidad para manejar tareas de contexto largas, con soporte para hasta 128K tokens en un solo contexto. Esto lo hace adecuado para resúmenes de documentos, análisis legales y sistemas de diálogo extensos. La arquitectura del modelo también le permite superar a modelos más grandes en tareas de razonamiento mientras mantiene un rendimiento competitivo en varios puntos de referencia de NLP.

Phi 3.5 MoE es particularmente apto para gestionar tareas multilingües, con un amplio ajuste fino en varios idiomas para garantizar la precisión y la relevancia en diversos contextos lingüísticos. La capacidad del modelo para gestionar contextos extensos y sus sólidas capacidades de razonamiento lo convierten en una herramienta poderosa para aplicaciones comerciales y de investigación.

Phi 3.5 Vision Instruct: Pioneros en IA multimodal

Descripción general y arquitectura del modelo

El modelo Phi 3.5 Vision Instruct es una IA multimodal que maneja tareas que requieren entradas textuales y visuales. Con 4150 millones de parámetros y una longitud de contexto de 128 000 tokens, este modelo se destaca en escenarios donde es necesario un conocimiento profundo de imágenes y texto. La arquitectura del modelo integra un codificador de imágenes, un conector, un proyector y un modelo de lenguaje Phi-3 Mini, lo que crea una secuencia perfecta para procesar y generar contenido basado en datos visuales y textuales.

Datos y proceso de entrenamiento

El conjunto de datos de entrenamiento para Phi 3.5 Vision Instruct incluye una combinación de datos sintéticos, contenido educativo de alta calidad e imágenes y textos disponibles públicamente cuidadosamente filtrados. El modelo se ha ajustado para optimizar su rendimiento en tareas de reconocimiento óptico de caracteres (OCR), comparación de imágenes y resumen de videos. Este entrenamiento ha permitido que el modelo desarrolle una sólida capacidad de razonamiento y comprensión contextual en contextos multimodales.

Capacidades técnicas y aplicaciones

Phi 3.5 Vision Instruct está diseñado para ampliar los límites de lo que es posible en la IA multimodal. El modelo puede manejar tareas complejas como la comparación de múltiples imágenes, la comprensión de gráficos y tablas, y el resumen de videoclips. También muestra mejoras significativas en comparación con los puntos de referencia anteriores, con un rendimiento mejorado en tareas que requieren un análisis visual y razonamiento detallados.

La capacidad del modelo para integrar y procesar grandes cantidades de datos visuales y textuales lo hace ideal para aplicaciones en campos como la obtención de imágenes médicas, los vehículos autónomos y los sistemas avanzados de interacción entre humanos y computadoras. Por ejemplo, en el campo de las imágenes médicas, Phi 3.5 Vision Instruct puede ayudar a diagnosticar enfermedades comparando varias imágenes y brindando un resumen detallado de los hallazgos. En los vehículos autónomos, el modelo podría mejorar la comprensión de los datos visuales capturados por las cámaras, mejorando así los procesos de toma de decisiones en tiempo real.

Conclusión: Un paquete completo para aplicaciones avanzadas de IA

La serie Phi 3.5 (Mini Instruct, MoE y Vision Instruct) marca un hito importante en los esfuerzos de desarrollo de IA de Microsoft. Cada modelo está diseñado para abordar necesidades específicas dentro del ecosistema de IA, desde el procesamiento eficiente de datos textuales extensos hasta el análisis sofisticado de entradas multimodales. Estos modelos muestran el compromiso de Microsoft con el avance de la tecnología de IA y brindan herramientas poderosas que se pueden aprovechar en varias industrias.

Phi 3.5 Mini Instruct destaca por su equilibrio entre potencia y eficiencia, lo que lo hace adecuado para tareas en las que los recursos computacionales son limitados pero las demandas de rendimiento siguen siendo altas. Phi 3.5 MoE, con su innovadora arquitectura Mixture of Experts, ofrece capacidades de razonamiento incomparables al tiempo que optimiza el uso de los recursos. Por último, Phi 3.5 Vision Instruct establece un nuevo estándar en IA multimodal, al permitir la integración avanzada de datos visuales y textuales para tareas complejas.

Echa un vistazo a la microsoft/Phi-3.5-vision-instrucciones, microsoft/Phi-3.5-mini-instruccionesy microsoft/Phi-3.5-MoE-instrucciones. Todo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa..

No olvides unirte a nuestro Subreddit de más de 48 000 millones de usuarios

Encuentra lo próximo Seminarios web sobre IA aquí

Asif Razzaq es el director ejecutivo de Marktechpost Media Inc. Como ingeniero y emprendedor visionario, Asif está comprometido con aprovechar el potencial de la inteligencia artificial para el bien social. Su iniciativa más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, Marktechpost, que se destaca por su cobertura en profundidad de noticias sobre aprendizaje automático y aprendizaje profundo que es técnicamente sólida y fácilmente comprensible para una amplia audiencia. La plataforma cuenta con más de 2 millones de visitas mensuales, lo que ilustra su popularidad entre el público.