Los avances en modelos de lenguaje grande multimodal han mejorado la capacidad de la IA para interpretar y razonar sobre información visual y textual compleja. A pesar de estas mejoras, el campo enfrenta desafíos persistentes, especialmente en las tareas de razonamiento matemático. Los sistemas de IA multimodales tradicionales, incluso aquellos con datos de entrenamiento extensos y grandes recuentos de parámetros, con frecuencia luchan para interpretar y resolver con precisión problemas matemáticos que involucran contextos visuales o configuraciones geométricas. Dichas limitaciones destacan la necesidad urgente de modelos especializados capaces de analizar problemas matemáticos multimodales complejos con mayor precisión, eficiencia y sofisticación de razonamiento.

Investigadores de la Universidad Tecnológica de Nanyang (NTU) introdujeron el Modelo MMR1-MATH-V0-7B y el especializado Conjunto de datos MMR1-MATH-RL-DATA-V0 Para abordar los desafíos críticos anteriores. Este modelo pionero se adapta explícitamente para el razonamiento matemático dentro de las tareas multimodales, mostrando una eficiencia notable y un rendimiento de vanguardia. MMR1-MATH-V0-7B se distingue de modelos multimodales anteriores debido a su capacidad para lograr el rendimiento líder utilizando un conjunto de datos de entrenamiento notablemente mínimo, redefiniendo así puntos de referencia dentro de este dominio.

El modelo ha sido ajustado utilizando solo 6,000 muestras de datos meticulosamente seleccionadas de conjuntos de datos de acceso público. Los investigadores aplicaron una estrategia de selección de datos equilibrada, enfatizando la uniformidad en términos de dificultad para problemas y diversidad de razonamiento matemático. Al filtrar sistemáticamente problemas demasiado simplistas, los investigadores de NTU aseguraron que el conjunto de datos de capacitación comprendiera problemas que desafiaron y mejoraron efectivamente las capacidades de razonamiento del modelo.

La arquitectura de MMR1-MATH-V0-7B se basa en la columna multimodal QWEN2.5-VL y se refina aún más utilizando un nuevo método de entrenamiento conocido como optimización de políticas impulsada por recompensas generalizada (GRPO). Aprovechar GRPO permitió a los investigadores capacitar eficientemente el modelo en una configuración de aprendizaje de refuerzo durante más de 15 épocas, tomando aproximadamente seis horas en 64 GPU H100 NVIDIA. El período de entrenamiento relativamente corto y la utilización eficiente de recursos computacionales subrayan la impresionante capacidad del modelo para la rápida asimilación y generalización del conocimiento.

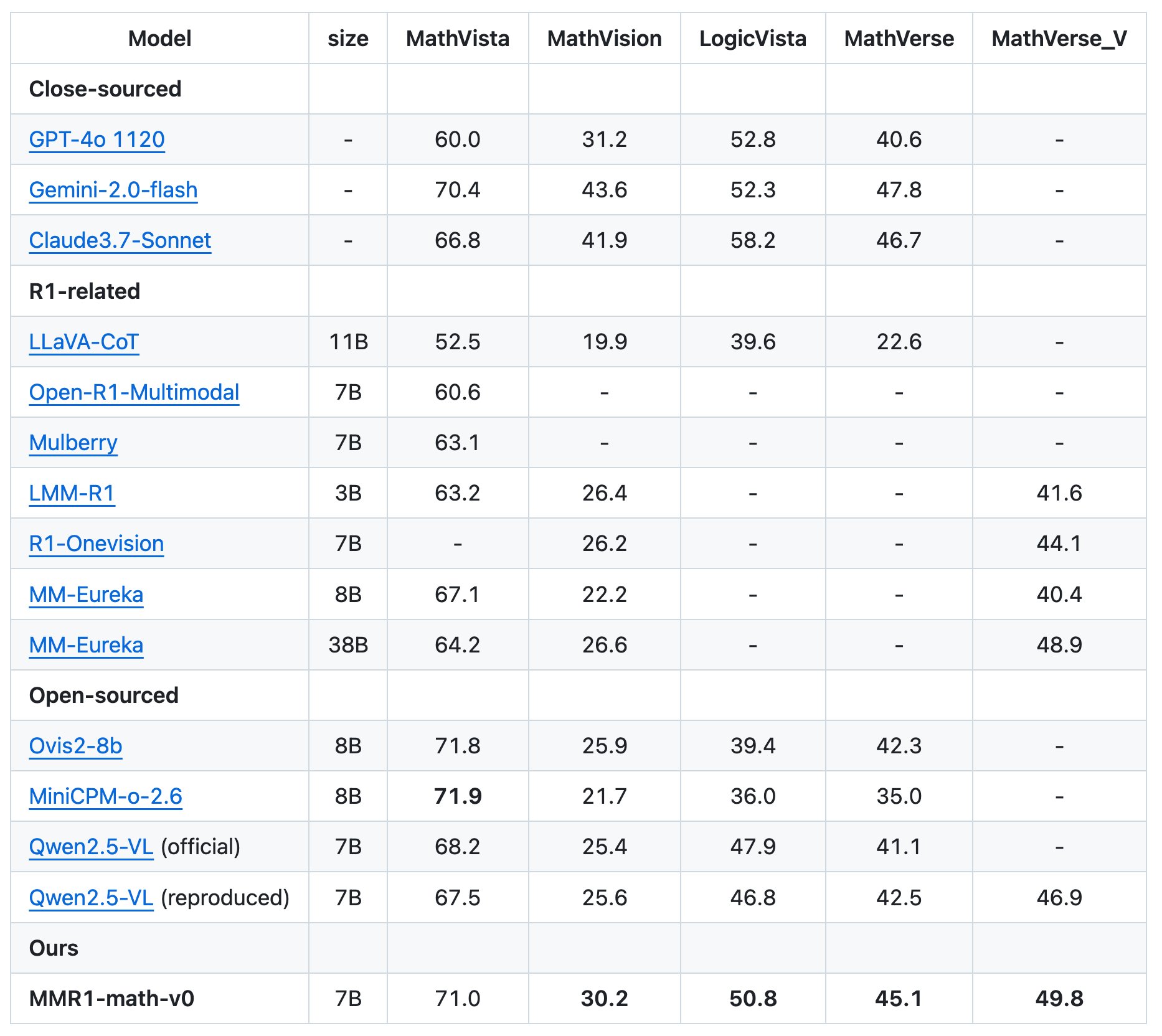

MMR1-MATH-V0-7B se evaluó contra puntos de referencia establecidos utilizando el VLMevalkit estandarizado, centrándose en tareas de razonamiento matemático multimodal. Los puntos de referencia incluyeron MathVista_mini, MathVision, LogicVista y Mathverse_mini. MMR1-MATH-V0-7B entregó resultados innovadores, superando los modelos 7B de código abierto existentes y rivalizando con modelos incluso patentados con parámetros significativamente más grandes.

En particular, el modelo alcanzó el 71.0%de precisión en MathVista, superando las contrapartes notables como Qwen2.5-VL (68.2%) y LMM-R1 (63.2%). En MathVision, MMR1-MATH-V0-7B obtuvo un 30.2%, superando especialmente otros modelos prominentes en la misma clase de parámetros. Además, en Logicvista y Mathverse, el modelo registró cifras de rendimiento de 50.8% y 45.1%, respectivamente, superiores a casi todos los modelos comparables. Estos resultados destacan la generalización excepcional de MMR1-MATH-V0-7B y la destreza de razonamiento multimodal en contextos matemáticos.

Varias conclusiones clave de este lanzamiento incluyen:

- El modelo MMR1-MATH-V0-7B, desarrollado por los investigadores de NTU, establece un nuevo punto de referencia de última generación para el razonamiento matemático multimodal entre los modelos de parámetros 7B de código abierto.

- Logra un rendimiento superior utilizando un conjunto de datos de entrenamiento excepcionalmente pequeño de solo 6,000 muestras multimodales meticulosamente seleccionadas.

- Después de 6 horas de entrenamiento en 64 GPU de NVIDIA H100, un método de aprendizaje de refuerzo eficiente (GRPO) funciona de manera robusta.

- El conjunto de datos complementario de MMR1-MATH-RL-DATA-V0, que comprende 5,780 problemas de matemáticas multimodales, garantiza contenido diverso, equilibrado y desafiante para la capacitación de modelos.

- Superenta a otros modelos multimodales prominentes a través de puntos de referencia estándar, lo que demuestra una eficiencia excepcional, generalización y capacidad de razonamiento en escenarios matemáticos complejos.

Verificar el Página de la cara abrazada y Página de Github. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, siéntete libre de seguirnos Gorjeo Y no olvides unirte a nuestro Subreddit de 80k+ ml.

Sana Hassan, una pasante de consultoría en MarktechPost y estudiante de doble grado en IIT Madras, le apasiona aplicar tecnología e IA para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una nueva perspectiva a la intersección de la IA y las soluciones de la vida real.