Estaba segura de que los investigadores estaban haciendo trampa. A una de las voluntarias en el laboratorio de Nima Mesgarani en la Universidad de Columbia le implantaron electrodos en el cerebro, dos voces sonaban simultáneamente a través de un altavoz y la inquietante convicción de que en algún lugar de la habitación alguien estaba girando silenciosamente un dial. Las voces seguían entrando y saliendo. El que ella quería seguir se hincharía, el otro retrocedería. Le dijo al equipo que sentía como si alguien estuviera leyendo su mente. Que, en cierto modo, lo eran.

El experimento que Mesgarani y sus colegas han estado desarrollando durante más de una década tiene un concepto engañosamente simple. Estás en una fiesta. Alguien está hablando contigo y otras tres conversaciones ocurren a tu alrededor; de alguna manera tu cerebro se fija en la persona que te importa y filtra el resto en ruido de fondo. Este es el efecto cóctel, y todos lo hacemos de manera inconsciente, constante y con una fluidez que la tecnología auditiva actual no puede igualar. Los audífonos modernos amplifican todo indiscriminadamente. Pueden suprimir ciertos tipos de ruido de fondo, el tráfico por ejemplo, pero ante una sala llena de voces en competencia simplemente las aumentan a todas por igual. El resultado para las personas con pérdida auditiva suele ser un muro de sonido indiferenciado.

El enfoque que el equipo de Mesgarani ha estado desarrollando desde aproximadamente 2012 no comienza con micrófonos sino con neuronas. En aquel entonces, su laboratorio hizo un descubrimiento clave: la corteza auditiva produce una firma neuronal distinta para cualquier hablante al que una persona esté prestando atención. La sincronización de los picos y valles en la actividad de las ondas cerebrales refleja los ritmos del habla atendida de una manera que el habla desatendida no lo hace. Ese hallazgo planteó una pregunta obvia. Si pudieras leer esa firma en tiempo real, ¿podrías usarla para ajustar automáticamente lo que escucha una persona?

Ondas cerebrales en el asiento del conductor

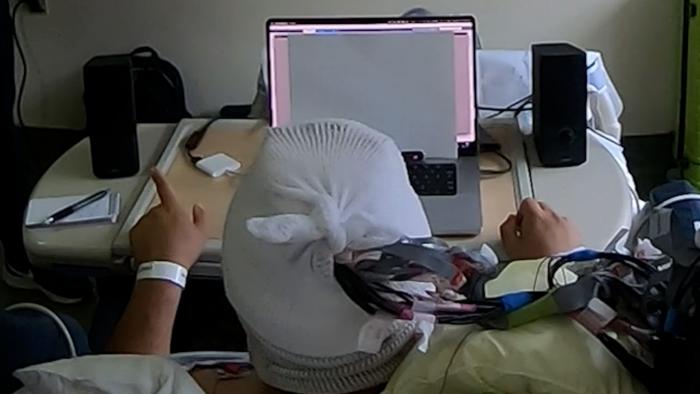

El nuevo estudio, publicado en Nature Neuroscience, proporciona la respuesta más clara hasta el momento. El equipo de Mesgarani trabajó con cuatro pacientes que ya estaban siendo sometidos a seguimiento clínico por epilepsia, lo que significa que ya tenían electrodos intracraneales colocados directamente sobre o dentro de su tejido cerebral. Las grabaciones de alta resolución de esos electrodos dieron a los investigadores una señal neuronal inusualmente limpia con la que trabajar. Los voluntarios escucharon pares de conversaciones superpuestas, cada una separada espacialmente por unos 15 grados, con ruido de peatones o balbuceos de fondo mezclados. Un algoritmo de aprendizaje automático entrenado con los datos cerebrales de cada participante aprendió a reconstruir la envolvente del habla de lo que sea que estuvieran atendiendo y luego lo comparó con las dos secuencias de audio para determinar qué conversación estaban siguiendo. Cuando el sistema se activaba, aumentaba gradualmente la conversación atendida hasta 9 decibelios y silenciaba la otra. Gradualmente, para evitar transiciones discordantes; Los investigadores descubrieron que la experiencia funcionaba mejor cuando los turnos se sentían fluidos.

En 80 pruebas, la precisión de la decodificación osciló entre el 72 y el 90 por ciento, muy por encima del nivel de probabilidad del 50 por ciento, y el sistema funcionó ya sea que los participantes fueran dirigidos a una voz en particular mediante una señal visual o simplemente dejaran que su atención vagara de forma natural. Rastreó los cambios de atención deliberados (tiempo medio de respuesta: poco más de cinco segundos) y los autoiniciados. Los voluntarios prefirieron la condición de sistema encendido en entre el 75 y el 95 por ciento de las pruebas. La dilatación de la pupila, un indicador fisiológico del esfuerzo cognitivo, se redujo significativamente cuando el sistema estaba activo. “Para que esto funcione en tiempo real, el sistema tiene que ser muy rápido, preciso y estable para que la experiencia sea agradable para el oyente”, dijo Mesgarani. Una voluntaria recordó a su tío, que tenía dificultades auditivas. “¿Te imaginas si esta tecnología existiera en un mundo [where] … ¿podría acceder a él? En realidad, podría vivir una vida mucho más pacífica…”.

El equipo también realizó una validación separada con 40 personas que tenían pérdida auditiva. Estos participantes escucharon audio que ya había sido procesado por el sistema de decodificación cerebral en tiempo real, modulado según las señales neuronales de los participantes intracraneales. Las personas con discapacidad más grave mostraron las mayores ganancias en inteligibilidad, lo que tiene cierto sentido intuitivo: cuanto más difícil es la tarea de escuchar, más importa el impulso. “Hemos desarrollado un sistema que actúa como una extensión neuronal del usuario”, dijo Mesgarani, “aprovechando la capacidad natural del cerebro para filtrar todos los sonidos en un entorno complejo para aislar dinámicamente la conversación específica que desean escuchar”.

De la teoría a la prueba

La frase “prueba de concepto” tiende a usarse en exceso, pero hay una razón por la que Vishal Choudhari, el primer autor del artículo e ingeniero que dirigió el desarrollo del sistema, sigue recurriendo a ella. Cientos de estudios realizados durante la última década han avanzado poco a poco hacia el mismo objetivo: mejorar los algoritmos de decodificación, probar diferentes configuraciones de electrodos e intentar separar las voces del audio mezclado. Ninguno había demostrado que todos los componentes pudieran funcionar juntos en tiempo real para ayudar a una persona a oír mejor. “La pregunta central sin respuesta”, dijo Choudhari, “era si la tecnología auditiva controlada por el cerebro podría ir más allá de los avances incrementales y llegar a un prototipo que pudiera ayudar a alguien a oír mejor en tiempo real”. Lo que el equipo de Columbia ha hecho ahora es superar ese listón, al menos en condiciones controladas. Su decodificador funcionaba con señales intracraneales de alta calidad, que no son el tipo de grabaciones que se pueden obtener sin neurocirugía. Lo tienen claro. El enfoque intracraneal se eligió deliberadamente para establecer lo que es posible cuando se tiene la señal neuronal más rica posible, no como modelo para un dispositivo que se vendería en una farmacia.

Aún así, la brecha entre este punto de referencia y algo portátil se ha ido reduciendo. Los avances recientes en los algoritmos de separación de voz significan que los sistemas en tiempo real ahora pueden operar con audio mixto en lugar de transmisiones previamente separadas; Los investigadores realizaron un análisis de control que mostró que su rendimiento de decodificación era casi idéntico ya sea que usaran fuentes de audio limpias o separadas algorítmicamente. El panorama de la neurotecnología también está cambiando: los dispositivos implantables se están volviendo más habituales para la epilepsia, la depresión y los trastornos del movimiento. Según estimaciones de la OMS, más de 430 millones de personas en todo el mundo viven con pérdida auditiva incapacitante, y la pérdida auditiva no tratada es uno de los principales factores de riesgo modificables de demencia. Existe un argumento clínico a favor de un implante mínimamente invasivo que no amplifica todo por igual.

También hay un argumento más sutil a favor de recurrir al cerebro en lugar de utilizar, por ejemplo, el seguimiento ocular o la orientación de la cabeza como indicador de la atención. Esos enfoques funcionan cuando miras directamente a quien quieres escuchar. Fallan cuando los conversadores están ubicados en el mismo lugar, cuando estás escuchando a alguien detrás de una puerta, cuando estás escuchando encubiertamente en la mesa de al lado. El cerebro, por el contrario, transporta información no sólo sobre dónde estás mirando sino también sobre lo que es semánticamente relevante para ti, lo que estás tratando de seguir, lo que has decidido filtrar. Sabe cosas que tus ojos no revelan.

Una cosa que encontraron los voluntarios de Columbia, en las sesiones informativas posteriores al experimento, fue que el sistema parecía natural. No es asistencial en el sentido mecánico. Podían dejar que su atención vagara entre los altavoces y el sistema los seguiría, cambiando el paisaje de audio a su alrededor. Parecía ciencia ficción, dijo uno de ellos. Tal vez. O tal vez se acerque más a lo que siempre ha estado haciendo el oído humano, sólo que se hace lo suficientemente visible como para copiarlo.

Preguntas frecuentes

¿Cómo funciona realmente el sistema auditivo controlado por el cerebro?

El sistema utiliza electrodos que registran la actividad eléctrica directamente desde la corteza auditiva del cerebro. Un algoritmo de aprendizaje automático aprende a reconstruir el patrón rítmico de cualquier flujo de voz al que esté atendiendo una persona y luego compara ese patrón con los flujos de audio reales que se están reproduciendo. Aparece cualquier conversación que mejor coincida con la señal reconstruida del cerebro; el otro está atenuado. Todo el proceso se ejecuta continuamente y se actualiza aproximadamente cada medio segundo.

¿Requeriría esto una cirugía cerebral para su uso?

El estudio actual utilizó electrodos intracraneales colocados directamente sobre o dentro del tejido cerebral, lo que requiere cirugía. Los investigadores eligieron este enfoque deliberadamente para establecer un punto de referencia de rendimiento utilizando las señales neuronales de mayor calidad disponibles. Reconocen que los dispositivos prácticos deberán funcionar con grabaciones menos invasivas y que el campo de la neurotecnología está avanzando hacia sistemas implantables más pequeños. Se han explorado versiones no invasivas basadas en EEG, pero tienden a lograr una menor precisión de decodificación.

¿Por qué los audífonos no pueden hacer esto separando las voces del ruido de fondo?

Los audífonos convencionales pueden suprimir ciertos tipos de ruido de fondo, como el tráfico o los zumbidos constantes, pero no pueden inferir cuál de varias voces en competencia quiere seguir realmente el oyente. Ante múltiples altavoces simultáneos, los amplifican a todos. El enfoque controlado por el cerebro evita esta limitación porque lee la intención del oyente directamente, en lugar de intentar inferirla únicamente a partir de las propiedades acústicas del sonido.

¿Con qué rapidez responde el sistema cuando cambia la atención a un hablante diferente?

En los experimentos de Columbia, el tiempo promedio de cambio fue de poco más de cinco segundos, lo que significa que ese fue el tiempo que tardó el equilibrio de audio en girar hacia un orador recién atendido. Los investigadores señalan que este no es un límite neurológico; refleja elecciones deliberadas de diseño, incluida una ventana de decodificación de cuatro segundos y un algoritmo de suavizado que evita saltos abruptos de volumen. Tiempos de respuesta más rápidos son técnicamente posibles, pero tienen como costo la estabilidad.

¿Quién se beneficiaría más de este tipo de tecnología?

El estudio de validación complementario encontró que las personas con pérdida auditiva más severa mostraron mayores mejoras en la inteligibilidad del habla, lo cual tiene sentido: cuanto más difícil es la tarea de escuchar, más significativo se vuelve el aumento en la señal atendida. Pero los investigadores también sugieren que podría reducir la fatiga auditiva en cualquier persona que se encuentre en entornos acústicos difíciles, incluidas aulas, restaurantes y lugares de trabajo, independientemente de si se les ha diagnosticado pérdida auditiva o no.

https://doi.org/10.1038/s41593-026-02281-5

Nota rápida antes de seguir leyendo.

ScienceBlog.com no tiene muros de pago, ni contenido patrocinado, ni ningún objetivo más allá de hacer la ciencia correcta. Cada historia aquí está escrita para informar, no para impresionar a un anunciante o promover un punto de vista.

El buen periodismo científico requiere tiempo: leer los artículos, comprobar las afirmaciones, encontrar investigadores que puedan poner los hallazgos en contexto. Hacemos ese trabajo porque creemos que es importante.

Si encuentra útil este sitio, considere apoyarlo con una donación. Incluso unos pocos dólares al mes ayudan a mantener la cobertura independiente y gratuita para todos.