Brain Implant permite que el hombre con ALS hable y cantara con su ‘voz real’

Una nueva interfaz cerebro-computadora convierte los pensamientos en canto y discurso expresivo en tiempo real

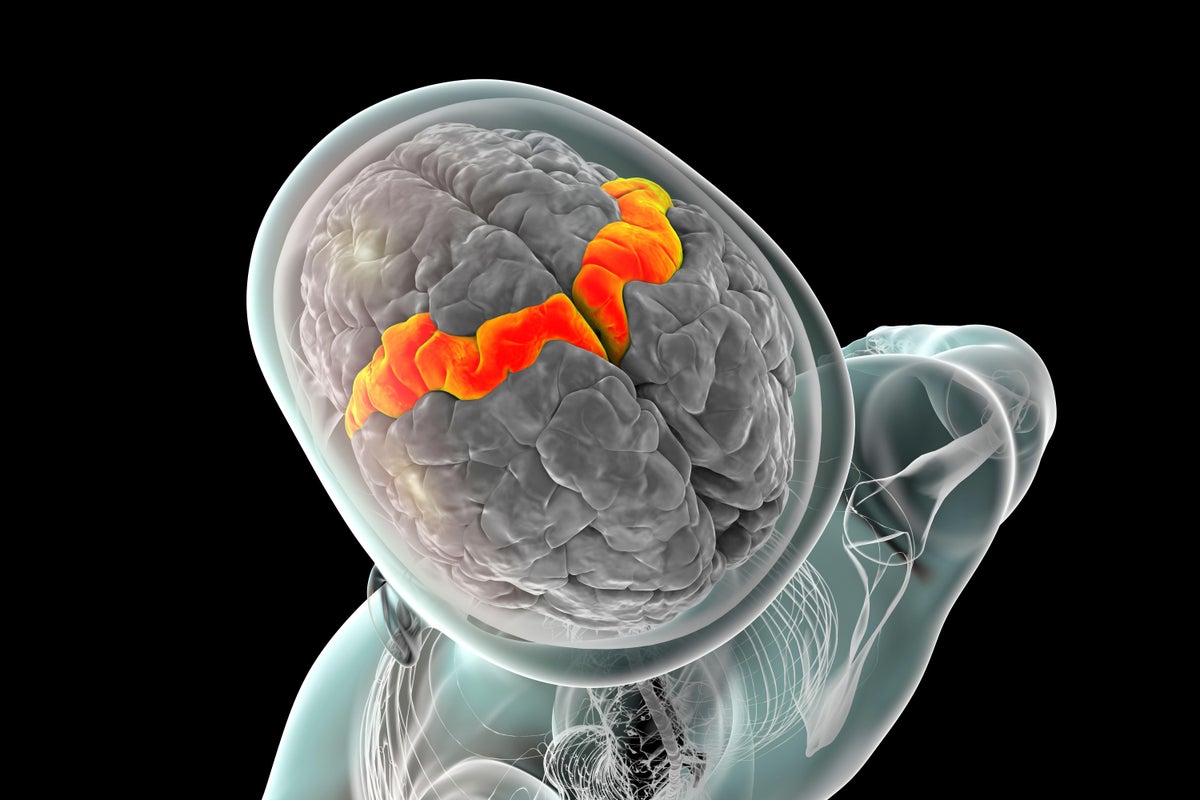

La corteza del motor (naranja, ilustración). Los electrodos implantados en esta región ayudaron a registrar la actividad cerebral relacionada con el habla de un hombre que no podía hablar de manera inteligible.

Kateryna Kon/Biblioteca de fotos de ciencias/Alamy Stock Photo

Un hombre con una discapacidad severa del habla es capaz de hablar expresivamente y cantar usando un implante cerebral que traduce su actividad neuronal en palabras casi instantáneamente. El dispositivo transmite cambios de tono cuando hace preguntas, enfatiza las palabras de su elección y le permite tararear una cadena de notas en tres lanzamientos.

El sistema, conocido como Una interfaz cerebral -compuadora (BCI) – Usó inteligencia artificial (IA) para decodificar la actividad cerebral eléctrica del participante mientras intentaba hablar. El dispositivo es el primero en reproducir no solo las palabras previstas de una persona, sino también características del habla natural, como el tono, el tono y el énfasis, que ayudan a expresar significado y emoción.

En un estudio, una voz sintética que imitaba la propia del participante hablaba sus palabras dentro de los 10 milisegundos de la actividad neuronal que señalaba su intención de hablar. El sistema, descrito hoy en Naturalezamarca una mejora significativa sobre los modelos BCI anteriores, que transmitió el discurso en tres segundos o lo produjo solo después de que los usuarios terminaron de imitar una oración completa.

Sobre el apoyo al periodismo científico

Si está disfrutando de este artículo, considere apoyar nuestro periodismo galardonado con suscripción. Al comprar una suscripción, está ayudando a garantizar el futuro de las historias impactantes sobre los descubrimientos e ideas que dan forma a nuestro mundo hoy.

“Este es el santo grial en el discurso bcis”, dice Christian Herff, un neurocientífico computacional de la Universidad de Maastricht, los Países Bajos, que no participó en el estudio. “Esto ahora es un discurso real, espontáneo y continuo”.

Decodificador en tiempo real

El participante del estudio, un hombre de 45 años, perdió su capacidad de hablar claramente después de desarrollar Esclerosis lateral amiotrófica, una forma de enfermedad de las neuronas motorasque daña los nervios que controlan los movimientos musculares, incluidos los necesarios para el habla. Aunque todavía podía hacer sonidos y palabras en la boca, su discurso era lento y poco claro.

Cinco años después de que comenzaron sus síntomas, el participante se sometió a una cirugía para insertar 256 electrodos de silicio, cada uno de 1,5 mm de largo, en una región cerebral que controla el movimiento. El coautor del estudio, Maitreyee Wairagkar, neurocientífico de la Universidad de California, Davis, y sus colegas entrenaron algoritmos de aprendizaje profundo para capturar las señales en su cerebro cada 10 milisegundos. Su sistema decodifica, en tiempo real, los sonidos que el hombre intenta producir en lugar de sus palabras previstas o los fonemas constituyentes, las subunidades del habla que forman palabras habladas.

“No siempre usamos palabras para comunicar lo que queremos. Tenemos interjecciones. Tenemos otras vocalizaciones expresivas que no están en el vocabulario”, explica Wairagkar. “Para hacer eso, hemos adoptado este enfoque, que es completamente sin restricciones”.

El equipo también personalizó la voz sintética para sonar como la propia del hombre, al entrenar algoritmos de IA en las grabaciones de entrevistas que había hecho antes del inicio de su enfermedad.

El equipo le pidió al participante que intentara hacer interjecciones como ‘AAH’, ‘OOH’ y ‘Hmm’ y decir palabras inventadas. El BCI produjo con éxito estos sonidos, demostrando que podría generar discurso sin necesidad de un vocabulario fijo.

Libertad de interlocución

Usando el dispositivo, el participante explicó las palabras, respondió a las preguntas abiertas y dijo lo que quisiera, usando algunas palabras que no formaban parte de los datos de entrenamiento del decodificador. Le dijo a los investigadores que escuchar la voz sintética producir su discurso lo hacía “sentirse feliz” y que se sentía como su “verdadera voz”.

En otros experimentos, el BCI identificó si el participante estaba intentando decir una oración como una pregunta o como una declaración. El sistema también podría determinar cuándo enfatizó las diferentes palabras en la misma oración y ajustar el tono de su voz sintética en consecuencia. “Estamos trayendo todos estos diferentes elementos del discurso humano que son realmente importantes”, dice Wairagkar. Los BCI anteriores solo podían producir un discurso plano y monótono.

“Este es un cambio de paradigma en el sentido de que realmente puede conducir a una herramienta de la vida real”, dice Silvia Marchesotti, una neuroingenera de la Universidad de Ginebra en Suiza. Las características del sistema “serían cruciales para la adopción para el uso diario para los pacientes en el futuro”.

Este artículo se reproduce con permiso y fue Primero publicado el 11 de junio de 2025.