El Mezcla de agentes (MOA) La arquitectura es un enfoque transformador para mejorar el rendimiento del modelo de lenguaje grande (LLM), especialmente en tareas complejas y abiertas donde un solo modelo puede luchar con precisión, razonamiento o especificidad de dominio.

Cómo funciona la arquitectura de la mezcla de agentes

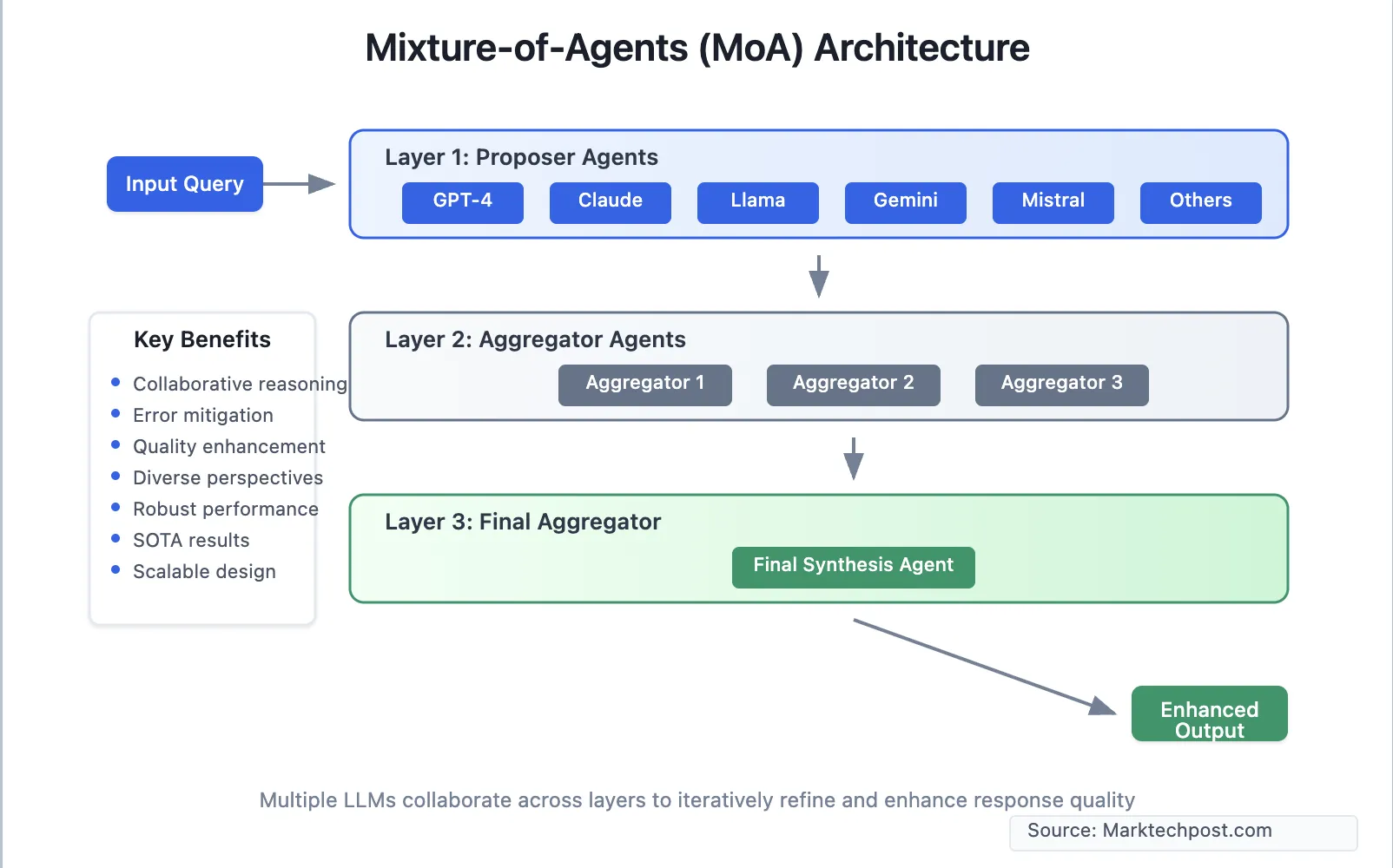

- Estructura en capas: MOA Frameworks organiza múltiples agentes especializados de LLM en capas. Cada agente dentro de una capa recibe todas las salidas de los agentes en la capa anterior como contexto para su propia respuesta: esto promueve salidas más ricas y más informadas.

- Especialización del agente: Cada agente puede adaptarse o ajustar para dominios específicos o tipos de problemas (por ejemplo, ley, medicina, finanzas, codificación), actuando de manera similar a un equipo de expertos, cada uno contribuyendo con ideas únicas.

- Síntesis de información colaborativa: El proceso comienza con un aviso que se distribuye entre los agentes de los proponentes que ofrecen posibles respuestas. Sus salidas colectivas están agregadas, refinadas y sintetizadas por capas posteriores (con agentes “agregadores”), creando gradualmente un resultado único, integral y de alta calidad.

- Refinamiento continuo: Al pasar respuestas a través de múltiples capas, el sistema mejora iterativamente la profundidad del razonamiento, la consistencia y la precisión, análoga a los paneles de expertos humanos que revisan y mejoran una propuesta.

¿Por qué MOA es superior a LLMS de un solo modelo?

- Mayor rendimiento: Los sistemas MOA han superado recientemente a los modelos individuales principales (como GPT-4 OMNI) en los puntos de referencia de evaluación LLM competitivos, logrando, por ejemplo, 65.1% en Alpacaeval 2.0 versus GPT-4 OMNI’s 57.5%, utilizando solo LLM de código abierto.

- Mejor manejo de tareas complejas de varios pasos: Delegar subtareas a agentes con experiencia específica de dominio permite respuestas matizadas y confiables incluso en solicitudes intrincadas. Esto aborda limitaciones clave de los modelos de “Jack-of-All-Trades”.

- Escalabilidad y adaptabilidad: Se pueden agregar nuevos agentes o reentrenados para abordar las necesidades emergentes, lo que hace que el sistema sea más ágil que reentrenarse un modelo monolítico en cada actualización.

- Reducción de errores: Al dar a cada agente un enfoque más estrecho y usar un orquestador para coordinar las salidas, las arquitecturas MOA reducen la probabilidad de errores y una interpretación errónea, lo que aumenta la confiabilidad y la interpretabilidad.

Analogía y aplicaciones del mundo real

Imagine un diagnóstico médico: un agente se especializa en radiología, otro en genómica, un tercero en tratamientos farmacéuticos. Cada uno revisa el caso de un paciente desde su propio ángulo. Sus conclusiones están integradas y ponderadas, con agregadores de nivel superior que ensamblan la mejor recomendación de tratamiento. Este enfoque ahora se está adaptando a la IA para todo, desde el análisis científico hasta la planificación financiera, la ley y la generación de documentos complejos.

Control de llave

- Inteligencia colectiva sobre IA monolítica: La arquitectura MOA aprovecha el colectivo Fortalezas de agentes especializados, que producen resultados que superan los modelos generalistas individuales.

- Resultados de SOTA y frontera de investigación abierta: Los mejores modelos MOA están estableciendo resultados de última generación en los puntos de referencia de la industria y son el foco de la investigación activa, impulsando la frontera de capacidad de la IA hacia adelante.

- Potencial transformador: Desde aplicaciones empresariales críticas hasta asistentes de investigación y automatización específica del dominio, la tendencia del MOA está remodelando lo que es posible con los agentes de IA.

En resumen, La combinación de agentes de IA especializados, cada uno con experiencia específica de dominio, a través de las arquitecturas de MOA conduce a resultados más confiables, matizados y precisos que cualquier LLM, especialmente para tareas sofisticadas y multidimensionales.

Fuente:

Asif Razzaq es el CEO de MarktechPost Media Inc .. Como empresario e ingeniero visionario, ASIF se compromete a aprovechar el potencial de la inteligencia artificial para el bien social. Su esfuerzo más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, MarktechPost, que se destaca por su cobertura profunda de noticias de aprendizaje automático y de aprendizaje profundo que es técnicamente sólido y fácilmente comprensible por una audiencia amplia. La plataforma cuenta con más de 2 millones de vistas mensuales, ilustrando su popularidad entre el público.