Los modelos de lenguaje grande (LLM) han ampliado recientemente su alcance más allá del procesamiento tradicional del lenguaje natural, demostrando un potencial significativo en tareas que requieren información multimodal. Destaca especialmente su integración con las capacidades de percepción de vídeo, un paso fundamental en la inteligencia artificial. Esta investigación da un gran paso al explorar las capacidades de los LLM en video grounding (VG), una tarea crítica en el análisis de video que implica identificar segmentos de video específicos basados en descripciones textuales.

El desafío central en VG radica en la precisión de la localización de los límites temporales. La tarea exige identificar con precisión las horas de inicio y finalización de los segmentos de vídeo en función de consultas textuales determinadas. Si bien los LLM se han mostrado prometedores en varios dominios, aún es necesario explorar su eficacia para realizar con precisión tareas de VG. Esta brecha en la investigación es lo que el estudio busca abordar, profundizando en las capacidades de los LLM en esta tarea matizada.

Los métodos tradicionales en VG han variado, desde técnicas de aprendizaje por refuerzo que ajustan ventanas temporales hasta densas redes de regresión que estiman distancias desde los fotogramas de vídeo hasta el segmento objetivo. Sin embargo, estos métodos dependen en gran medida de conjuntos de datos de entrenamiento especializados diseñados para VG, lo que limita su aplicabilidad en contextos más generalizados. La novedad de esta investigación radica en que se aleja de estos enfoques convencionales, proponiendo un método de evaluación más versátil y completo.

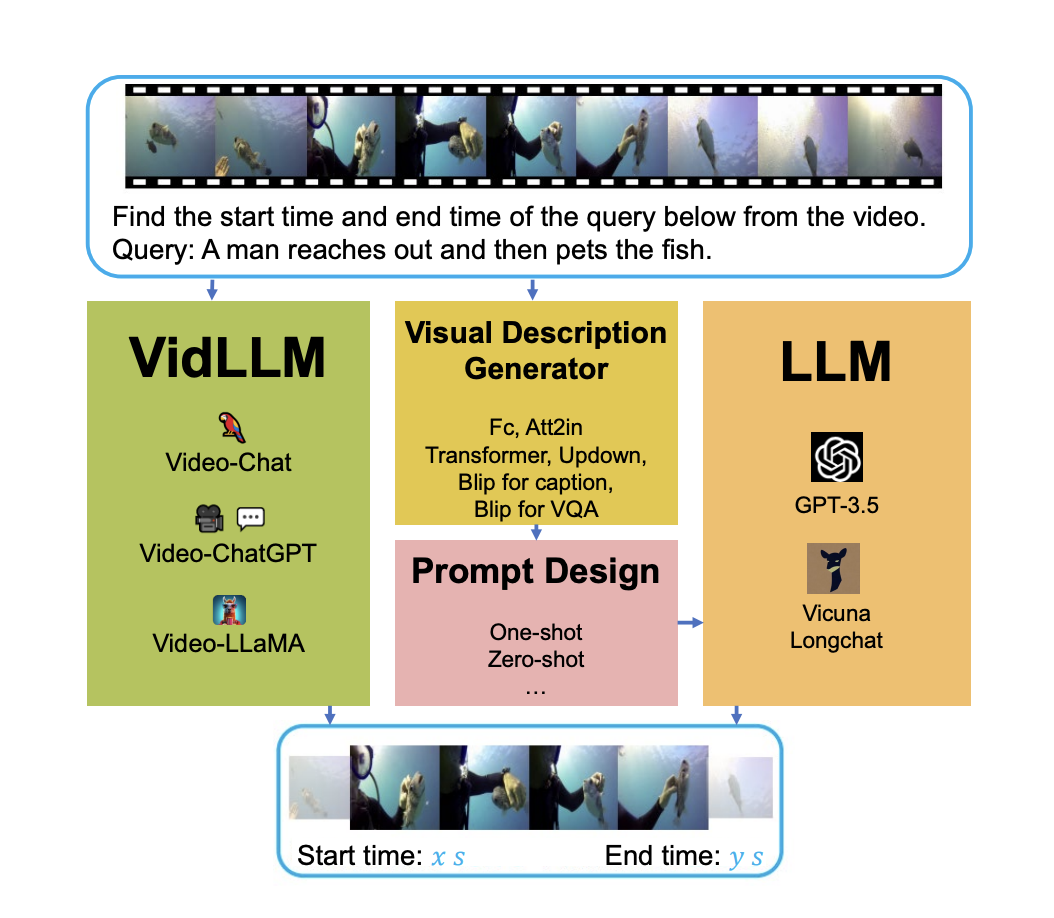

El investigador de la Universidad de Tsinghua presentó ‘LLM4VG’, un punto de referencia diseñado específicamente para evaluar el desempeño de los LLM en tareas de VG. Este punto de referencia considera dos estrategias principales: la primera involucra LLM de video entrenados directamente en conjuntos de datos de texto y video (VidLLM) y la segunda combina LLM convencionales con modelos visuales previamente entrenados. Estos modelos gráficos convierten el contenido de vídeo en descripciones textuales, cerrando la brecha de información visual-textual. Este enfoque dual permite una evaluación exhaustiva de las capacidades de los LLM para comprender y procesar contenido de video.

Una inmersión más profunda en la metodología revela las complejidades del enfoque. En la primera estrategia, los VidLLM procesan directamente el contenido de video y las instrucciones de tareas VG, generando predicciones basadas en su entrenamiento en pares de texto y video. La segunda estrategia es más compleja e involucra LLM y modelos de descripción visual. Estos modelos generan descripciones textuales de contenido de video integradas con instrucciones de tareas VG a través de indicaciones cuidadosamente diseñadas. Estas indicaciones están diseñadas para combinar de manera efectiva la instrucción de VG con la descripción visual proporcionada, lo que permite a los LLM procesar y comprender el contenido del video sobre la tarea.

La evaluación del desempeño de estas estrategias arrojó algunos resultados notables. Se observó que los VidLLM, a pesar de su capacitación directa en contenido de video, todavía tienen un retraso significativo en lograr un rendimiento VG satisfactorio. Este hallazgo subraya la necesidad de incorporar más tareas de video relacionadas con el tiempo en su entrenamiento para mejorar el rendimiento. Por el contrario, la combinación de LLM con modelos visuales mostró habilidades preliminares en tareas VG. Esta estrategia superó a VidLLM, lo que sugiere una dirección prometedora para futuras investigaciones. Sin embargo, el rendimiento se vio limitado principalmente por las limitaciones de los modelos visuales y el diseño de las indicaciones. El estudio indica que modelos gráficos más refinados, capaces de generar descripciones de vídeo detalladas y precisas, podrían mejorar sustancialmente el rendimiento de VG de los LLM.

En conclusión, la investigación presenta una evaluación innovadora de los LLM en el contexto de las tareas de VG, enfatizando la necesidad de enfoques más sofisticados en la capacitación de modelos y el diseño rápido. Si bien los VidLLM actuales necesitan una mayor comprensión temporal, la integración de los LLM con modelos visuales abre nuevas posibilidades, lo que marca un importante paso adelante en este campo. Los hallazgos de este estudio no solo arrojan luz sobre el estado actual de los LLM en tareas de VG, sino que también allanan el camino para avances futuros, revolucionando potencialmente la forma en que se analiza y comprende el contenido de video.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de más de 35.000 ml, 41k+ comunidad de Facebook, Canal de discordia, LinkedIn Grarribay Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Muhammad Athar Ganaie, pasante de consultoría en MarktechPost, es un defensor del aprendizaje profundo eficiente, con especial atención en la capacitación dispersa. Cursando un M.Sc. en Ingeniería Eléctrica, con especialización en Ingeniería de Software, combina conocimientos técnicos avanzados con aplicaciones prácticas. Su esfuerzo actual es su tesis sobre “Mejora de la eficiencia en el aprendizaje por refuerzo profundo”, que muestra su compromiso de mejorar las capacidades de la IA. El trabajo de Athar se encuentra en la intersección “Capacitación escasa en DNN” y “Aprendizaje por refuerzo profundo”.