Después de décadas de bajo rendimiento, la inteligencia artificial (IA) de repente volverse aterradoramente bueno. Y si no tenemos mucho cuidado puede llegar a ser bastante peligroso—incluso tan peligroso que constituye un “riesgo existencial”a la humanidad.

Geoffrey Hinton, uno de los más creíbles”fatalistas” porque trabajó para Google durante muchos años y es conocido como “el padrino de la IA”, ha advertido repetidamente que estas amenazas no son sólo ciencia ficción. Él tiene dichopor ejemplo: “Es difícil ver cómo se puede evitar que los malos actores utilicen [AI] para cosas malas”.

La Casa Blanca, algunos líderes mundiales y muchas empresas de inteligencia artificial están intentando evitar que esto suceda, pero sus esfuerzos no serán suficientes. Si queremos asegurarnos de que la IA no cause daños irreparables, debemos detener el desarrollo de modelos de IA hasta que tengamos un debate adecuado sobre la seguridad de la IA. No hay otra manera.

Para muchas personas que escuchan sobre preocupaciones sobre la IA, existe una desconexión entre Los chatbots actuales como ChatGPT, Bard y Claude 2.y el potencial de una IA superinteligente malvada que domine el mundo. ¿Cómo llegamos de aquí hasta allá?

La idea clave es la mejora exponencial de la IA, que probablemente alcanzará muy pronto el umbral de una inteligencia mejor que la humana. Esta inteligencia artificial general (AGI) se describe generalmente como una IA que es tan buena o mejor en la mayoría o en todas las tareas cognitivas humanas, como el lenguaje, la resolución de problemas, las matemáticas, el razonamiento y la creatividad. Una vez logrado, AGI incluso construirá una IA más inteligente y a un ritmo mucho más rápido que el que podrían crear los humanos. Eso significa que podrá mejorarse exponencialmente. Cuando esto suceda probablemente pasaremos por un “espuma!” momento de crecimiento extremadamente rápido de la inteligencia para luego llegar a lo que algunos llaman superinteligencia artificial (ASI).

Se puede pensar en ASI como una IA con poderes divinos. Si el ser humano más inteligente que jamás haya existido tuviera tal vez un coeficiente intelectual de 200, ASI podría tener un coeficiente intelectual de un millón o más (pero, por supuesto, cualquier escala de prueba creada por humanos no tendría significado para una entidad tan inteligente).

AGI y ASI probablemente podrán construir robots sobrehumanos eso se convertirá en sus cuerpos. Si esos robots están controlados por IA o por humanos, cambiarán, como mínimo, todo lo que hacemos en las sociedades humanas y, en el peor de los casos, serán utilizados por gobiernos y corporaciones sin escrúpulos (o IA sin escrúpulos) para ejercer control sobre la humanidad.

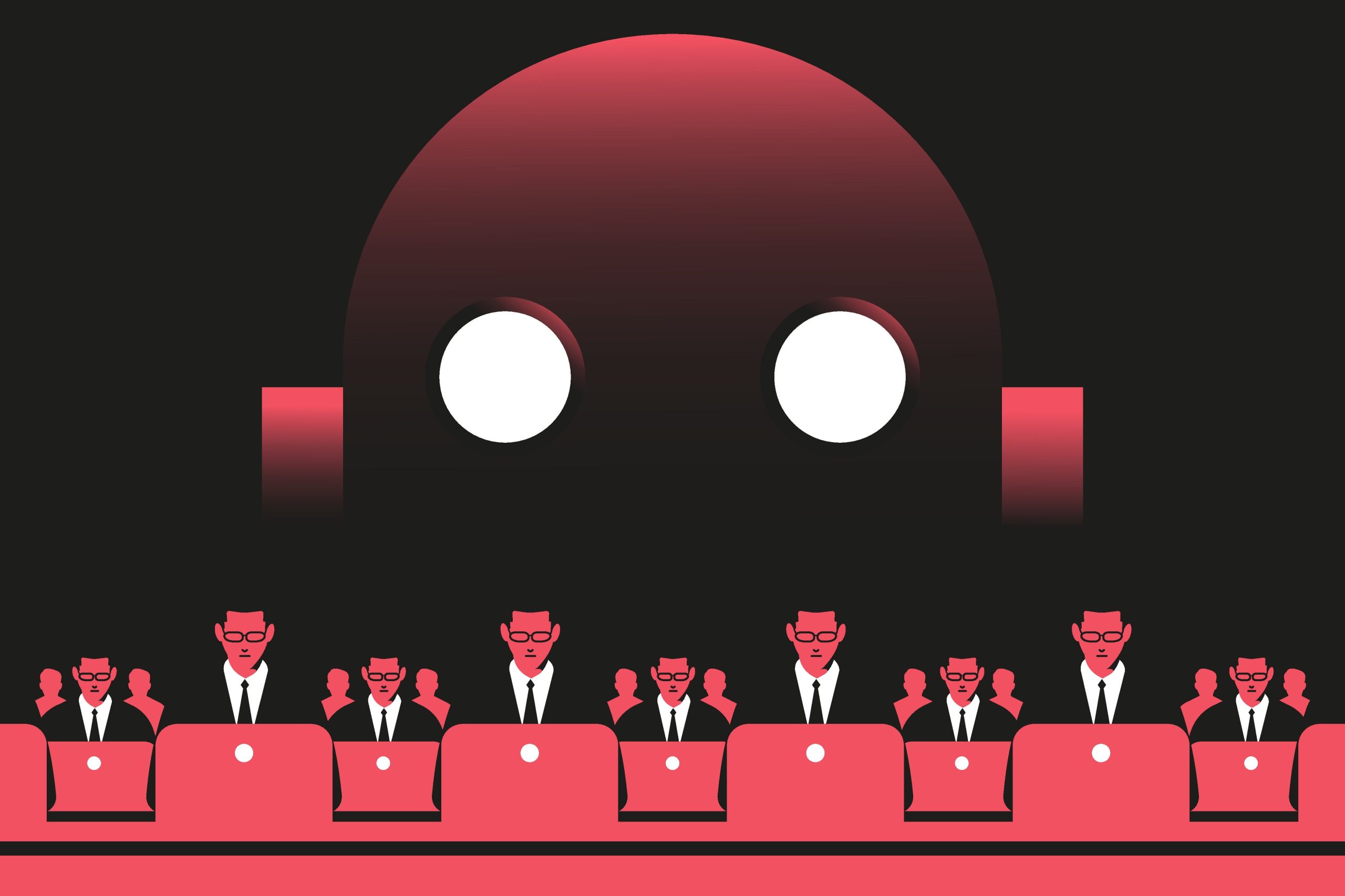

Sin embargo, el riesgo más probable a corto plazo no será una IA autónoma desbocada; más bien, serían humanos usando AGI/ASI para objetivos maliciosos. Competencia de “grandes potencias”, por ejemplo entre Estados Unidos y China, y la IA que ya está aquí carrera de armamentos podría llegar fácilmente al punto en que la IA autónoma se haga cargo de casi todos los aspectos de la estrategia y la realización de la guerra, y los humanos simplemente pierden el control de la trama.

Se están realizando muchos esfuerzos para prevenir escenarios peligrosos de IA, como se mencionó. La Casa Blanca emitió un comunicado de gran alcance. orden ejecutiva en noviembre que posiciona al gobierno federal para responder a la IA en muchas áreas. Los líderes mundiales se reunieron en el Reino Unido para discutir la seguridad de la IA y emitieron el Declaración de Bletchley que ponga en marcha un proceso internacional. Líderes de la industria como Abierto AI han comenzado un Iniciativa de superalineación y Foro del modelo de frontera. OpenAI y antrópicoun competidor fundado por ex empleados de OpenAI. específicamente para centrarse en una IA más segura.

Pero ninguno de estos esfuerzos logrará su objetivo de hacer que AGI sea seguro.

ahora sabemos no hay solución a lo que se llama “el problema de control” o “el problema de alineación” de IA. El profesor de informática Roman Yampolskiy detalló por qué en 2022 Revista de ciberseguridad y movilidad papel. Su argumento se centra en cómo funciona la IA y en hacer y verificar predicciones al respecto, algo casi imposible incluso con la IA actual, a menudo descrita como una “caja negra”, y mucho menos con la IA superinteligente que se avecina en el horizonte. Descubrió que no podemos entender cómo funciona la IA ahora ni predecir sus acciones futuras, incluso cuando la IA todavía está muy por debajo de la superinteligencia, lo que elimina cualquier esperanza de controlar la tecnología a medida que se vuelve cada vez más inteligente. La conclusión es que la IA será cada vez más inescrutable y, por tanto, incontrolable para los simples humanos a medida que tienda hacia AGI/ASI.

Imaginar que podemos entender AGI/ASI, y mucho menos controlarlo, es como pensar que un hilo de una telaraña podría contener a Godzilla. Cualquier solución que podamos desarrollar será sólo probabilística, no hermética. Dado que es probable que la AGI se convierta en superinteligencia prácticamente de la noche a la mañana, no podemos aceptar soluciones probabilísticas porque la IA será tan inteligente que explotará cualquier pequeño agujero, por pequeño que sea. (¿Ya pasó el “foom”? Sugerente informes sobre “Q*” a raíz del extraño drama en Open AI en noviembre sugieren que foom puede que ya sea real).

Si lo único que tendremos son soluciones con fugas, todos los esfuerzos para crear una “IA más segura”, desde órdenes ejecutivas hasta estándares industriales, equivalen a permitir el desarrollo irresponsable de una IA cada vez más poderosa, bajo la visión de que alguien, en algún lugar, tendrá las soluciones a tiempo.

Pero, ¿qué pasa si nunca llegan soluciones reales, según la lógica que he descrito aquí? Entonces habremos convocado al demonio, sin posibilidad de enviarlo de regreso al lugar de donde vino.

En diálogo con el jefe de seguridad de IA de OpenAI, Jan Leike, sobre estos temas. Le pregunté sobre la necesidad de soluciones esencialmente perfectas para la seguridad de la IA, dada la magnitud del riesgo, y respondió que “no existe lo ‘perfecto’ en el mundo real, pero sí lo que es ‘suficientemente bueno’ y ‘no lo suficientemente bueno’. Lo que sea exactamente la barra depende de cómo se desarrolle la tecnología”.

Le pregunté qué sucede si ocurre “foom” antes de que haya soluciones sólidas (probabilísticas) al problema de control. Me dijo: “Ya sabes la respuesta a esta pregunta”.

La conclusión clara de esta cadena de lógica, en mi opinión, es que debemos detener el desarrollo “fronterizo” de la IA (el desarrollo de nuevos modelos masivos de lenguajes de IA como GPT 5) ahora, a nivel mundial, mientras mantenemos un debate colectivo sobre la seguridad de la IA.

Yampolskiy y yo hemos mantenido un debate amistoso sobre estos temas. Si bien está de acuerdo en que sólo puede haber soluciones probabilísticas para alinear la IA con los valores y objetivos humanos (literalmente escribió el artículo sobre esto), cree que esto puede ser mejor que nada. Me dijo que ve que los esfuerzos para encontrar soluciones capaces de producir una IA alineada y controlable pasarán de una probabilidad del 1 por ciento a quizás un 2 por ciento.

Compartí mi opinión de que parece más probable que pase de una probabilidad de 1 entre un billón de AGI alineado a una probabilidad de 2 entre un billón.

Él respondió: “Entonces me estás diciendo que hay una posibilidad”.

Esta es muy probablemente la conversación más importante que jamás haya tenido la humanidad. Comencemos ahora.

Este es un artículo de opinión y análisis, y las opiniones expresadas por el autor o autores no son necesariamente las de Científico americano.