El procesamiento del lenguaje natural (PNL) ha revolucionado debido a la autoatención, el elemento clave del diseño del transformador, que permite al modelo reconocer conexiones intrincadas dentro de secuencias de entrada. La autoatención otorga a varios aspectos de la secuencia de entrada cantidades variables de prioridad al evaluar la relevancia del token relevante entre sí. La otra técnica ha demostrado ser muy buena para capturar relaciones de largo alcance, lo cual es importante para el aprendizaje por refuerzo, la visión por computadora y las aplicaciones de PNL. Los transformadores y los mecanismos de autoatención han logrado un éxito notable, despejando el camino para la creación de modelos de lenguaje complejos como GPT4, Bard, LLaMA y ChatGPT.

¿Pueden describir el sesgo implícito de los transformadores y el panorama de optimización? ¿Cómo elige y combina tokens la capa de atención cuando se entrena con descenso de gradiente? Investigadores de la Universidad de Pensilvania, la Universidad de California, la Universidad de Columbia Británica y la Universidad de Michigan responden a estos problemas vinculando cuidadosamente la geometría de optimización de la capa de atención con el problema SVM de margen máximo estricto (Att-SVM), que separa y elige los mejores tokens de cada secuencia de entrada. Los experimentos muestran que este formalismo, que se basa en trabajos anteriores, es prácticamente significativo e ilumina los matices de la autoatención.

En todo momento, investigan los modelos fundamentales de atención cruzada y autoatención utilizando secuencias de entrada X, Z ∈ R.T×d con longitud T y dimensión de incrustación d: aquí, las matrices de clave, consulta y valor entrenables son K, Q ∈ Rd×my V ∈ Rd×v respectivamente. S(.) representa la no linealidad softmax, que se aplica por filas a XQK⊤X⊤. Al establecer Z ← X, se puede ver que la autoatención (1b) es un caso único de atención cruzada (1a). Considere usar el token inicial de Z, representado por z, para que la predicción revele sus principales hallazgos.

Específicamente, abordan la minimización empírica del riesgo con una función de pérdida decreciente l(): RR, expresado de la siguiente manera: Dado un conjunto de datos de entrenamiento (YiXizi)norteyo=1 con etiquetas Yi ∈ {−1, 1} y entradas Xi ∈RT×dzi ∈Rd, evalúan lo siguiente: El cabezal de predicción en este caso, denotado por el símbolo h( . ), incluye los pesos de valor V. En esta formulación, un MLP sigue la capa de atención en el modelo f( . ), que representa con precisión una Transformador de una capa. La autoatención se restaura en (2) configurando zi ←xi1donde xi1 designa el primer token de la secuencia Xi. Debido a su carácter no lineal, la operación softmax presenta un obstáculo considerable para la optimización (2).

El problema es no convexo y no lineal, incluso cuando el cabezal de predicción es fijo y lineal. Este trabajo optimiza los pesos de atención (K, Q o W) para superar estas dificultades y establecer una equivalencia SVM básica.

Las siguientes son las contribuciones clave del artículo:

• El sesgo de atención implícito de la capa. Con el objetivo de la norma nuclear del parámetro combinado W:= KQ (Thm 2), la optimización de los parámetros de atención (K, Q) con regularización decreciente converge en la dirección de una solución de margen máximo de (Att-SVM). La ruta de regularización (RP) converge direccionalmente a la solución (Att-SVM) con el objetivo de la norma Frobenius cuando la atención cruzada está parametrizada explícitamente por el parámetro de combinación W. Hasta donde saben, este es el primer estudio que compara formalmente la dinámica de optimización de (K, Q) a las de las parametrizaciones (W), destacando el sesgo de rango bajo de este último. El Teorema 11 y SAtt-SVM en el apéndice describen cómo su teoría se extiende fácilmente a contextos de categorización causal o de secuencia a secuencia y define claramente la optimización de los tokens elegidos.

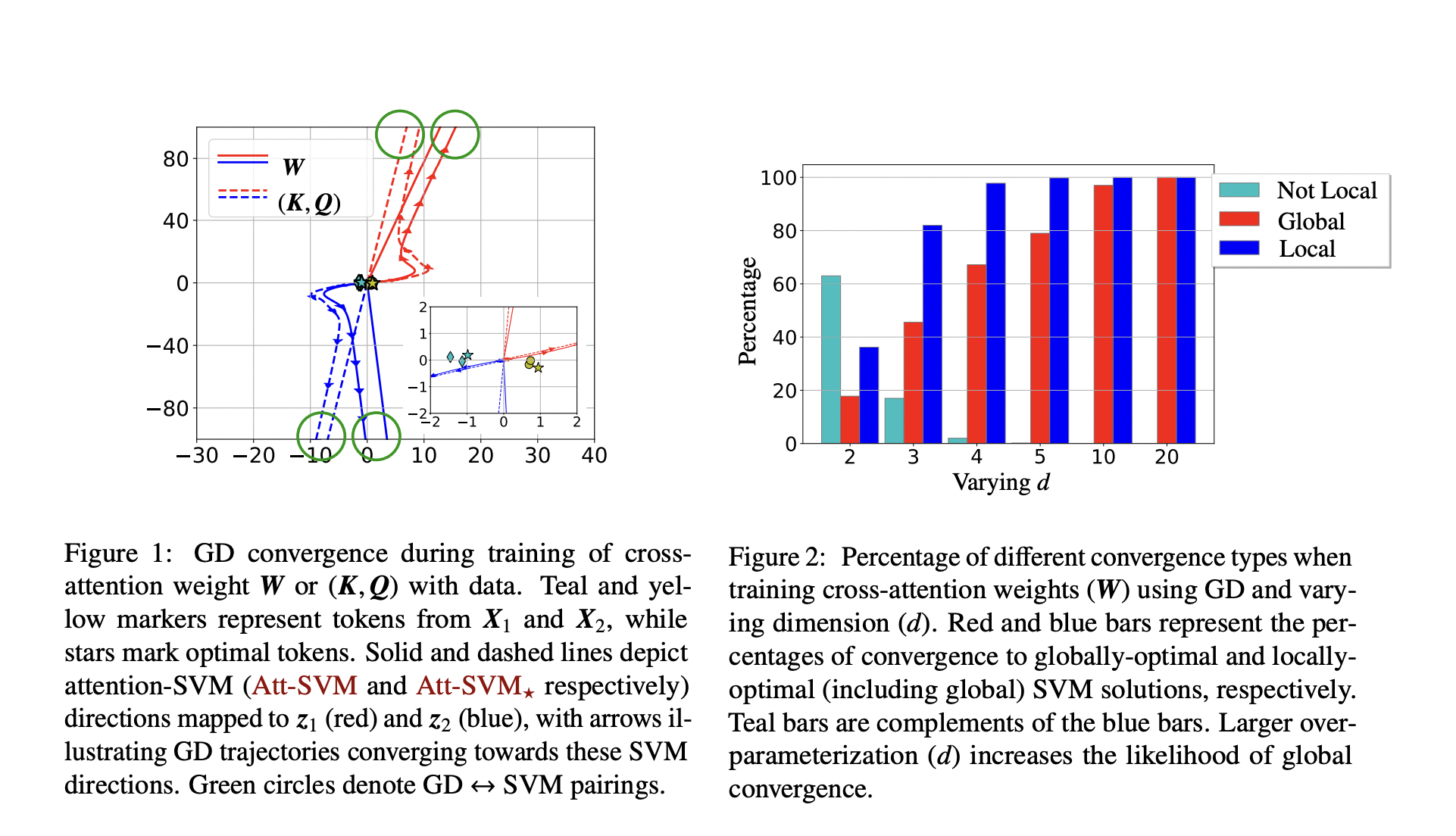

• Convergencia de descenso de gradiente. Con la inicialización adecuada y un cabezal lineal h(), las iteraciones de descenso de gradiente para la variable de consulta clave combinada W convergen en la dirección de una solución Att-SVM que es localmente óptima. Los tokens seleccionados deben funcionar mejor que los tokens circundantes para lograr la optimización local. Las reglas localmente óptimas se definen en la siguiente geometría del problema, aunque no siempre son únicas. Contribuyen significativamente al identificar los parámetros geométricos que aseguran la convergencia hacia la dirección global óptima. Estos incluyen (i) la capacidad de diferenciar tokens ideales en función de sus puntuaciones o (ii) la alineación de la dirección del gradiente inicial con los tokens óptimos. Más allá de esto, demuestran cómo la parametrización excesiva (es decir, que la dimensión d sea grande y condiciones equivalentes) promueve la convergencia global al garantizar la viabilidad (Att-SVM) y el panorama de optimización (benigno), lo que significa que no hay puntos estacionarios ni localmente óptimos ficticios. direcciones.

• La generalidad de la equivalencia SVM. La capa de atención, a menudo conocida como atención dura cuando se optimiza con h() lineal, está intrínsecamente predispuesta a elegir un token de cada secuencia. Como resultado de que los tokens de salida son combinaciones convexas de los tokens de entrada, esto se refleja en (Att-SVM).

Sin embargo, demuestran que las cabezas no lineales necesitan la creación de varias fichas, lo que subraya la importancia de estos componentes para la dinámica del transformador. Sugieren una equivalencia SVM más amplia al concluir su teoría. Sorprendentemente, muestran que su hipótesis predice correctamente el sesgo implícito de la atención entrenada mediante el descenso de gradiente en condiciones amplias que el enfoque no aborda (por ejemplo, h() es un MLP). Sus ecuaciones generales disocian específicamente los pesos de atención en dos componentes: un componente finito que determina la composición precisa de las palabras seleccionadas modificando las probabilidades softmax y un componente direccional controlado por SVM que selecciona los tokens aplicando una máscara 0-1.

El hecho de que estos resultados puedan verificarse matemáticamente y aplicarse a cualquier conjunto de datos (siempre que SVM sea práctico) es un aspecto clave de ellos. A través de experimentos reveladores, confirman exhaustivamente la equivalencia del margen máximo y el sesgo implícito de los transformadores. Creen que estos resultados contribuyen a nuestro conocimiento de los transformadores como procesos jerárquicos de selección de tokens de margen máximo, y anticipan que sus hallazgos proporcionarán una base sólida para futuras investigaciones sobre la dinámica de optimización y generalización de los transformadores.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de más de 30.000 ml, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Aneesh Tickoo es pasante de consultoría en MarktechPost. Actualmente está cursando su licenciatura en Ciencia de Datos e Inteligencia Artificial en el Instituto Indio de Tecnología (IIT), Bhilai. Pasa la mayor parte de su tiempo trabajando en proyectos destinados a aprovechar el poder del aprendizaje automático. Su interés de investigación es el procesamiento de imágenes y le apasiona crear soluciones en torno a él. Le encanta conectarse con personas y colaborar en proyectos interesantes.