En el panorama cambiante del procesamiento del lenguaje natural (PNL), la capacidad de captar y procesar contextos textuales extensos es primordial. Los avances recientes, como lo destacan Lewis et al. (2021), Izacard et al. (2022), y Ram et al. (2023), han impulsado significativamente las capacidades de los modelos de lenguaje, particularmente a través del desarrollo de incrustaciones de texto. Estas incorporaciones sirven como columna vertebral para una gran cantidad de aplicaciones, incluida la generación de recuperación aumentada para modelos de lenguaje grandes (LLM) y búsqueda semántica. Transforman oraciones o documentos en vectores de baja dimensión, capturando la esencia de la información semántica, lo que a su vez facilita tareas como agrupación, clasificación y recuperación de información.

Sin embargo, una limitación evidente ha sido la extensión del contexto que estos modelos pueden manejar. La mayoría de los modelos de código abierto ampliamente reconocidos en el benchmark MTEB, como el E5 de Wang et al. (2022), GTE de Li et al. (2023) y BGE de Xiao et al. (2023), se limitan a una longitud de contexto de 512 tokens. Esta restricción socava su utilidad en escenarios donde es crucial comprender el contexto más amplio del documento. Por el contrario, modelos capaces de superar una longitud de contexto de 2048, como Voyage-lite-01-instruct de Voyage (2023) y text-embedding-ada-002 de Neelakantan et al. (2022), permanecen a puerta cerrada.

En este contexto, la introducción de texto-nomicembed-v1 marca un hito significativo. Este modelo no sólo es de código abierto, sino que también cuenta con una impresionante longitud de secuencia de 8192, superando a sus predecesores en evaluaciones de contexto tanto a corto como a largo plazo. Lo que lo distingue es su enfoque integral, que combina las fortalezas de los pesos abiertos, los datos abiertos y un diseño de parámetros de 137 millones bajo una licencia Apache-2, lo que garantiza accesibilidad y transparencia.

El camino para lograr tal hazaña implicó etapas meticulosas de preparación de datos y entrenamiento de modelos. Inicialmente, un Entrenamiento previo al modelado de lenguaje enmascarado La fase utilizó recursos como BooksCorpus y un volcado de Wikipedia de 2023, empleando el tokenizador bert-base-uncased para crear fragmentos de datos adecuados para el entrenamiento en contextos prolongados. Esto fue seguido por Preentrenamiento contrastivo no supervisadoaprovechando una amplia colección de 470 millones de pares en diversos conjuntos de datos para refinar la comprensión del modelo mediante filtrado consistente e incrustación selectiva.

La arquitectura de nomicembed-text-v1 refleja una cuidadosa adaptación de BERT para adaptarse a la longitud extendida de la secuencia. Innovaciones como las incrustaciones posicionales rotativas, la activación de SwiGLU y la integración de Flash Attention resaltan una revisión estratégica para mejorar el rendimiento y la eficiencia. El régimen de entrenamiento del modelo, caracterizado por una tasa de enmascaramiento del 30 % y configuraciones optimizadas, subraya aún más el esfuerzo riguroso para lograr resultados óptimos.

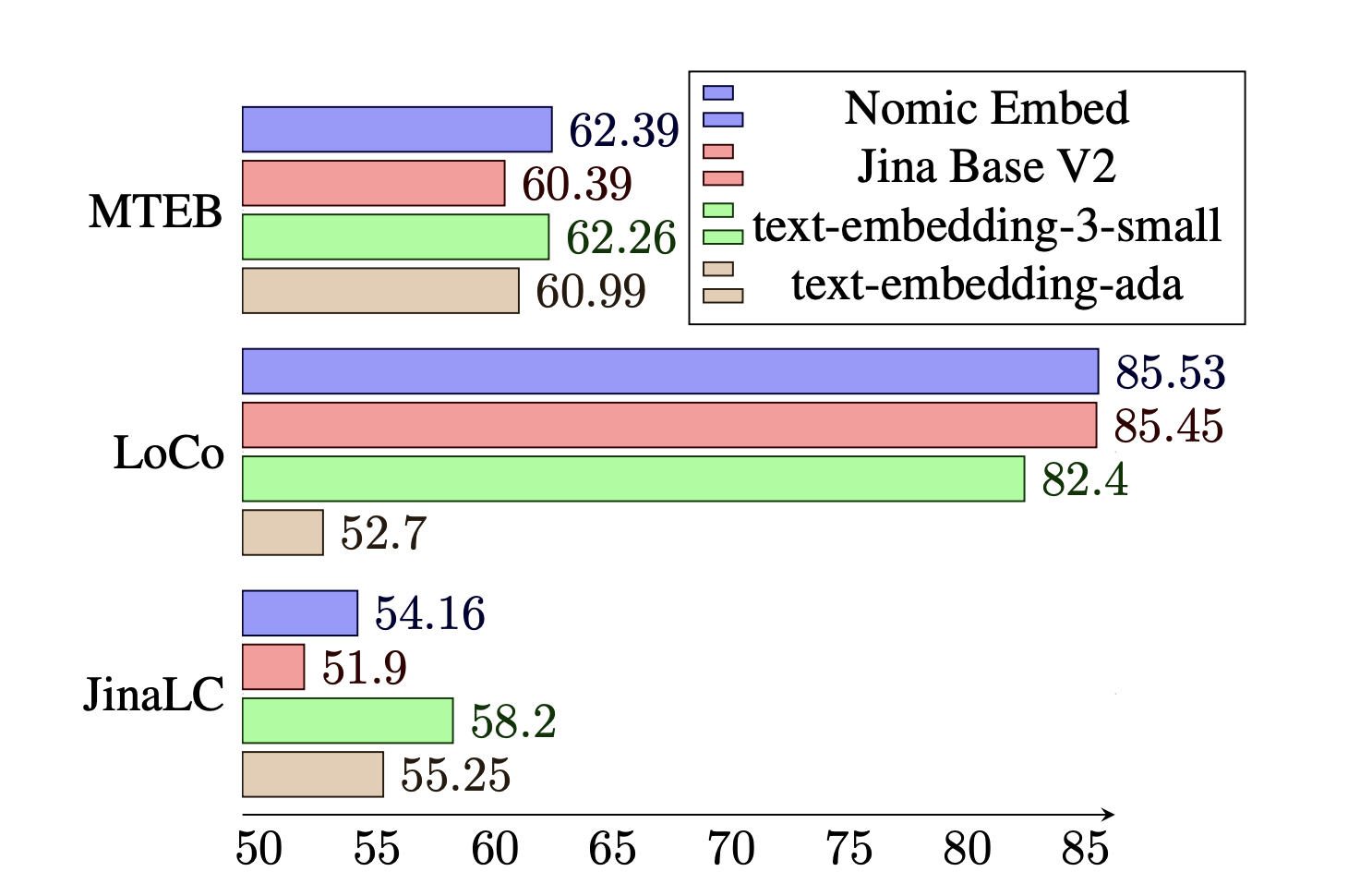

Cuando se sometió a los rigores de puntos de referencia como GLUE, MTEB y evaluaciones especializadas de contexto prolongado, nomicembed-text-v1 demostró una destreza excepcional. Cabe destacar su desempeño en el Punto de referencia de contexto largo de JinaAI y el Punto de referencia LoCo subraya su superioridad en el manejo de textos extensos, un área en la que muchos predecesores fallaron.

Sin embargo, el viaje de nomicembed-text-v1 se extiende más allá de las meras métricas de rendimiento. Su proceso de desarrollo, que enfatiza la auditabilidad de un extremo a otro y el potencial de replicación, establece un nuevo estándar de transparencia y apertura en la comunidad de IA. Al publicar los pesos del modelo, la base del código y un conjunto de datos de entrenamiento seleccionado, el equipo detrás texto-nomicembed-v1 invita a la innovación y el escrutinio continuos.

En conclusión, texto-nomicembed-v1 surge no sólo como un avance tecnológico sino como un faro para el movimiento de código abierto en IA. Desmantela las barreras de entrada en el dominio de la incorporación de textos de contexto largo, prometiendo un futuro en el que la profundidad de la comprensión coincida con la amplitud del discurso humano.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 37k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Vineet Kumar es pasante de consultoría en MarktechPost. Actualmente está cursando su licenciatura en el Instituto Indio de Tecnología (IIT), Kanpur. Es un entusiasta del aprendizaje automático. Le apasiona la investigación y los últimos avances en Deep Learning, Computer Vision y campos relacionados.