El Instituto de Innovación Tecnológica (TII) de Abu Dhabi ha presentado recientemente el Halcón Mamba 7Bun modelo de inteligencia artificial innovador. Este modelo, el primer modelo 7B fuerte sin atención, está diseñado para superar muchas de las limitaciones que enfrentan las arquitecturas de IA existentes, en particular en el manejo de grandes secuencias de datos. FalconMamba 7B se lanzó bajo la licencia TII Falcon 2.0. Está disponible como un modelo de acceso abierto dentro del ecosistema Hugging Face, lo que lo hace accesible para investigadores y desarrolladores de todo el mundo.

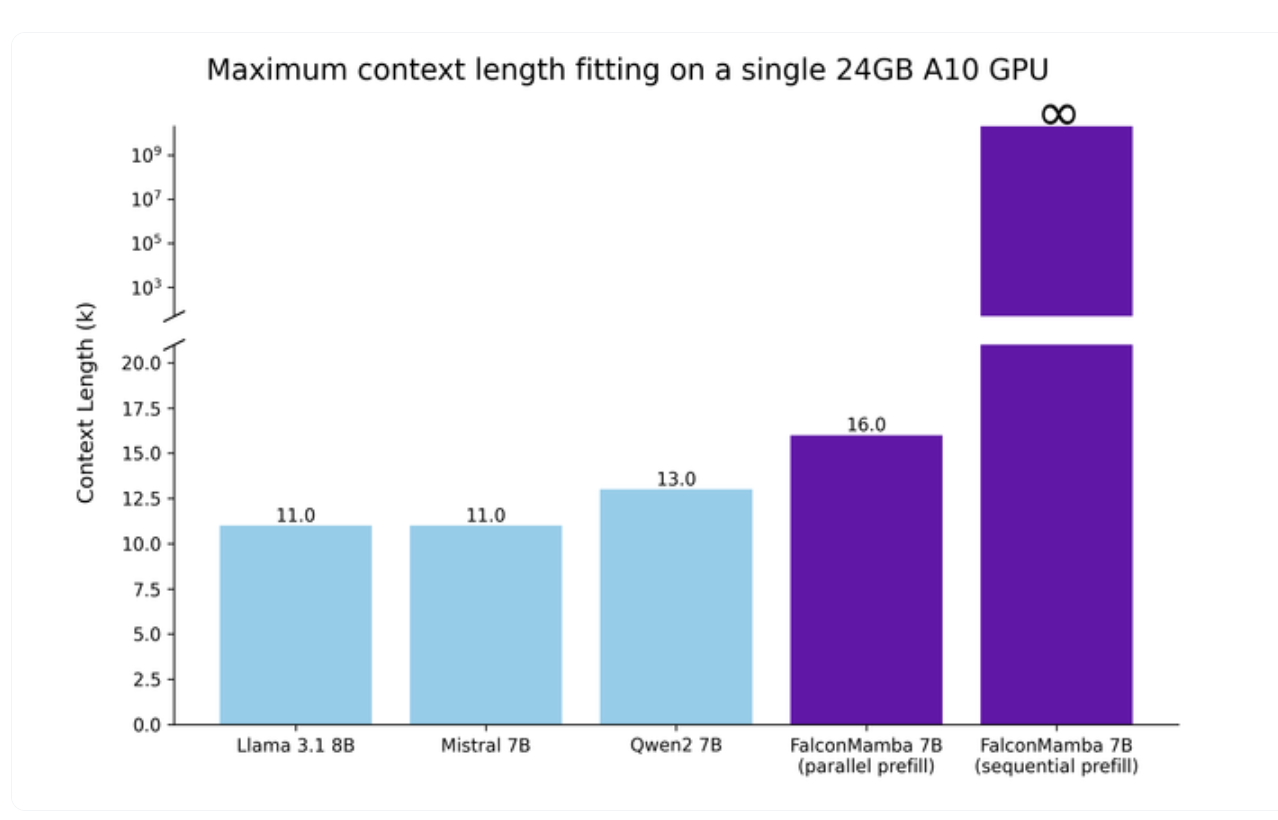

FalconMamba 7B se distingue por su arquitectura Mamba, propuesta originalmente en el artículo “Mamba: Linear-Time Sequence Modeling with Selective State Spaces”. Esta arquitectura se aparta de los modelos de transformadores tradicionales que dominan el panorama de la IA en la actualidad. Los transformadores, si bien son potentes, tienen una limitación fundamental en el procesamiento de secuencias grandes debido a su dependencia de mecanismos de atención, que aumentan los costos de computación y memoria con la longitud de la secuencia. FalconMamba 7B, sin embargo, supera estas limitaciones a través de su arquitectura, que incluye capas de normalización RMS adicionales para garantizar un entrenamiento estable a escala. Esto permite que el modelo procese secuencias de longitud arbitraria sin un aumento en el almacenamiento de memoria, lo que lo hace capaz de caber en una sola GPU A10 de 24 GB.

Una de las características más destacadas de FalconMamba 7B es su tiempo de generación de tokens constante, independientemente del tamaño del contexto. Esta es una gran ventaja con respecto a los modelos tradicionales, donde el tiempo de generación generalmente aumenta con la longitud del contexto debido a la necesidad de atender a todos los tokens anteriores en el contexto. La arquitectura Mamba aborda esto almacenando solo su estado recurrente, evitando así el escalamiento lineal de los requisitos de memoria y el tiempo de generación.

El entrenamiento de FalconMamba 7B implicó aproximadamente 5500GT, compuestos principalmente por datos de RefinedWeb, complementados con datos técnicos y de código de alta calidad de fuentes públicas. El modelo se entrenó utilizando una tasa de aprendizaje constante durante la mayor parte del proceso, seguida de una breve etapa de disminución de la tasa de aprendizaje. Durante esta etapa final se agregó una pequeña porción de datos seleccionados de alta calidad para mejorar aún más el rendimiento del modelo.

En términos de pruebas comparativas, FalconMamba 7B ha demostrado resultados impresionantes en varias evaluaciones. Por ejemplo, el modelo obtuvo una puntuación de 33,36 en la prueba comparativa MATH, mientras que en las pruebas comparativas MMLU-IFEval y BBH obtuvo una puntuación de 19,88 y 3,63, respectivamente. Estos resultados destacan el sólido rendimiento del modelo en comparación con otros modelos de última generación, en particular en tareas que requieren el procesamiento de secuencias largas.

La arquitectura de FalconMamba 7B también le permite incluir secuencias más grandes en una única GPU A10 de 24 GB en comparación con los modelos de transformador. Mantiene un rendimiento de generación constante sin ningún aumento en la memoria pico de CUDA. Esta eficiencia en el manejo de secuencias grandes convierte a FalconMamba 7B en una herramienta muy versátil para aplicaciones que requieren un procesamiento de datos extenso.

FalconMamba 7B es compatible con la biblioteca de transformadores Hugging Face (versión >4.45.0). Admite funciones como cuantificación de bits y bytes, lo que permite que el modelo se ejecute en limitaciones de memoria de GPU más pequeñas. Esto lo hace accesible para muchos usuarios, desde investigadores académicos hasta profesionales de la industria.

TII ha presentado una versión optimizada para instrucciones de FalconMamba, optimizada con 5 mil millones de tokens adicionales de datos de ajuste supervisados. Esta versión mejora la capacidad del modelo para realizar tareas de instrucción de forma más precisa y eficaz. Los usuarios también pueden beneficiarse de una inferencia más rápida utilizando Torch.Compile, lo que aumenta aún más la utilidad del modelo en aplicaciones del mundo real.

En conclusión, el lanzamiento de FalconMamba 7B por parte del Technology Innovation Institute, con su arquitectura innovadora, desempeño impresionante en puntos de referencia y accesibilidad a través del ecosistema Hugging Face, FalconMamba 7B, está preparado para tener un impacto sustancial en varios sectores.

Echa un vistazo a la Modelo y DetallesTodo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa..

No olvides unirte a nuestro Subreddit de más de 48 000 millones de usuarios

Encuentra lo próximo Seminarios web sobre IA aquí

Asif Razzaq es el director ejecutivo de Marktechpost Media Inc. Como ingeniero y emprendedor visionario, Asif está comprometido con aprovechar el potencial de la inteligencia artificial para el bien social. Su iniciativa más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, Marktechpost, que se destaca por su cobertura en profundidad de noticias sobre aprendizaje automático y aprendizaje profundo que es técnicamente sólida y fácilmente comprensible para una amplia audiencia. La plataforma cuenta con más de 2 millones de visitas mensuales, lo que ilustra su popularidad entre el público.