El diseño actual de modelos de lenguaje causal, como los GPT, está intrínsecamente cargado con el desafío de la coherencia semántica durante períodos más largos debido a su diseño de predicción de un token por delante. Esto ha permitido un desarrollo significativo de la IA generativa, pero a menudo conduce a una “derivación del tema” cuando se producen secuencias más largas, ya que cada token predicho depende únicamente de la presencia de meros tokens precedentes, no desde una perspectiva más amplia. Esto limita la utilidad práctica de estos modelos en aplicaciones complejas del mundo real con estricto cumplimiento de temas, como generación narrativa, creación de contenido y tareas de codificación. Superar este desafío al permitir la predicción de múltiples tokens mejoraría en gran medida la continuidad semántica, la precisión y la coherencia de las secuencias generadas de los modelos de lenguaje generativo actuales.

Ha habido varias formas de abordar la predicción de múltiples tokens, cada una con diferentes limitaciones. Los modelos que tienen como objetivo hacer predicciones para múltiples tokens dividiendo incrustaciones o teniendo múltiples encabezados de lenguaje requieren un uso intensivo de computación y, a menudo, no funcionan bien. Para los modelos Seq2Seq en conjuntos de codificador-decodificador, si bien esto permite la predicción de múltiples tokens, no logran capturar contextos pasados en una sola incrustación; por lo tanto, se producen muchas ineficiencias. Si bien BERT y otros modelos de lenguaje enmascarado pueden predecir múltiples tokens de una secuencia que están enmascarados, fallan en la generación de izquierda a derecha, lo que restringe su uso en la predicción de texto secuencial. ProphetNet, por otro lado, utiliza una estrategia de predicción de n-gramas; sin embargo, esto no es flexible para una amplia gama de tipos de datos. Los inconvenientes básicos de los métodos antes mencionados son problemas de escalabilidad, desperdicio computacional y, en general, resultados poco impresionantes al generar predicciones de alta calidad sobre problemas de contexto prolongado.

Los investigadores de EPFL presentan el modelo Future Token Prediction, que representa una nueva arquitectura para crear incrustaciones de tokens más amplias y conscientes del contexto. Esto permitirá predicciones fluidas de múltiples tokens donde, a diferencia de los modelos estándar, un codificador transformador utiliza la incrustación de las capas superiores para proporcionar “pseudosecuencias” cruzadas por un pequeño decodificador transformador para predicciones del siguiente token. De esta manera, el modelo aprovecha la capacidad de codificador-decodificador del FTP para retener información de contexto de tokens del historial anterior para realizar transiciones más fluidas y mantener la coherencia del tema entre predicciones de múltiples tokens. Con un contexto de secuencia más extendido codificado dentro de sus incrustaciones, FTP proporciona una mayor continuidad para las secuencias generadas y se ha convertido en uno de los mejores enfoques para la generación de contenido y otras aplicaciones que requieren coherencia semántica de formato largo.

El modelo FTP emplea una arquitectura GPT-2 modificada que se compone de un codificador de 12 capas con un decodificador de 3 capas. Su codificador genera incrustaciones de tokens que se proyectan linealmente a una dimensionalidad superior en una pseudosecuencia de 12 dimensiones que el decodificador realiza una atención cruzada para dar sentido al contexto de la secuencia. Comparte pesos integrados entre el codificador y el decodificador; está entrenado con datos de OpenWebText y utiliza el tokenizador GPT-2. Mientras tanto, AdamW realiza la optimización, con un tamaño de lote de 500 y una tasa de aprendizaje de 4e-4. En este modelo, el parámetro gamma está establecido en 0,8 para descontar progresivamente la atención prestada a los tokens en el futuro lejano, de modo que las predicciones inmediatas puedan seguir siendo muy precisas. De esta manera, el modelo FTP logra mantener la coherencia semántica sin una sobrecarga computacional sustancial y, por lo tanto, encuentra un equilibrio óptimo entre eficiencia y rendimiento.

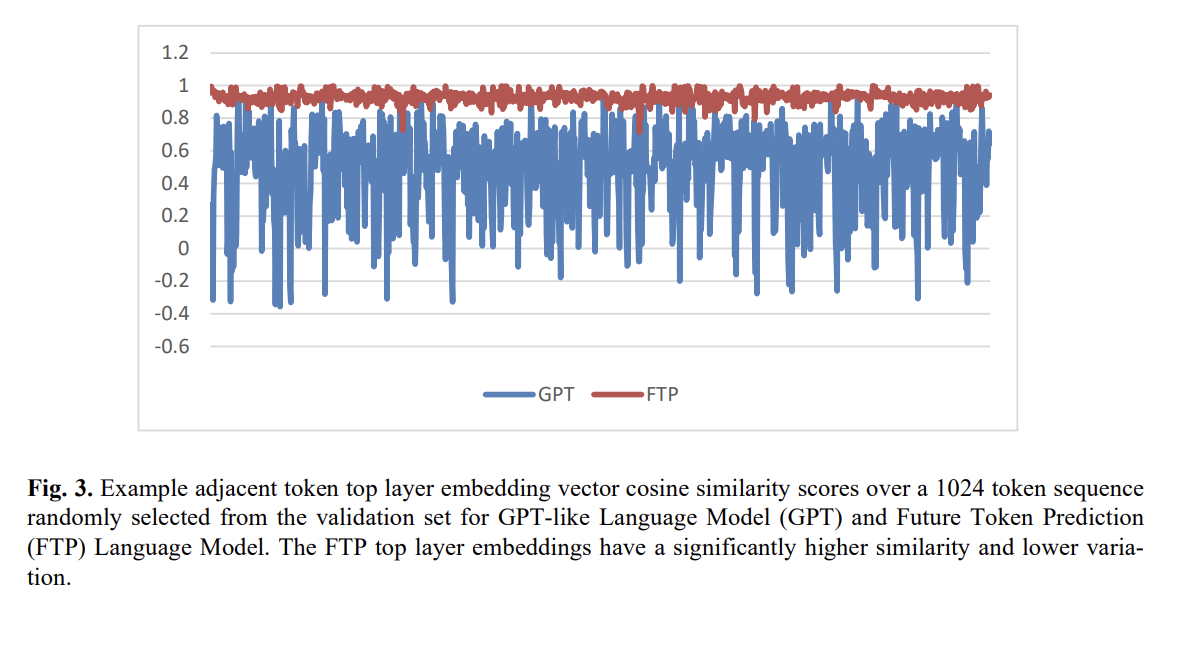

De hecho, estos resultados y evaluación muestran que el modelo aporta mejoras significativas en comparación con los GPT tradicionales en muchas métricas clave de rendimiento: reducciones significativas en la perplejidad, mejor precisión predictiva y mayor estabilidad para tareas de secuencia larga. También produce puntuaciones más altas de recuerdo, precisión y F1 en evaluaciones de calidad textual basadas en BERT, lo que implicaría aún más una mejor alineación semántica con las secuencias de texto reales. También supera a los modelos GPT en tareas de clasificación de texto como IMDB y reseñas de Amazon y siempre proporciona una mejor pérdida de validación con mayor precisión. Más importante aún, FTP sigue el tema del texto generado de manera más coherente, respaldado por puntuaciones más altas de similitud de cosenos en evaluaciones de secuencias largas, lo que establece aún más su destreza para la generación de contenido coherente y contextualmente relevante en aplicaciones más variadas.

El modelo FTP representa un cambio de paradigma en el modelado del lenguaje causal, uno que desarrolla las ineficiencias más críticas de los métodos clásicos de un solo token en una incorporación que admite vistas más amplias y sensibles al contexto para realizar predicciones de múltiples tokens. Al mejorar tanto la precisión de la predicción como la coherencia semántica, esta diferencia se ve subrayada por puntuaciones mejoradas en métricas basadas en perplejidad y BERT para una amplia gama de tareas. El mecanismo de atención cruzada de pseudosecuencia dentro de este modelo mejora la IA generativa al generar un flujo narrativo consistente, un requisito importante para un alto valor en el modelado de lenguaje temático coherente en aplicaciones que requieren integridad semántica.

Mira el Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de telegramas y LinkedIn Grarriba. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa.. No olvides unirte a nuestro SubReddit de más de 55.000 ml.

[Trending] LLMWare presenta Model Depot: una amplia colección de modelos de lenguaje pequeño (SLM) para PC Intel

Aswin AK es pasante de consultoría en MarkTechPost. Está cursando su doble titulación en el Instituto Indio de Tecnología de Kharagpur. Le apasiona la ciencia de datos y el aprendizaje automático, y aporta una sólida formación académica y experiencia práctica en la resolución de desafíos interdisciplinarios de la vida real.