En el campo en constante evolución de la lingüística computacional, la búsqueda de modelos que puedan generar sin problemas textos similares a los humanos ha llevado a los investigadores a explorar técnicas innovadoras más allá de los marcos tradicionales. Una de las vías más prometedoras en los últimos tiempos ha sido la exploración de modelos de difusión, anteriormente elogiados por su éxito en los dominios visual y auditivo y su potencial en la generación del lenguaje natural (NLG). Estos modelos han abierto nuevas posibilidades para crear texto que no sólo sea contextualmente relevante y coherente, sino que exhiba un grado notable de variabilidad y adaptabilidad a diferentes estilos y tonos, un obstáculo que muchos métodos anteriores lucharon por superar de manera eficiente.

Los métodos de generación de texto anteriores a menudo requerían trabajar en la producción de contenido que pudiera adaptarse a diversos requisitos sin una recapacitación extensa o intervenciones manuales. Este desafío fue particularmente pronunciado en aplicaciones que requerían una gran versatilidad, como la creación de contenido dinámico para sitios web o sistemas de diálogo personalizados, donde el contexto y el estilo podían cambiar rápidamente.

Los modelos de difusión han surgido como un rayo de esperanza en este panorama, celebrados por su capacidad para perfeccionar los resultados hacia soluciones de alta calidad de forma iterativa. Sin embargo, su aplicación en NLG aún no ha sido sencilla, principalmente debido a la naturaleza discreta del lenguaje. Esta discreción complica el proceso de difusión, que se basa en transformaciones graduales, lo que lo hace menos intuitivo para texto que imágenes o audio.

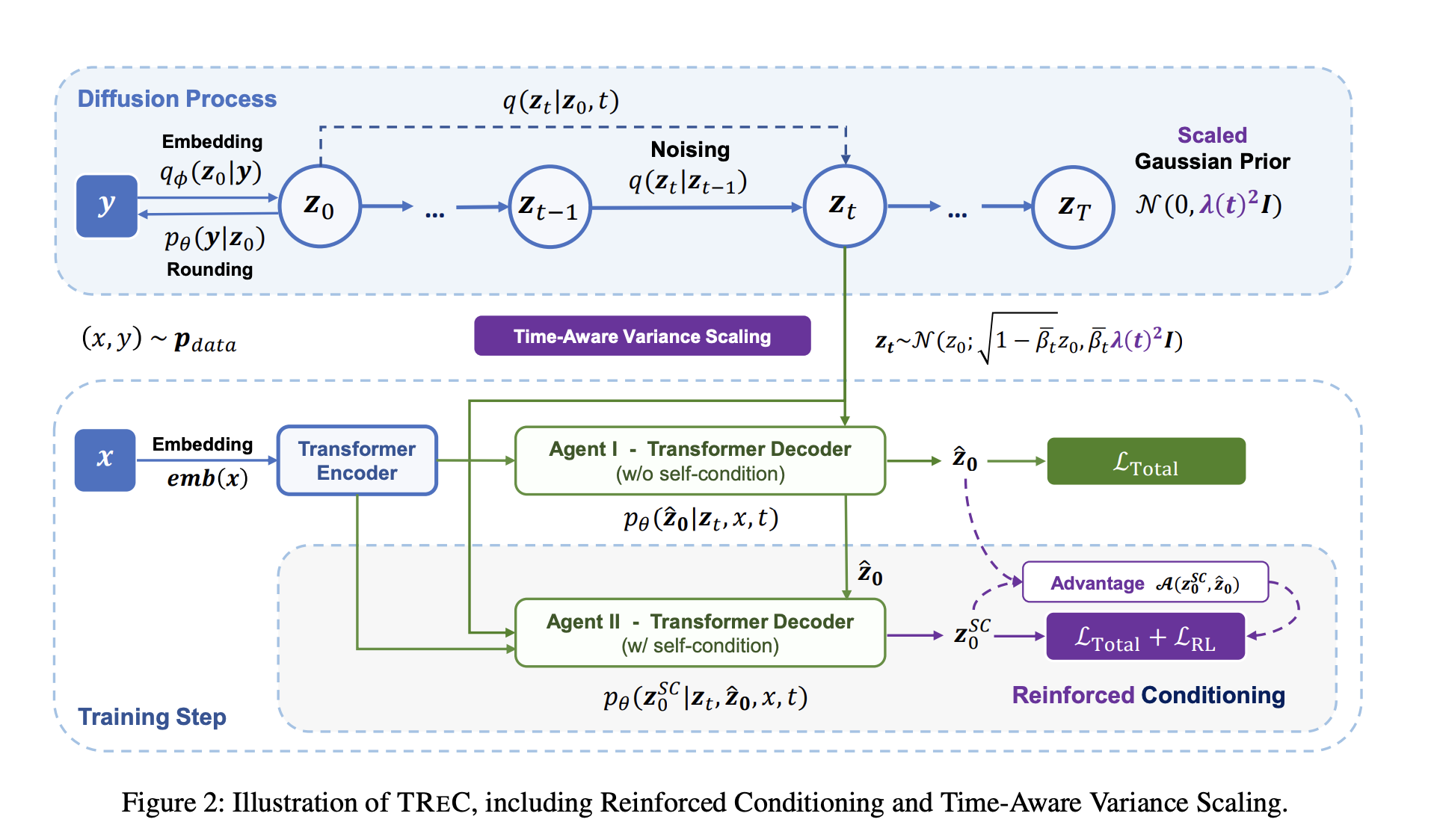

Presentaron investigadores de la Universidad de Pekín y Microsoft Corporation TRmiC (textensión Reforzado Concondicionamiento), un novedoso modelo de difusión de texto ideado para cerrar esta brecha. Se centra en los desafíos específicos que plantea la naturaleza discreta del texto, con el objetivo de aprovechar la destreza de refinamiento iterativo de los modelos de difusión para mejorar la generación de texto. TRmiC presenta el acondicionamiento reforzado, una estrategia diseñada para combatir la degradación del autocondicionamiento que se observa durante el entrenamiento. Esta degradación a menudo da como resultado modelos que no logran utilizar plenamente el potencial de refinamiento iterativo de la difusión, confiando demasiado en la calidad de los pasos iniciales y, por lo tanto, limitando la efectividad del modelo.

TRmiC emplea Time-Aware Variance Scaling, un enfoque innovador para alinear más estrechamente los procesos de capacitación y muestreo. Esta alineación es crucial para mantener la coherencia en la calidad de los resultados del modelo, asegurando que el proceso de refinamiento durante el muestreo refleje las condiciones bajo las cuales se entrenó el modelo. TRmiC Mejora significativamente la capacidad del modelo para producir secuencias de texto contextualmente relevantes y de alta calidad al abordar estos dos problemas críticos.

La eficacia de TRmiC ha sido probado rigurosamente en un espectro de tareas NLG, incluida la traducción automática, la paráfrasis y la generación de preguntas. Los resultados son nada menos que impresionantes, con TRmiC no sólo se mantiene firme frente a líneas de base autorregresivas y no autorregresivas, sino que también las supera en varios casos. Este desempeño subraya TRmiCLa capacidad de aprovechar todo el potencial de los procesos de difusión para la generación de texto, ofreciendo mejoras significativas en la calidad y relevancia contextual del texto generado.

que conjuntos TRmiC aparte está su novedosa metodología y los resultados tangibles que logra. En la traducción automática, TRmiC ha demostrado su superioridad al ofrecer traducciones más precisas y matizadas que las producidas por modelos establecidos. En las tareas de parafraseo y generación de preguntas, TRmiCLos resultados de son variados y contextualmente aptos, mostrando un nivel de adaptabilidad y coherencia que marca un avance significativo en NLG.

En conclusión, TRmiCEl desarrollo de s es un logro histórico en la búsqueda de modelos capaces de generar texto similar al humano. Al abordar los desafíos intrínsecos de los modelos de difusión de texto, a saber, la degradación durante el entrenamiento y la desalineación durante el muestreo, TRmiC establece un nuevo estándar para la generación de texto y abre nuevas vías para la investigación y aplicación en lingüística computacional. Su éxito en varias tareas de NLG ilustra la solidez y versatilidad del modelo, presagiando un futuro en el que las máquinas podrán generar texto que sea indistinguible del escrito por humanos, adaptado a una variedad de estilos, tonos y contextos. Este avance es un testimonio del ingenio y la visión de futuro de los investigadores detrás. TRmiCque ofrece una visión del futuro de la inteligencia artificial en la generación de lenguaje.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 38k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

También te puede gustar nuestro Cursos GRATUITOS de IA….

Nikhil es consultor interno en Marktechpost. Está cursando una doble titulación integrada en Materiales en el Instituto Indio de Tecnología de Kharagpur. Nikhil es un entusiasta de la IA/ML que siempre está investigando aplicaciones en campos como los biomateriales y la ciencia biomédica. Con una sólida formación en ciencia de materiales, está explorando nuevos avances y creando oportunidades para contribuir.