La resolución de problemas matemáticos ha sido durante mucho tiempo un punto de referencia para la inteligencia artificial (IA). Resolver problemas matemáticos con precisión requiere no sólo precisión computacional sino también un razonamiento profundo, un área en la que incluso los modelos de lenguaje avanzados (LLM) tradicionalmente han enfrentado desafíos. Muchos modelos existentes se basan en lo que los psicólogos denominan “pensamiento del Sistema 1”, que es rápido pero a menudo propenso a errores. Este enfoque genera soluciones en una única inferencia, evitando el proceso de razonamiento iterativo esencial para abordar problemas complejos. Además, el entrenamiento de modelos de alta calidad se basa en conjuntos de datos seleccionados, que son particularmente escasos para problemas matemáticos de nivel competitivo. Los métodos de código abierto frecuentemente no logran superar las capacidades de sus modelos “maestros”, lo que lleva a un progreso limitado. En consecuencia, el desarrollo de sistemas de IA eficientes capaces de abordar estos desafíos sigue siendo difícil de alcanzar.

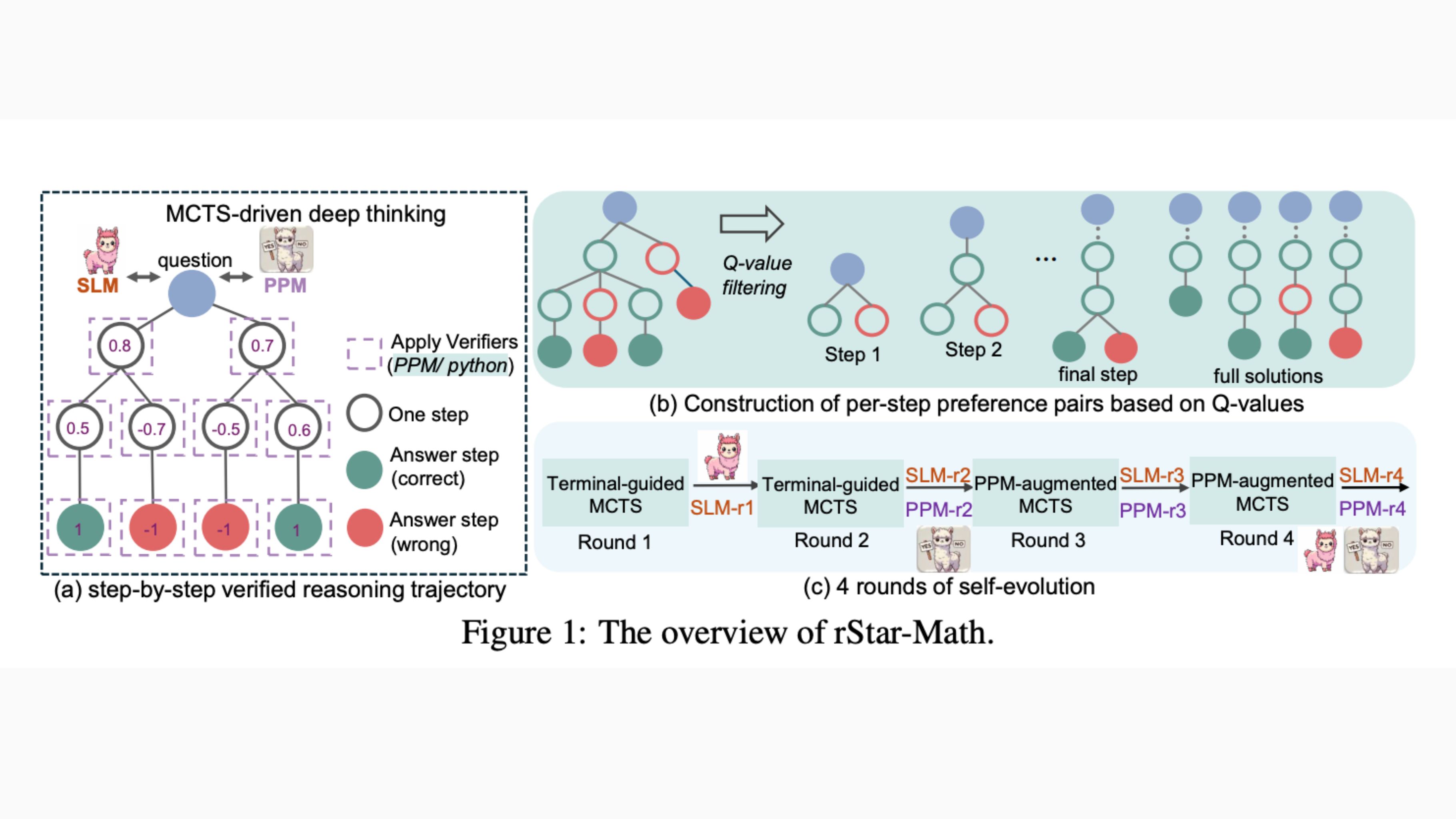

Microsoft presenta rStar-Matemáticasun marco de razonamiento estilo Sistema 2 autoevolutivo diseñado para mejorar la resolución de problemas matemáticos en modelos de lenguaje pequeño (SLM). Con un tamaño de modelo compacto de solo 7 mil millones de parámetros, rStar-Math demuestra un rendimiento que rivaliza y en ocasiones supera al modelo o1 de OpenAI en desafiantes puntos de referencia de competencia matemática. Este sistema aprovecha Monte Carlo Tree Search (MCTS) y estrategias de autoevolución para fortalecer las capacidades de razonamiento de los SLM.

A diferencia de los métodos tradicionales que dependen de la destilación de modelos más grandes, rStar-Math permite que modelos pequeños generen de forma independiente datos de entrenamiento de alta calidad mediante un proceso de razonamiento paso a paso. El marco emplea una síntesis de datos de cadena de pensamiento (CoT) aumentada por código, un modelo de preferencia de proceso (PPM) y técnicas iterativas de autoevolución. Estos avances permiten a rStar-Math lograr una precisión notable en todos los puntos de referencia, incluido el conjunto de datos MATH y la Olimpiada de Matemáticas de EE. UU. (AIME), donde se ubica entre el 20 % de los mejores estudiantes de secundaria.

Innovaciones técnicas y beneficios

El éxito de rStar-Math se basa en tres innovaciones principales:

- Síntesis de datos CoT aumentada con código:

- El sistema utiliza implementaciones de MCTS para generar trayectorias de razonamiento verificadas paso a paso. Este método garantiza que los pasos intermedios se validen mediante la ejecución de código Python, filtrando errores y mejorando la calidad general de los datos.

- Modelo de preferencia de procesos (PPM):

- A diferencia de los modelos de recompensa convencionales, PPM emplea clasificación por pares para optimizar los pasos de razonamiento. Este enfoque evita anotaciones ruidosas y ofrece retroalimentación detallada para la optimización a nivel de paso, lo que resulta en evaluaciones intermedias más confiables.

- Receta de autoevolución:

- A través de cuatro rondas iterativas de autoevolución, rStar-Math refina progresivamente su modelo de políticas y PPM. A partir de un conjunto de datos de 747.000 problemas matemáticos, el sistema genera millones de soluciones de alta calidad, abordando problemas cada vez más desafiantes y mejorando las capacidades de razonamiento con cada iteración.

Estas innovaciones hacen de rStar-Math una herramienta sólida para desafíos matemáticos tanto académicos como competitivos. Además, al permitir que modelos más pequeños generen datos por sí mismos, se reduce la dependencia de modelos grandes que consumen muchos recursos, ampliando el acceso a capacidades avanzadas de IA.

Resultados y conocimientos

rStar-Math ha redefinido los puntos de referencia para modelos pequeños en razonamiento matemático. En el conjunto de datos MATH, logra una precisión del 90,0 %, una mejora significativa con respecto a la precisión anterior del 58,8 % de Qwen2.5-Math-7B. De manera similar, su rendimiento en Phi3-mini-3.8B mejora del 41,4% al 86,4%, lo que representa un avance notable con respecto al modelo de vista previa o1 de OpenAI.

En la competencia AIME, rStar-Math resuelve el 53,3% de los problemas, ubicándose entre el 20% de los mejores participantes de la escuela secundaria. Más allá de las competiciones, el sistema sobresale en puntos de referencia como matemáticas de nivel olímpico, problemas de nivel universitario y el examen Gaokao, superando modelos de código abierto aún más grandes. Estos resultados resaltan su capacidad para generalizar a través de diversos desafíos matemáticos.

Los hallazgos clave del estudio incluyen:

- El razonamiento paso a paso mejora la confiabilidad: Las trayectorias de razonamiento verificadas reducen los errores en los pasos intermedios, lo que mejora el rendimiento general del modelo.

- Surgimiento de la autorreflexión: rStar-Math exhibe la capacidad de autocorregir caminos de razonamiento defectuosos durante la resolución de problemas.

- Importancia de los modelos de recompensa: Las evaluaciones de nivel de paso del PPM desempeñan un papel fundamental para lograr una alta precisión, enfatizando el valor de las señales de retroalimentación densa en el razonamiento del Sistema 2.

Conclusión

rStar-Math de Microsoft destaca el potencial de los modelos de lenguaje pequeños para abordar tareas complejas de razonamiento matemático. Al combinar síntesis aumentada de código, modelado de recompensa innovador y autoevolución iterativa, el marco logra una precisión y confiabilidad notables. Con una precisión del 90,0 % en el conjunto de datos MATH y un sólido rendimiento en competiciones AIME, rStar-Math demuestra que modelos más pequeños y eficientes pueden lograr resultados competitivos.

Este avance no sólo amplía los límites de las capacidades de la IA, sino que también hace que los modelos de razonamiento sofisticados sean más accesibles. A medida que rStar-Math evolucione, sus aplicaciones potenciales podrían expandirse más allá de las matemáticas hacia áreas como la investigación científica y el desarrollo de software, allanando el camino para sistemas de IA versátiles y eficientes para abordar los desafíos del mundo real.

Verificar el Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de telegramas y LinkedIn Grarriba. No olvides unirte a nuestro SubReddit de más de 60.000 ml.

🚨 PRÓXIMO SEMINARIO WEB GRATUITO SOBRE IA (15 DE ENERO DE 2025): Aumente la precisión del LLM con datos sintéticos e inteligencia de evaluación–Únase a este seminario web para obtener información práctica para mejorar el rendimiento y la precisión del modelo LLM y, al mismo tiempo, proteger la privacidad de los datos..

Asif Razzaq es el director ejecutivo de Marktechpost Media Inc.. Como empresario e ingeniero visionario, Asif está comprometido a aprovechar el potencial de la inteligencia artificial para el bien social. Su esfuerzo más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, Marktechpost, que se destaca por su cobertura en profundidad del aprendizaje automático y las noticias sobre aprendizaje profundo que es técnicamente sólida y fácilmente comprensible para una amplia audiencia. La plataforma cuenta con más de 2 millones de visitas mensuales, lo que ilustra su popularidad entre el público.