La IA multimodal permite que las máquinas procesen y razonen en varios formatos de entrada, como imágenes, texto, videos y documentos complejos. Este dominio ha visto un mayor interés como los modelos de lenguaje tradicionales, aunque potentes, son inadecuados cuando se enfrentan a los datos visuales o cuando la interpretación contextual abarca en múltiples tipos de entrada. El mundo real es inherentemente multimodal, por lo que los sistemas tienen como objetivo ayudar en las tareas en tiempo real, analizar las interfaces de los usuarios, comprender los materiales académicos o la interpretación de escenas complejas requieren inteligencia que funcione más allá del razonamiento textual. Ahora se están desarrollando modelos más nuevos para decodificar simultáneamente las señales de lenguaje y visión para abordar las tareas con una conciencia contextual mejorada, profundidad de razonamiento y adaptabilidad a diferentes formularios de entrada de datos.

Una limitación en los sistemas multimodales de hoy radica en su incapacidad para procesar contextos largos de manera eficiente y generalizar a través de estructuras de entrada de alta resolución o diversas sin comprometer el rendimiento. Muchos modelos de código abierto limitan la entrada a unos pocos miles de tokens o exigen recursos computacionales excesivos para mantener el rendimiento a escala. Estas restricciones dan como resultado modelos que pueden funcionar bien en puntos de referencia estándar pero que luchan con aplicaciones del mundo real que involucran entradas complejas, de imágenes múltiples, diálogos extendidos o tareas académicas como el análisis de documentos basados en OCR y la resolución matemática de problemas. También hay una brecha en la capacidad de razonamiento, particularmente el pensamiento de horario largo, que evita que los sistemas actuales manejen tareas que requieren una lógica paso a paso o una alineación contextual profunda entre diferentes modalidades de datos.

Las herramientas anteriores han intentado abordar estos desafíos, pero a menudo se quedaron cortos en escalabilidad o flexibilidad. Los modelos Qwen2.5-VL y Gemma-3, aunque notables por sus densas arquitecturas, carecen de soporte incorporado para el razonamiento a través de cadenas de pensamiento más largas. Modelos como Deepseek-VL2 y ARIA adoptaron estrategias de mezcla de expertos (MOE), pero tenían codificadores de visión fijos que restringían su capacidad para adaptarse a diversas resoluciones y formas de entrada visual. Además, estos modelos generalmente admitían solo ventanas de contexto cortas, tokens 4K en Deepseek-VL2, y tuvieron un éxito limitado en OCR complejos o escenarios de imágenes múltiples. Como tal, la mayoría de los sistemas existentes no lograron equilibrar el bajo consumo de recursos con la capacidad de abordar tareas que involucran un contexto largo y diversos datos visuales.

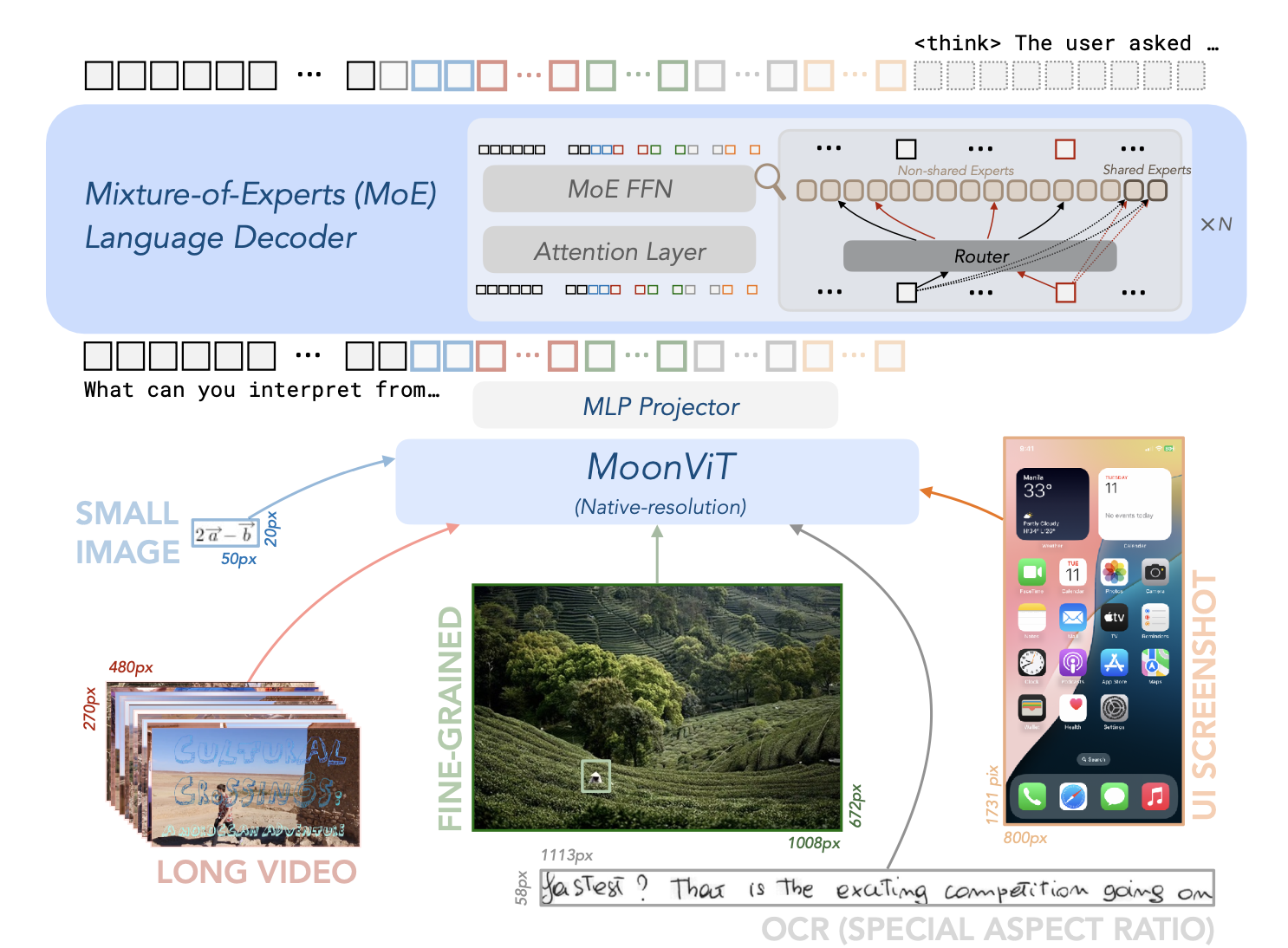

Investigadores de Moonshot Ai introdujeron Kimi-vlun nuevo modelo en idioma de visión que utiliza una arquitectura MOE. Este sistema activa solo 2,8 mil millones de parámetros en su decodificador, significativamente más ligero que muchos competidores al tiempo que mantiene potentes capacidades multimodales. Los dos modelos lanzados basados en esta arquitectura en la cara abrazada son Kimi-vl-a3b-pensamiento y Kimi-Vl-A3B-Instructo. Incorpora un codificador visual de resolución nativa llamado MoonVit y admite ventanas de contexto de hasta 128k tokens. El modelo tiene tres componentes integrados: el codificador Moonvit, un proyector MLP para transiciones de características visuales a los incrustaciones del lenguaje y el decodificador Moe Moe. Los investigadores desarrollaron además una versión avanzada, el pensamiento KIMI-VL, diseñada específicamente para tareas de razonamiento de horizonte largo a través de un aprendizaje de refuerzo y ajuste supervisado de cadena de pensamiento. Juntos, estos modelos apuntan a redefinir los puntos de referencia de eficiencia en el razonamiento del idioma de la visión.

La innovación arquitectónica en Kimi-VL radica en su capacidad de adaptabilidad y procesamiento. Moonvit procesa imágenes de alta resolución en su forma original, eliminando la necesidad de fragmentación de subimagen. Para garantizar la consistencia espacial a través de resoluciones de imagen variadas, el modelo utiliza incrustaciones posicionales absolutas interpoladas combinadas con incrustaciones posicionales rotativas bidimensionales a través de la altura y el ancho. Estas opciones de diseño permiten que MoonVit preserve los detalles de grano fino incluso en las entradas de imágenes a gran escala. Las salidas del codificador de visión se pasan a través de un MLP de dos capas que utiliza operaciones de píxeles de shuffle a dimensiones espaciales de muestra y se convierte en incrustaciones compatibles con LLM. En el lado del lenguaje, el decodificador MOE de parámetros activados 2.8B admite parámetros totales 16B e integra perfectamente con representaciones visuales, lo que permite un entrenamiento e inferencia altamente eficientes en diferentes tipos de entrada. Todo el proceso de entrenamiento utilizó un optimizador de muones mejorado con descomposición de peso y optimización de memoria basada en cero-1 para manejar el gran recuento de parámetros.

La composición de datos de capacitación refleja un enfoque en diversos aprendizaje multimodal. Comenzando con tokens 2.0T para el entrenamiento de VIT usando pares de aplicación de imágenes, el equipo agregó otros 0.1T para alinear el codificador con el decodificador. El pre-entrenamiento conjunto consumió tokens 1.4T, seguido de 0.6T en el enfriamiento y 0.3T en la activación de contexto largo, totalizando tokens de 4.4t. Estas etapas incluyeron conjuntos de datos visuales académicos, muestras de OCR, datos de video largos y pares de control de calidad matemáticos y de código sintéticos. Para el aprendizaje de contexto a largo plazo, el modelo fue entrenado progresivamente para manejar secuencias de 8k a 128k tokens, utilizando incrustaciones de cuerda extendidas de una frecuencia base de 50,000 a 800,000. Esto permitió que el modelo mantuviera una precisión de retiro de token de 100% hasta 64k tokens, con una ligera caída a 87.0% a 128k, aún superan a la mayoría de las alternativas.

Kimi-VL demostró fuertes resultados en una variedad de puntos de referencia. En el Longvideobench, anotó 64.5; En Mmlongbench-Doc, logró 35.1; y en el punto de referencia de Infovqa, lideró con 83.2. En ScreensPot-Pro, que prueba la comprensión de las pantallas de la interfaz de usuario, obtuvo 34.5. La variante de pensamiento Kimi-VL se destacó en puntos de referencia intensivos en razonamiento como MMMU (61.7), MathVision (36.8) y Mathvista (71.3). Para tareas de agentes como OsWorld, el modelo coincidió o excedió el rendimiento de modelos más grandes como GPT-4O mientras se activa significativamente menos parámetros. Su diseño compacto y sus fuertes capacidades de razonamiento lo convierten en un candidato líder entre las soluciones multimodales de código abierto.

Algunas conclusiones clave de la investigación sobre Kimi-VL:

- KIMI-VL activa solo los parámetros 2.8B durante la inferencia, asegurando la eficiencia sin sacrificar la capacidad.

- Moonvit, su codificador de visión, procesa de forma nativa las imágenes de alta resolución, mejorando la claridad en tareas como OCR y la interpretación de la UI.

- El modelo admite hasta 128k tokens de contexto, logrando el 100% de recuperación hasta 64k y 87.0% de precisión a 128k en tareas de texto/video.

- Kimi-VL-Pensar puntajes 61.7 en MMMU, 36.8 en MathVision y 71.3 en Mathvista, superando a muchos VLM más grandes.

- Obtuvo 83.2 en InfoVQA y 34.5 en tareas visuales en ScreensPot-Pro, mostrando su precisión en las evaluaciones basadas en la percepción.

- El pre-entrenamiento total incluyó tokens 4.4T a través de datos de texto, video, documento y datos multimodales sintéticos.

- La optimización se realizó utilizando un optimizador de muones personalizado con estrategias de consumo de memoria como Zero-1.

- La capacitación conjunta aseguró una integración de características visuales y de lenguaje perfectas al tiempo que preservaba las capacidades del lenguaje central.

Verificar Modo de instruccionestierra Modelo de razonamiento. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, siéntete libre de seguirnos Gorjeo Y no olvides unirte a nuestro 85k+ ml de subreddit.

Sana Hassan, una pasante de consultoría en MarktechPost y estudiante de doble grado en IIT Madras, le apasiona aplicar tecnología e IA para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una nueva perspectiva a la intersección de la IA y las soluciones de la vida real.