El ámbito de los asistentes virtuales enfrenta un desafío fundamental: cómo hacer que las interacciones con estos asistentes sean más naturales e intuitivas. Anteriormente, dichos intercambios requerían una frase desencadenante específica o presionar un botón para iniciar un comando, lo que puede interrumpir el flujo de la conversación y la experiencia del usuario. El problema central reside en la capacidad del asistente para discernir cuándo se le habla en medio de diversos ruidos de fondo y conversaciones. Este problema se extiende al reconocimiento eficiente del habla dirigida al dispositivo (donde el usuario intenta comunicarse con el dispositivo) en contraposición a una dirección “no dirigida”, que no está diseñada para el dispositivo.

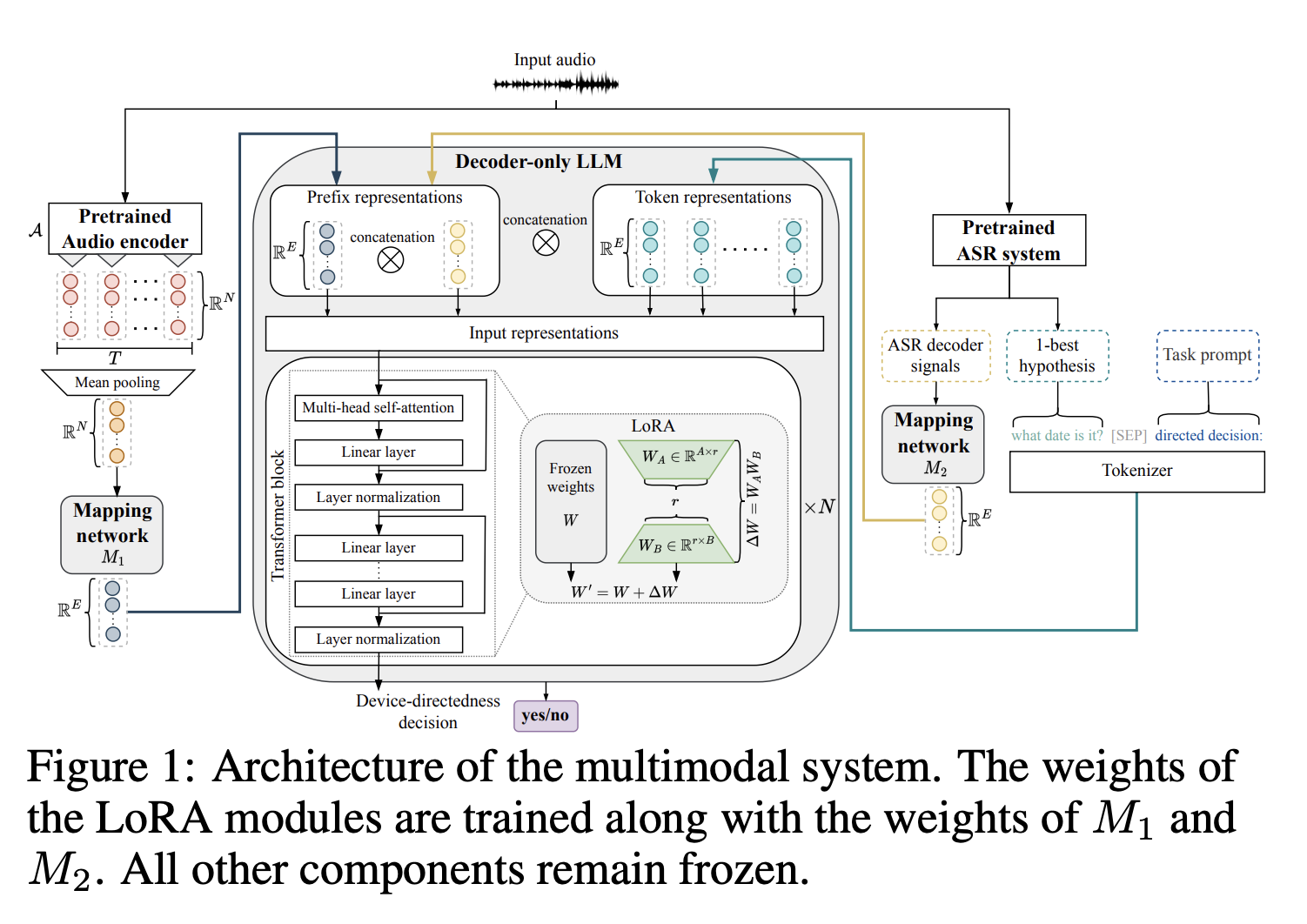

Como se indicó, los métodos existentes para las interacciones con asistentes virtuales generalmente requieren una frase desencadenante o presionar un botón antes de un comando. Este enfoque, si bien funcional, interrumpe el flujo natural de la conversación. Por el contrario, el equipo de investigación de TH Nürnberg, Apple, propone un método para superar esta limitación. Su solución implica un modelo multimodal que aprovecha los LLM y combina señales de decodificador con información lingüística y de audio. Este enfoque diferencia eficientemente el audio dirigido y no dirigido sin depender de una frase desencadenante.

La esencia de esta solución propuesta es facilitar una interacción más fluida entre los usuarios y los asistentes virtuales. El modelo está diseñado para interpretar los comandos del usuario de forma más intuitiva mediante la integración de técnicas avanzadas de detección de voz. Este avance representa un salto significativo en el campo de la interacción persona-computadora, con el objetivo de crear una experiencia más natural y fácil de usar utilizando asistentes virtuales.

El sistema propuesto utiliza características acústicas de un codificador de audio previamente entrenado, combinado con las mejores hipótesis y señales de decodificador de un sistema automático de reconocimiento de voz. Estos elementos sirven como características de entrada para un modelo de lenguaje grande. El modelo está diseñado para ser eficiente en datos y recursos, requiere datos de entrenamiento mínimos y es adecuado para dispositivos con recursos limitados. Funciona de forma eficaz incluso con un único LLM congelado, lo que demuestra su adaptabilidad y eficiencia en diversos entornos de dispositivos.

En términos de rendimiento, los investigadores demuestran que este enfoque multimodal logra tasas de error iguales más bajas en comparación con las líneas de base unimodales y al mismo tiempo utiliza significativamente menos datos de entrenamiento. Descubrieron que las representaciones de audio especializadas de baja dimensión conducen a un mejor rendimiento que las representaciones de audio generales de alta dimensión. Estos hallazgos subrayan la eficacia del modelo para detectar con precisión la intención del usuario de una manera eficiente en el uso de recursos.

La investigación presenta un avance significativo en la tecnología de asistentes virtuales al introducir un modelo multimodal que discierne la intención del usuario sin la necesidad de frases desencadenantes. Este enfoque mejora la naturalidad de la interacción entre humanos y dispositivos y demuestra eficiencia en términos de uso de datos y recursos. La implementación exitosa de este modelo podría revolucionar la forma en que interactuamos con los asistentes virtuales, haciendo que la experiencia sea más intuitiva y fluida.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de 34k+ ML, 41k+ comunidad de Facebook, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Muhammad Athar Ganaie, pasante de consultoría en MarktechPost, es un defensor del aprendizaje profundo eficiente, con especial atención en la capacitación dispersa. Cursando un M.Sc. en Ingeniería Eléctrica, con especialización en Ingeniería de Software, combina conocimientos técnicos avanzados con aplicaciones prácticas. Su esfuerzo actual es su tesis sobre “Mejora de la eficiencia en el aprendizaje por refuerzo profundo”, que muestra su compromiso de mejorar las capacidades de la IA. El trabajo de Athar se encuentra en la intersección “Capacitación escasa en DNN” y “Aprendizaje por refuerzo profundo”.