Un avance innovador en el ámbito de la Inteligencia Artificial es la ampliación de Transformers. Ha hecho posibles importantes avances en una serie de aplicaciones, incluidos los modelos de chat y la producción de imágenes. Aunque los modelos de transformadores han ganado mucha popularidad y atención por parte de las masas y la comunidad de IA, no todos los intentos de entrenar transformadores enormes tienen éxito. Los investigadores han descubierto continuamente inestabilidades que podrían obstruir o interrumpir el proceso de aprendizaje.

A medida que los recursos informáticos necesarios para una formación exhaustiva de Transformer siguen aumentando, es fundamental comprender cómo y por qué la formación de Transformer puede salir mal. Los equipos suelen experimentar inestabilidades en el entrenamiento cuando trabajan en el entrenamiento de grandes modelos basados en Transformer, especialmente cuando trabajan a gran escala, lo que no sucede cuando se usan las mismas configuraciones de entrenamiento para modelos más pequeños.

En un estudio reciente, un equipo de investigadores de Google DeepMind ha desarrollado técnicas para simular y examinar la estabilidad e inestabilidad del entrenamiento en modelos de menor escala. El estudio se centra inicialmente en dos causas bien establecidas de inestabilidad en el entrenamiento que han sido identificadas en otras investigaciones. El primero es el crecimiento de los logits en las capas de atención, y el segundo es la divergencia de los logits de producción respecto de las probabilidades logarítmicas.

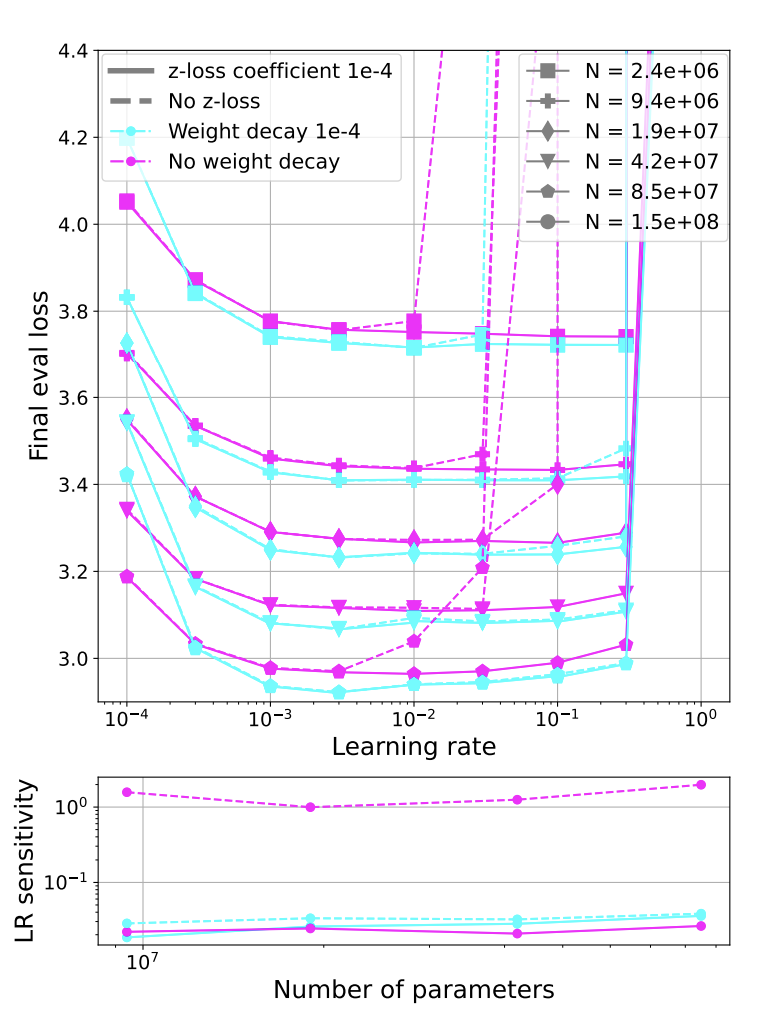

Al examinar la relación entre la tasa de aprendizaje y la pérdida durante el entrenamiento a diferentes escalas, los investigadores han descubierto que estas inestabilidades también se manifiestan en modelos más pequeños, especialmente cuando se utilizan altas tasas de aprendizaje. También han descubierto que los métodos utilizados anteriormente para reducir estas inestabilidades en modelos a gran escala funcionan igual de bien en modelos más pequeños con problemas similares.

Esto lleva a los investigadores a investigar cómo otros métodos e intervenciones ampliamente utilizados, que se utilizan con frecuencia para mejorar los modelos y el entrenamiento, afectan la sensibilidad de la pérdida final a las variaciones en la tasa de aprendizaje, analizando técnicas como el calentamiento, µParam y la disminución del peso. Los investigadores pueden entrenar modelos más pequeños con pérdidas constantes utilizando una combinación de estas estrategias, incluso cuando las tasas de aprendizaje varían en múltiples órdenes de magnitud.

La investigación del equipo llegó a su fin con dos situaciones en las que pudo identificar inestabilidades antes de que se convirtieran en un problema. Lo han hecho examinando cómo las normas de gradiente y los patrones de activación del modelo cambian a medida que el modelo escala. Esta función predictiva ofrece información valiosa para monitorear y resolver posibles problemas de capacitación antes.

En conclusión, este estudio investiga el fenómeno en tamaños más pequeños para abordar el problema de la inestabilidad del entrenamiento en modelos grandes basados en Transformer. Los investigadores querían profundizar en el conocimiento de las variables que afectan a la estabilidad del entrenamiento. Para ello, investigan las inestabilidades conocidas y los efectos de diferentes estrategias de optimización. También investigan técnicas predictivas basadas en el comportamiento del modelo, que pueden ayudar a evitar problemas de inestabilidad en primer lugar.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de más de 30.000 ml, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Tanya Malhotra es estudiante de último año de la Universidad de Estudios de Petróleo y Energía, Dehradun, y cursa BTech en Ingeniería Informática con especialización en Inteligencia Artificial y Aprendizaje Automático.

Es una entusiasta de la Ciencia de Datos con buen pensamiento analítico y crítico, junto con un ardiente interés en adquirir nuevas habilidades, liderar grupos y gestionar el trabajo de manera organizada.