El conocido chatbot basado en inteligencia artificial (IA), es decir, ChatGPT, que se ha construido sobre la arquitectura transformadora de GPT, utiliza la técnica de aprendizaje reforzado a partir de la retroalimentación humana (RLHF). RLHF es un método cada vez más importante para utilizar el potencial de los modelos de lenguaje grande (LLM) previamente entrenados para generar respuestas más útiles y veraces que estén en línea con las preferencias humanas.

En RLHF, se entrena un modelo de lenguaje para producir respuestas que maximicen la recompensa aprendida a través del aprendizaje por refuerzo, después de lo cual se entrena un modelo de recompensa basado en las preferencias humanas por indicaciones particulares. Dado que recopilar calificaciones humanas suele ser menos complicado que recopilar demostraciones para realizar ajustes supervisados, este enfoque agiliza el proceso de recopilación de datos.

Sin embargo, la piratería de recompensas es un problema sutil con RLHF, donde la política obtiene una gran recompensa sin cumplir los objetivos reales. Esto sucede como resultado de la generalización limitada fuera de distribución (OOD) del modelo de recompensa y de las posibles imperfecciones en la representación de las preferencias humanas. Al ser un LLM sólido, el modelo de lenguaje puede proporcionar ejemplos OOD para aprovechar las fallas del modelo de recompensa.

El escenario se complica aún más por los datos sobre preferencias humanas, que con frecuencia son sesgados e inconsistentes debido a la complejidad y subjetividad de las tareas, defectos en los estándares de calificación y el bajo calibre de los evaluadores. La verbosidad es un ejemplo popular de piratería de recompensas, en el que los modelos producen más tokens para que las respuestas parezcan más completas o mejor formateadas, pero no hay una mejora real en la calidad.

Para abordar estos problemas, una investigación reciente de NVIDIA y la Universidad de Maryland tuvo como objetivo mitigar la piratería de recompensas examinando cómo los algoritmos de RL y los modelos de incentivos afectan la verbosidad y el rendimiento. El equipo ha presentado una técnica de evaluación para comparar varias configuraciones de capacitación y tener en cuenta los sesgos en las evaluaciones basadas en modelos. La técnica ha proporcionado un conocimiento integral de varias duraciones de respuesta al evaluar el desempeño en el frente de Pareto de la puntuación de evaluación versus la duración.

Este proceso tiene como objetivo analizar el equilibrio entre la puntuación de la evaluación del LLM y la duración de la respuesta, permitiendo una comparación sistemática de diferentes entornos de formación. Al variar los hiperparámetros de entrenamiento, se puede evaluar cómo estas modificaciones afectan la relación entre la verbosidad y la calidad de la respuesta.

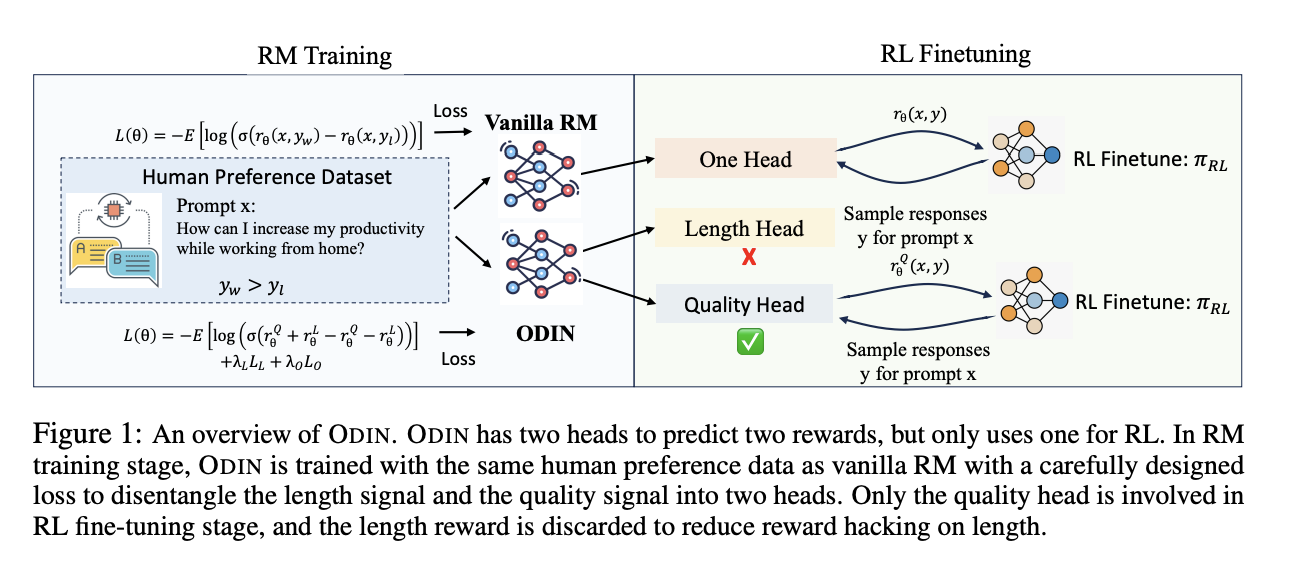

El estudio analiza los hiperparámetros y técnicas de RL, como el recorte de recompensas y la penalización de longitud, para disminuir la piratería de recompensas en función de la longitud. El objetivo principal es eliminar la señal de longitud falsa de la recompensa, aunque varios procedimientos de ajuste pueden producir mejores resultados. Para lograr esto, el equipo ha sugerido un modelo de recompensa de dos cabezas que separa la longitud de las representaciones de las preferencias verdaderas. La longitud del cabezal se elimina durante RL.

Se ha utilizado la técnica sugerida para desenredar la recompensa, ODIN, con cuya ayuda, incluso con un presupuesto de ajuste más costoso, la política pudo alcanzar un frente de Pareto mayor que los resultados anteriores. La optimización de políticas proximales (PPO) y ReMax se benefician de la eficacia de ODIN, lo que indica que se puede utilizar para mejorar otros métodos de ajuste de RL y reducir la duración de la piratería.

En conclusión, los resultados experimentales de este método han mostrado una notable disminución en la asociación del modelo de recompensa con la duración de la respuesta. La estrategia derivada funciona significativamente mejor cuando se prioriza la calidad de la información sobre la verbosidad. Este método reduce con éxito el problema de la piratería de recompensas relacionada con la duración de la respuesta, mejorando la confiabilidad y utilidad de los LLM capacitados utilizando el paradigma RLHF.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 37k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Tanya Malhotra es estudiante de último año de la Universidad de Estudios de Petróleo y Energía, Dehradun, y cursa BTech en Ingeniería en Ciencias de la Computación con especialización en Inteligencia Artificial y Aprendizaje Automático.

Es una entusiasta de la Ciencia de Datos con buen pensamiento analítico y crítico, junto con un ardiente interés en adquirir nuevas habilidades, liderar grupos y gestionar el trabajo de manera organizada.