El procesamiento del lenguaje natural (PNL) busca permitir que las computadoras comprendan e interactúen utilizando el lenguaje humano. Un desafío crítico en PNL es la evaluación de modelos de lenguaje (LM), que generan respuestas en diversas tareas. La diversidad de estas tareas dificulta evaluar eficazmente la calidad de las respuestas. Con la creciente sofisticación de los LM, como el GPT-4, los modelos propietarios a menudo brindan sólidas capacidades de evaluación, pero adolecen de problemas de transparencia, control y costos. Esto requiere el desarrollo de alternativas confiables de código abierto que puedan juzgar eficazmente los resultados del lenguaje sin comprometer estos aspectos.

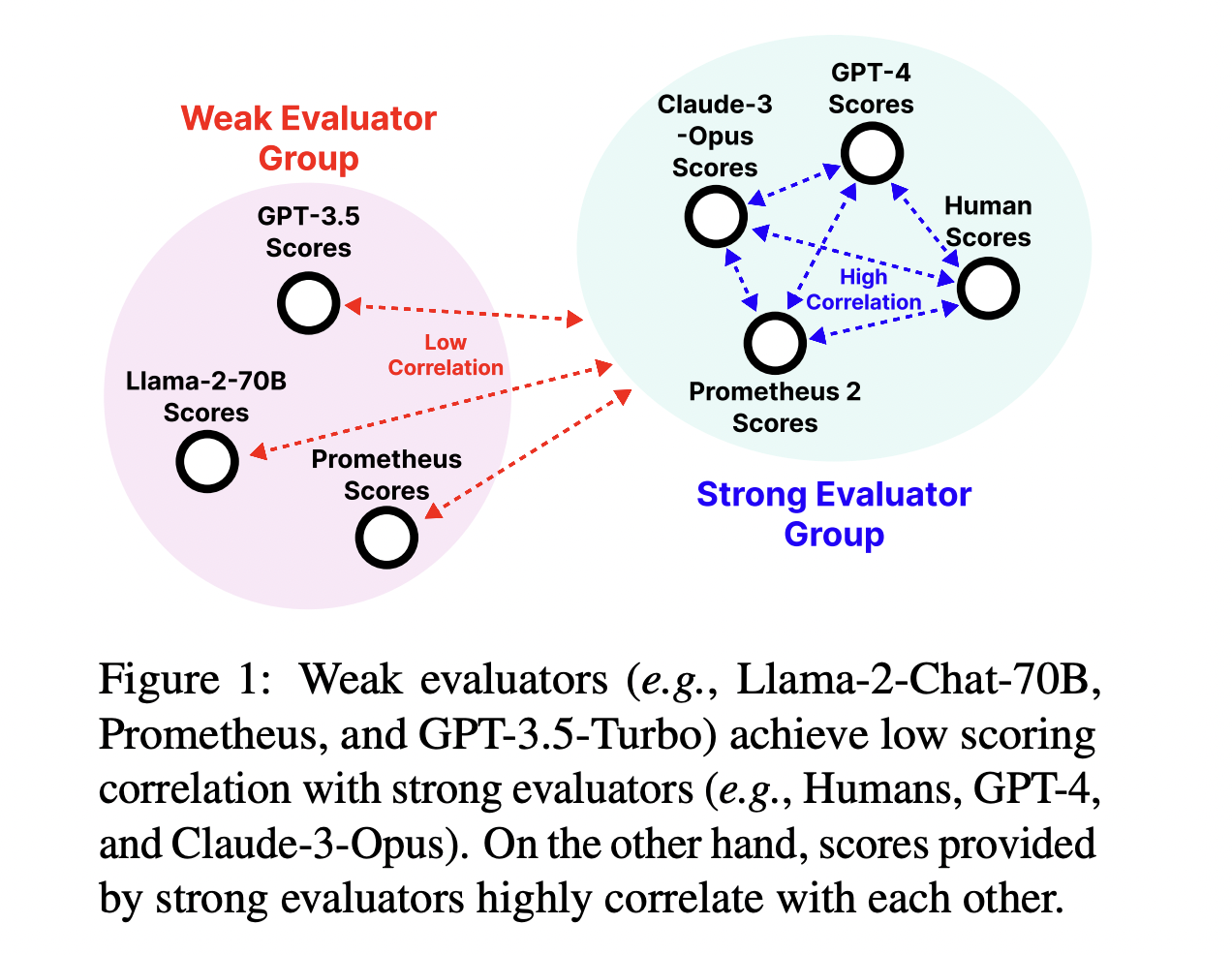

El problema es multifacético e involucra la evaluación de las respuestas y la escalabilidad de los mecanismos de evaluación. Las herramientas de evaluación existentes, en particular los modelos de código abierto, tienen varias limitaciones. Muchos modelos no proporcionan funcionalidades de evaluación directa y clasificación por pares, las dos formas de evaluación más frecuentes. Esto limita su adaptabilidad a diversos escenarios de la vida real. Priorizan atributos generales como la utilidad y la inocuidad, al tiempo que emiten puntuaciones que difieren significativamente de las evaluaciones humanas. Esta inconsistencia conduce a evaluaciones poco confiables y requiere mejores modelos de evaluación que reflejen fielmente los juicios humanos.

Los equipos de investigación han intentado abordar estas brechas mediante varios métodos. Sin embargo, la mayoría de los enfoques carecen de una flexibilidad integral y no logran simular con precisión las evaluaciones humanas. Los modelos propietarios actuales, como GPT-4, siguen siendo caros y poco transparentes, lo que impide un uso generalizado de la evaluación. El equipo de investigación de KAIST AI, LG AI Research, la Universidad Carnegie Mellon, el MIT, el Instituto Allen de IA y la Universidad de Illinois en Chicago presentó Prometeo 2, un novedoso evaluador de código abierto diseñado para evaluar modelos de lenguaje para resolverlo. Este modelo fue desarrollado para proporcionar evaluaciones transparentes, escalables y controlables, al mismo tiempo que iguala la calidad de evaluación de los modelos propietarios.

Prometheus 2 se desarrolló fusionando dos LM evaluadores: uno entrenado exclusivamente para la evaluación directa y otro para la clasificación por pares. La fusión de estos modelos creó un evaluador unificado que sobresale en ambos formatos de evaluación. Los investigadores utilizaron el conjunto de datos de Colección de Preferencias recientemente desarrollado, que presenta 1000 criterios de evaluación, para refinar aún más las capacidades del modelo. Al combinar eficazmente los dos formatos de entrenamiento, Prometheus 2 puede evaluar las respuestas de LM utilizando métodos de evaluación directa y clasificación por pares. El modelo fusionado aprovecha un enfoque de fusión lineal para combinar las fortalezas de ambos formatos de evaluación, logrando un alto rendimiento en todas las tareas de evaluación.

El modelo demostró la correlación más alta con evaluadores humanos y propietarios en pruebas de evaluación comparativa en cuatro puntos de referencia de evaluación directa: Vicuna Bench, MT Bench, FLASK y Feedback Bench. Las correlaciones de Pearson superaron 0,5 en todos los puntos de referencia, alcanzando 0,878 y 0,898 en el Feedback Bench para los modelos 7B y 8x7B, respectivamente. En cuatro puntos de referencia de clasificación por pares, incluidos HHH Alignment, MT Bench Human Judgment, Auto-J Eval y Preference Bench, Prometheus 2 superó a los modelos de código abierto existentes y logró puntuaciones de precisión que superaron el 85 %. El Preference Bench, un conjunto de pruebas en el dominio para Prometheus 2, indicó la robustez y versatilidad del modelo.

Prometheus 2 redujo la brecha de rendimiento con evaluadores propietarios, como GPT-4, en varios puntos de referencia. El modelo redujo a la mitad la diferencia de correlación entre humanos y GPT-4 en el punto de referencia FLASK y logró una precisión del 84 % en las evaluaciones de alineación HHH. Esto resalta el importante potencial de los evaluadores de código abierto para reemplazar costosas soluciones patentadas y al mismo tiempo garantizar evaluaciones integrales y precisas.

En conclusión, la falta de evaluadores de modelos de lenguaje transparentes, escalables y adaptables que reflejen fielmente el juicio humano es un desafío importante en la PNL. Para abordar este problema, los investigadores desarrollaron Prometheus 2, un novedoso evaluador de código abierto. Utilizaron un enfoque de fusión lineal, combinando dos modelos entrenados por separado en evaluación directa y clasificación por pares. Este modelo unificado superó los modelos anteriores de código abierto en las pruebas comparativas, mostrando una alta precisión y correlación, al tiempo que cerró sustancialmente la brecha de rendimiento con los modelos propietarios. Prometheus 2 representa un avance significativo en la evaluación de código abierto y ofrece una alternativa sólida a las soluciones patentadas.

Revisar la Papel y Github. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de 41k+ ML

Asif Razzaq es el director ejecutivo de Marktechpost Media Inc.. Como emprendedor e ingeniero visionario, Asif está comprometido a aprovechar el potencial de la inteligencia artificial para el bien social. Su esfuerzo más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, Marktechpost, que se destaca por su cobertura en profundidad del aprendizaje automático y las noticias sobre aprendizaje profundo que es técnicamente sólida y fácilmente comprensible para una amplia audiencia. La plataforma cuenta con más de 2 millones de visitas mensuales, lo que ilustra su popularidad entre el público.