El aprendizaje de refuerzo RL se ha convertido en un método posterior a la capacitación ampliamente utilizado para LLM, mejorando las capacidades como la alineación humana, el razonamiento a largo plazo y la adaptabilidad. Sin embargo, un desafío importante es generar señales de recompensa precisas en dominios amplios y menos estructurados, ya que los modelos actuales de recompensa de alta calidad se basan en gran medida en sistemas basados en reglas o tareas verificables como matemáticas y codificación. En las aplicaciones generales, los criterios de recompensa son más diversos y subjetivos, carecen de claras verdades terrestres. Para abordar esto, se están explorando los modelos de recompensa generalista (RMS) para una aplicabilidad más amplia. Sin embargo, estos modelos deben equilibrar la flexibilidad de entrada y la escalabilidad durante la inferencia, particularmente en la producción de recompensas confiables y de alta calidad en tareas y dominios variados.

Los enfoques de modelado de recompensas existentes incluyen técnicas escalares, semi-escalares y generativas, cada una con flexibilidad e compensaciones de rendimiento de tiempo de inferencia. Por ejemplo, los modelos por pares se limitan a comparaciones relativas, mientras que los modelos escalares luchan por producir diversos comentarios. Los modelos de recompensa generativo (GRMS) ofrecen resultados más ricos y flexibles, lo que los hace más adecuados para evaluar varias respuestas. El trabajo reciente ha explorado la capacitación de GRM a través de RL fuera de línea, integrando herramientas y conocimientos externos para mejorar la calidad de la recompensa. Sin embargo, pocos métodos abordan directamente cómo los RM pueden escalar de manera eficiente durante la inferencia. Esto ha llevado a una investigación sobre métodos como la escala basada en el muestreo, la incrustación de la cadena de pensamiento y la agregación guiada por recompensas, con el objetivo de modelos de políticas a escala y modelos de recompensa durante la inferencia. Estos desarrollos son prometedores para sistemas de recompensa de propósito general más robustos en LLM.

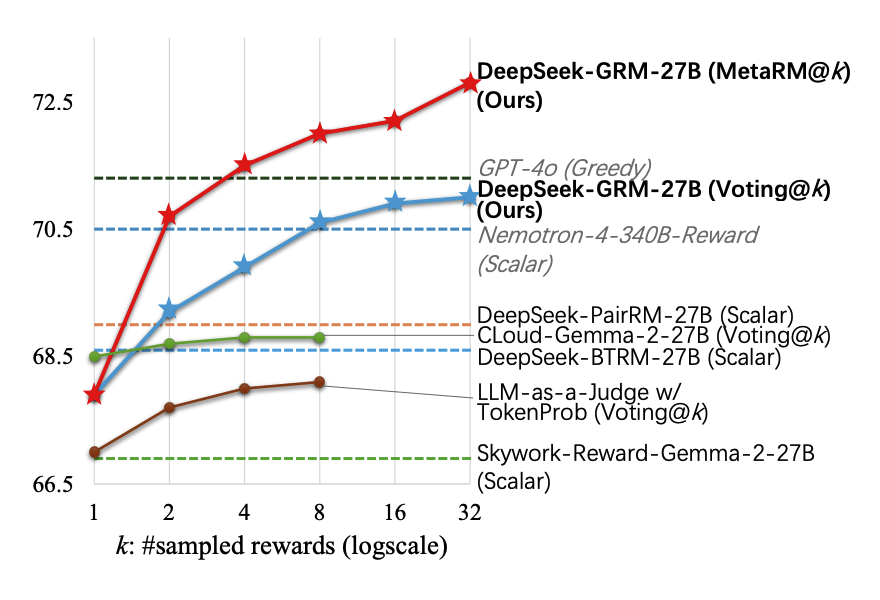

Los investigadores de Deepseek-AI y Tsinghua de la Universidad exploran la mejora de los modelos de recompensa RM para consultas generales al mejorar la escalabilidad de la inferencia utilizando una mayor informática y mejores técnicas de aprendizaje. Emplean a Pointwise GRM para el manejo de insumos flexible y proponen un método de aprendizaje, un ajuste de crítica (SPCT) con presumidos, lo que ayuda a los GRM a generar principios adaptativos y críticas precisas durante el aprendizaje de refuerzo en línea. Aplican un muestreo paralelo e introducen un meta rm para escalar de manera efectiva y refinar el proceso de votación. Sus modelos Deepseek-GRM superan a los métodos de referencia existentes, que ofrecen una mayor calidad y escalabilidad de recompensas, con planes para la obtención abierta a pesar de los desafíos en algunas tareas complejas.

Los investigadores introducen SPCT, un método diseñado para mejorar los GRM de puntos al permitirles generar principios adaptativos y críticas precisas. SPCT consta de dos etapas: rechazar el ajuste fino para inicializar el principio y la generación de crítica y la RL basada en reglas para el refinamiento. En lugar de tratar los principios como preprocesamiento, se generan dinámicamente durante la inferencia. Esto promueve la escalabilidad al mejorar la granularidad de la recompensa. Además, el rendimiento de tiempo de inferencia se impulsa mediante muestreo y votación paralelo, respaldado por un modelo de meta recompensa (Meta RM) que filtra los resultados de baja calidad. En general, SPCT mejora la precisión de la recompensa, la robustez y la escalabilidad en los GRM.

Utilizando métricas estándar, el estudio evalúa varios métodos RM a través de puntos de referencia como banca de recompensa, PPE, RMB y RealMestake. Deepseek-Grm-27b supera constantemente las líneas de base y rivaliza con los modelos públicos fuertes como GPT-4O. La escala de tiempo de inferencia, especialmente con los modelos de votación y meta recompensa, aumenta significativamente el rendimiento, lo que alcanza los resultados comparables a los modelos mucho más grandes. Los estudios de ablación destacan la importancia de componentes como la generación de principios y el muestreo no intento. La escala en el tiempo de entrenamiento muestra rendimientos decrecientes en comparación con las estrategias de tiempo de inferencia. En general, Deepseek-GRM, mejorado con SPCT y Meta RM, ofrece modelado de recompensas robusto y escalable con sesgo de dominio reducido y una fuerte generalización.

En conclusión, el estudio presenta SPCT, un método que mejora la escalabilidad de tiempo de inferencia para los GRM a través del aprendizaje de refuerzo en línea basado en reglas. SPCT permite la generación de principios adaptativos y críticos, mejorando la calidad de la recompensa en diversas tareas. Los modelos Deepseek-GRM superan a varias líneas de base y modelos públicos fuertes, especialmente cuando se combinan con un modelo de meta recompensa para la escala de tiempo de inferencia. Utilizando un muestreo paralelo y un manejo de entrada flexible, estos GRM logran un rendimiento fuerte sin depender de tamaños de modelo más grandes. El trabajo futuro incluye la integración de los GRM en tuberías RL, la escala conjunta con modelos de políticas y servir como evaluadores fuera de línea confiables.

Verificar el Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, siéntete libre de seguirnos Gorjeo Y no olvides unirte a nuestro 85k+ ml de subreddit.

Sana Hassan, una pasante de consultoría en MarktechPost y estudiante de doble grado en IIT Madras, le apasiona aplicar tecnología e IA para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una nueva perspectiva a la intersección de la IA y las soluciones de la vida real.