¿Cómo se puede aprovechar la eficacia de los transformadores de visión en el aprendizaje generativo basado en la difusión? Este artículo de NVIDIA presenta un modelo novedoso llamado Diffusion Vision Transformers (DiffiT), que combina una arquitectura jerárquica híbrida con un codificador y decodificador en forma de U. Este enfoque ha impulsado el estado del arte en modelos generativos y ofrece una solución al desafío de generar imágenes realistas.

Mientras que los modelos anteriores como DiT y MDT emplean transformadores en modelos de difusión, DiffiT se distingue por utilizar autoatención dependiente del tiempo en lugar de cambios y escalas para el acondicionamiento. Los modelos de difusión, conocidos por sus redes de puntuación condicionadas por ruido, ofrecen ventajas en optimización, cobertura de espacio latente, estabilidad de entrenamiento e invertibilidad, lo que los hace atractivos para diversas aplicaciones como la generación de texto a imagen, el procesamiento del lenguaje natural y la generación de nubes de puntos 3D. .

Los modelos de difusión han mejorado el aprendizaje generativo, permitiendo la generación de escenas diversas y de alta fidelidad a través de un proceso iterativo de eliminación de ruido. DiffiT introduce módulos de autoatención dependientes del tiempo para mejorar el mecanismo de atención en varias etapas de eliminación de ruido. Esta innovación da como resultado un rendimiento de última generación en conjuntos de datos para tareas de generación de imágenes y espacio latente.

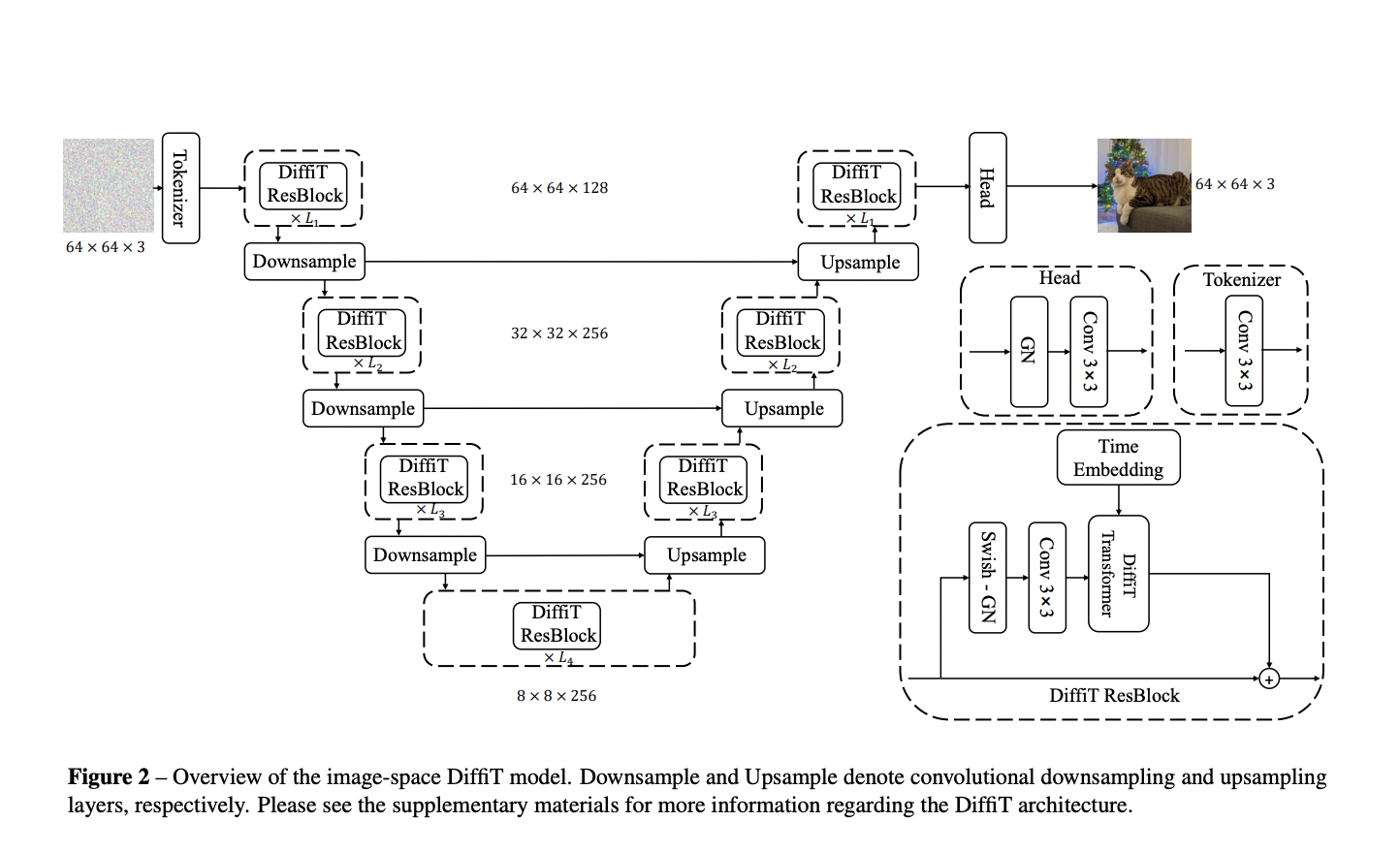

DiffiT presenta una arquitectura jerárquica híbrida con un codificador y decodificador en forma de U. Incorpora un módulo exclusivo de autoatención dependiente del tiempo para adaptar el comportamiento de atención durante varias etapas de eliminación de ruido. Basado en ViT, el codificador utiliza pasos de resolución múltiple con capas convolucionales para reducir la resolución. Al mismo tiempo, el decodificador emplea una arquitectura simétrica tipo U con una configuración multiresolución similar y capas convolucionales para muestreo ascendente. El estudio incluye la investigación de escalas de guía sin clasificador para mejorar la calidad de las muestras generadas y probar diferentes escalas en experimentos ImageNet-256 e ImageNet-512.

DiffiT se ha propuesto como un nuevo enfoque para generar imágenes de alta calidad. Este modelo ha sido probado en varias tareas de síntesis incondicional y condicional de clase y superó a los modelos anteriores en calidad de muestra y expresividad. DiffiT ha logrado un nuevo récord en la puntuación de distancia de inicio de Fréchet (FID), con un impresionante 1,73 en el conjunto de datos ImageNet-256, lo que indica su capacidad para generar imágenes de alta resolución con una fidelidad excepcional. El bloque transformador DiffiT es un componente crucial de este modelo y contribuye a su éxito en la simulación de muestras del modelo de difusión mediante ecuaciones diferenciales estocásticas.

En conclusión, DiffiT es un modelo excepcional para generar imágenes de alta calidad, como lo demuestran sus resultados de última generación y su capa única de autoatención dependiente del tiempo. Con una nueva puntuación FID de 1,73 en el conjunto de datos ImageNet-256, DiffiT produce imágenes de alta resolución con una fidelidad excepcional, gracias a su bloque transformador DiffiT, que permite la simulación de muestras del modelo de difusión utilizando ecuaciones diferenciales estocásticas. La calidad superior de la muestra y la expresividad del modelo en comparación con los modelos anteriores se demuestran a través de experimentos de imágenes y espacio latente.

Las direcciones de investigación futuras para DiffiT incluyen la exploración de arquitecturas de red de eliminación de ruido alternativas más allá de las U-Nets residuales convolucionales tradicionales para mejorar la efectividad y las posibles mejoras. La investigación de métodos alternativos para introducir la dependencia del tiempo en el bloque Transformer tiene como objetivo mejorar el modelado de la información temporal durante el proceso de eliminación de ruido. Se propone experimentar con diferentes escalas de orientación y estrategias para generar muestras diversas y de alta calidad para mejorar el rendimiento de DiffiT en términos de puntuación FID. Las investigaciones en curso evaluarán la generalización y la aplicabilidad potencial de DiffiT a una gama más amplia de problemas de aprendizaje generativo en diversos dominios y tareas.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de 33k+ ML, 41k+ comunidad de Facebook, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

A Sana Hassan, pasante de consultoría en Marktechpost y estudiante de doble titulación en IIT Madras, le apasiona aplicar la tecnología y la inteligencia artificial para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una nueva perspectiva a la intersección de la IA y las soluciones de la vida real.