Optimizar su rendimiento mientras se gestionan los recursos computacionales es un desafío crucial en una era de modelos de lenguaje cada vez más poderosos. Investigadores de la Universidad de Texas en Austin y la Universidad de Washington exploraron una estrategia innovadora que comprime los documentos recuperados en resúmenes textuales concisos. Al emplear compresores tanto extractivos como abstractivos, su enfoque mejora con éxito la eficiencia de los modelos lingüísticos.

Las mejoras de eficiencia en los modelos de lenguaje aumentado de recuperación (RALM) son un punto focal, centrándose en mejorar los componentes de recuperación a través de técnicas como la compresión del almacén de datos y la reducción de dimensionalidad. Las estrategias para reducir la frecuencia de recuperación incluyen la recuperación selectiva y la utilización de pasos más largos. Su artículo “RECOMP” aporta un enfoque novedoso al comprimir los documentos recuperados en resúmenes textuales sucintos. Su enfoque no sólo reduce los costos computacionales sino que también mejora el rendimiento del modelo de lenguaje.

Al abordar las limitaciones de los RALM, su estudio presenta RECOMP (Recuperar, Comprimir, Anteponer), un enfoque novedoso para mejorar su eficiencia. RECOMP implica comprimir los documentos recuperados en resúmenes textuales antes del aumento en contexto. Su proceso utiliza tanto un compresor extractivo para seleccionar oraciones pertinentes de los documentos como un compresor abstractivo para sintetizar información en un resumen conciso.

Su método introduce dos compresores especializados, un compresor extractivo y otro abstractivo, diseñados para mejorar el rendimiento de los modelos de lenguaje (LM) en tareas finales mediante la creación de resúmenes concisos a partir de documentos recuperados. El compresor extractivo selecciona oraciones pertinentes, mientras que el compresor abstractivo sintetiza datos de múltiples documentos. Ambos compresores están capacitados para optimizar el rendimiento del LM cuando sus resúmenes generados se agregan a la entrada del LM. La evaluación incluye modelado del lenguaje y tareas de respuesta a preguntas de dominio abierto, y se demuestra la transferibilidad entre varios LM.

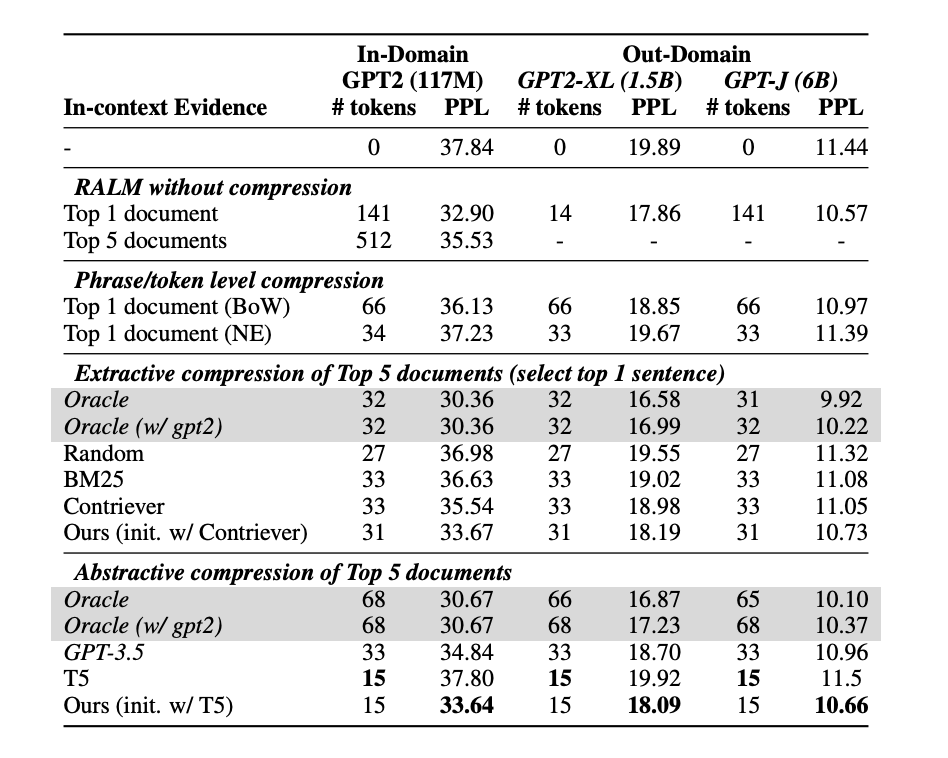

Su enfoque se evalúa en modelado de lenguaje y tareas de respuesta a preguntas de dominio abierto, logrando una notable tasa de compresión del 6 % con una pérdida mínima de rendimiento, superando los modelos de resumen estándar. El compresor extractivo sobresale en los modelos de lenguaje, mientras que el compresor abstractivo funciona mejor con la menor perplejidad. En la respuesta a preguntas de dominio abierto, todos los métodos de aumento de recuperación mejoran el rendimiento. Oracle extractivo lidera y el DPR tiene un buen desempeño entre las líneas de base extractivas. Los compresores entrenados se transfieren entre modelos de lenguaje en tareas de modelado de lenguaje.

RECOMP se introduce para comprimir documentos recuperados en resúmenes textuales, mejorando el rendimiento de LM. Se emplean dos compresores, extractivo y abstractivo. Los compresores son eficaces en el modelado de lenguajes y en tareas de respuesta a preguntas de dominio abierto. En conclusión, comprimir los documentos recuperados en resúmenes textuales mejora el rendimiento de LM al tiempo que reduce los costos computacionales.

Direcciones de investigación futuras, incluido el aumento adaptativo con el resumidor extractivo, mejorar el rendimiento del compresor en diferentes modelos y tareas de lenguaje, explorar diferentes tasas de compresión, considerar modelos de compresión basados en redes neuronales, experimentar con una gama más amplia de funciones y conjuntos de datos, evaluar la generalización a otros dominios e idiomas, e integrar otros métodos de recuperación como incrustaciones de documentos o expansión de consultas para mejorar los modelos de lenguaje de recuperación aumentada.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de 31k+ ML, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

También estamos en WhatsApp. Únase a nuestro canal de IA en Whatsapp.

Hola, mi nombre es Adnan Hassan. Soy pasante de consultoría en Marktechpost y pronto seré aprendiz de gestión en American Express. Actualmente estoy cursando una doble titulación en el Instituto Indio de Tecnología, Kharagpur. Me apasiona la tecnología y quiero crear nuevos productos que marquen la diferencia.