La generación aumentada por recuperación (RAG), una técnica que mejora la eficiencia de los modelos de lenguaje de gran tamaño (LLM) en el manejo de grandes cantidades de texto, es fundamental en el procesamiento del lenguaje natural, en particular en aplicaciones como la de preguntas y respuestas, donde mantener el contexto de la información es crucial para generar respuestas precisas. A medida que evolucionan los modelos de lenguaje, los investigadores se esfuerzan por superar los límites mejorando la forma en que estos modelos procesan y recuperan información relevante de datos textuales a gran escala.

Uno de los principales problemas de los LLM actuales es la dificultad para gestionar contextos largos. A medida que aumenta la longitud del contexto, los modelos necesitan ayuda para mantener un enfoque claro en la información relevante, lo que puede provocar una caída significativa de la calidad de sus respuestas. Este problema es particularmente pronunciado en las tareas de respuesta a preguntas, donde la precisión es primordial. Los modelos tienden a verse abrumados por el gran volumen de información, lo que puede hacer que recuperen datos irrelevantes, lo que diluye la precisión de las respuestas.

En desarrollos recientes, los LLM como GPT-4 y Gemini han sido diseñados para manejar secuencias de texto mucho más largas, y algunos modelos admiten hasta un millón de tokens en contexto. Sin embargo, estos avances conllevan su propio conjunto de desafíos. Si bien los LLM de contexto largo pueden, en teoría, manejar entradas más grandes, a menudo introducen fragmentos de información innecesarios o irrelevantes en el proceso, lo que da como resultado una tasa de precisión menor. Por lo tanto, los investigadores aún buscan mejores soluciones para gestionar eficazmente contextos largos, manteniendo la calidad de las respuestas y utilizando de manera eficiente los recursos computacionales.

Los investigadores de NVIDIA, con sede en Santa Clara, California, propusieron un enfoque de recuperación con conservación del orden y generación aumentada (OP-RAG) para abordar estos desafíos. OP-RAG ofrece una mejora sustancial con respecto a los métodos RAG tradicionales al preservar el orden de los fragmentos de texto recuperados para su procesamiento. A diferencia de los sistemas RAG existentes, que priorizan los fragmentos en función de las puntuaciones de relevancia, el mecanismo OP-RAG conserva la secuencia original del texto, lo que garantiza que se mantenga el contexto y la coherencia durante todo el proceso de recuperación. Este avance permite una recuperación más estructurada de la información relevante, evitando los problemas de los sistemas RAG tradicionales que pueden recuperar datos muy relevantes pero fuera de contexto.

El método OP-RAG introduce un mecanismo innovador que reestructura el modo en que se procesa la información. En primer lugar, el texto a gran escala se divide en fragmentos secuenciales más pequeños. A continuación, estos fragmentos se evalúan en función de su relevancia para la consulta. En lugar de clasificarlos únicamente por relevancia, OP-RAG garantiza que los fragmentos se mantengan en su orden original, tal como aparecían en el documento de origen. Esta conservación secuencial ayuda al modelo a centrarse en recuperar los datos más relevantes desde el punto de vista contextual sin introducir distracciones irrelevantes. Los investigadores demostraron que este enfoque mejora significativamente la calidad de la generación de respuestas, en particular en escenarios de contexto extenso, donde mantener la coherencia es esencial.

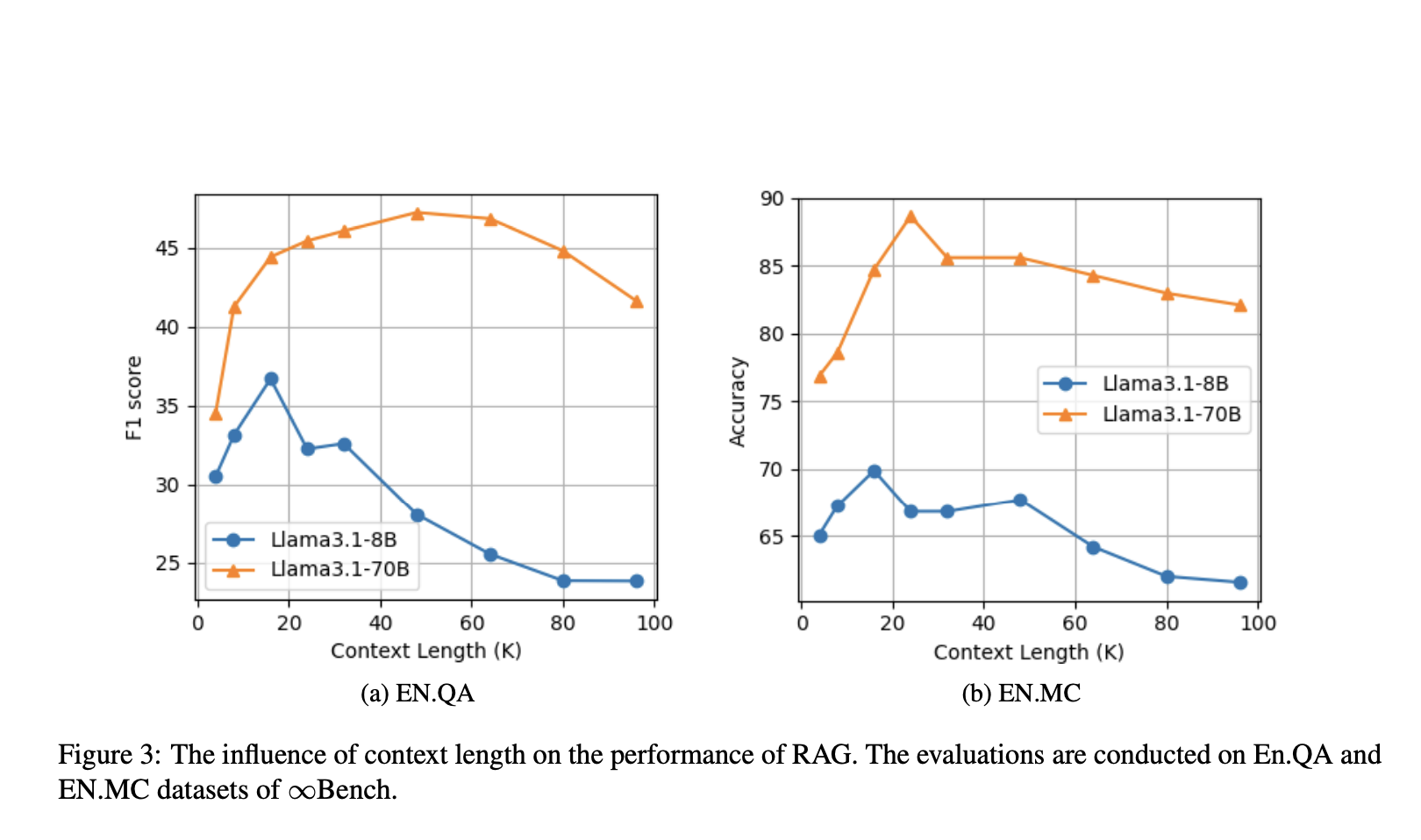

El rendimiento del método OP-RAG se probó exhaustivamente frente a otros modelos líderes. Los investigadores de NVIDIA realizaron experimentos utilizando conjuntos de datos públicos, como los puntos de referencia EN.QA y EN.MC de ∞Bench. Sus resultados mostraron una marcada mejora tanto en la precisión como en la eficiencia en comparación con los LLM de contexto largo tradicionales sin RAG. Por ejemplo, en el conjunto de datos EN.QA, que contiene un promedio de 150.374 palabras por contexto, OP-RAG alcanzó una puntuación F1 máxima de 47,25 al utilizar 48.000 tokens como entrada, una mejora significativa con respecto a modelos como GPT-4O. De manera similar, en el conjunto de datos EN.MC, OP-RAG superó a otros modelos por un margen considerable, logrando una precisión de 88,65 con solo 24.000 tokens, mientras que el modelo tradicional Llama3.1 sin RAG solo pudo alcanzar una precisión de 71,62 utilizando 117.000 tokens.

Comparaciones posteriores mostraron que OP-RAG mejoró la calidad de las respuestas generadas y redujo drásticamente la cantidad de tokens necesarios, lo que hizo que el modelo fuera más eficiente. Los LLM de contexto largo tradicionales, como GPT-4O y Gemini-1.5-Pro, requerían casi el doble de la cantidad de tokens en comparación con OP-RAG para lograr puntajes de rendimiento más bajos. Esta eficiencia es particularmente valiosa en aplicaciones del mundo real, donde los costos computacionales y la asignación de recursos son factores críticos para implementar modelos de lenguaje a gran escala.

En conclusión, OP-RAG representa un avance significativo en el campo de la generación aumentada por recuperación, ofreciendo una solución a las limitaciones de los LLM de contexto largo. Al preservar el orden de los fragmentos de texto recuperados, el método permite una generación de respuestas más coherente y contextualmente relevante, incluso en tareas de respuesta a preguntas a gran escala. Los investigadores de NVIDIA han demostrado que este enfoque innovador supera a los métodos existentes en términos de calidad y eficiencia, lo que lo convierte en una solución prometedora para futuros avances en el procesamiento del lenguaje natural.

Echa un vistazo a la Papel. Todo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y LinkedInÚnete a nuestro Canal de Telegram.

Si te gusta nuestro trabajo, te encantará nuestro hoja informativa..

No olvides unirte a nuestro Subreddit con más de 50 000 millones de usuarios

Nikhil es consultor en prácticas en Marktechpost. Está cursando una doble titulación integrada en Materiales en el Instituto Indio de Tecnología de Kharagpur. Nikhil es un entusiasta de la IA y el aprendizaje automático que siempre está investigando aplicaciones en campos como los biomateriales y la ciencia biomédica. Con una sólida formación en ciencia de los materiales, está explorando nuevos avances y creando oportunidades para contribuir.